To jest post gościnny, którego współautorem jest Scott Gutterman z PGA TOUR.

Generatywna sztuczna inteligencja (generative AI) otworzyła nowe możliwości budowania inteligentnych systemów. Niedawne ulepszenia modeli dużych języków opartych na sztucznej inteligencji (LLM) umożliwiły ich wykorzystanie w różnych aplikacjach związanych z wyszukiwaniem informacji. Biorąc pod uwagę źródła danych, firmy LLM zapewniły narzędzia, które pozwoliły nam zbudować chatbota z pytaniami i odpowiedziami w ciągu kilku tygodni, zamiast tego, co mogło zająć lata wcześniej i prawdopodobnie przy gorszej wydajności. Opracowaliśmy rozwiązanie typu Retrieval-Augmented-Generation (RAG), które umożliwiłoby PGA TOUR stworzenie prototypu przyszłej platformy angażującej fanów, która mogłaby udostępnić fanom swoje dane w interaktywny sposób w formacie konwersacyjnym.

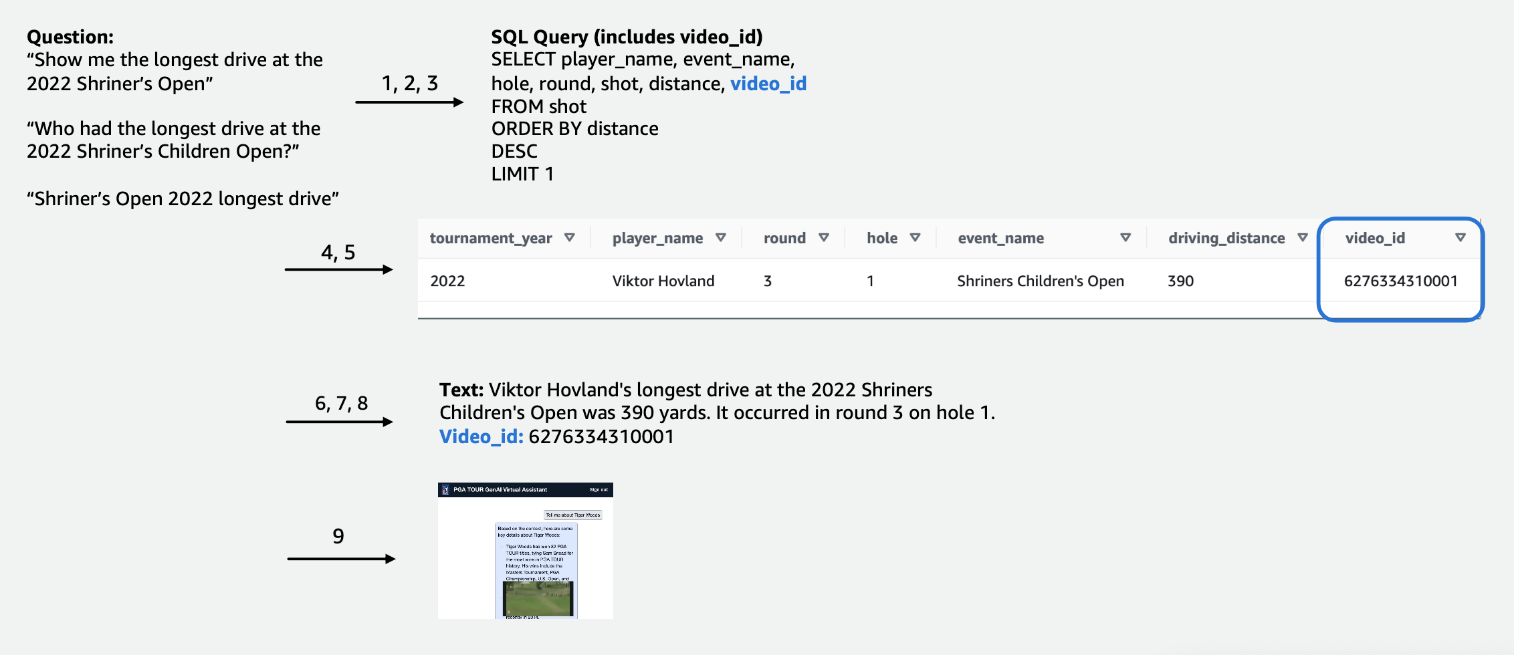

Używanie danych strukturalnych do odpowiadania na pytania wymaga skutecznego wyodrębniania danych istotnych dla zapytania użytkownika. Sformułowaliśmy podejście zamiany tekstu na SQL, w którym zapytanie użytkownika w języku naturalnym jest konwertowane na instrukcję SQL przy użyciu LLM. SQL jest uruchamiany przez Amazonka Atena zwrócić odpowiednie dane. Dane te są ponownie przekazywane LLM, który jest proszony o udzielenie odpowiedzi na zapytanie użytkownika dotyczące danych.

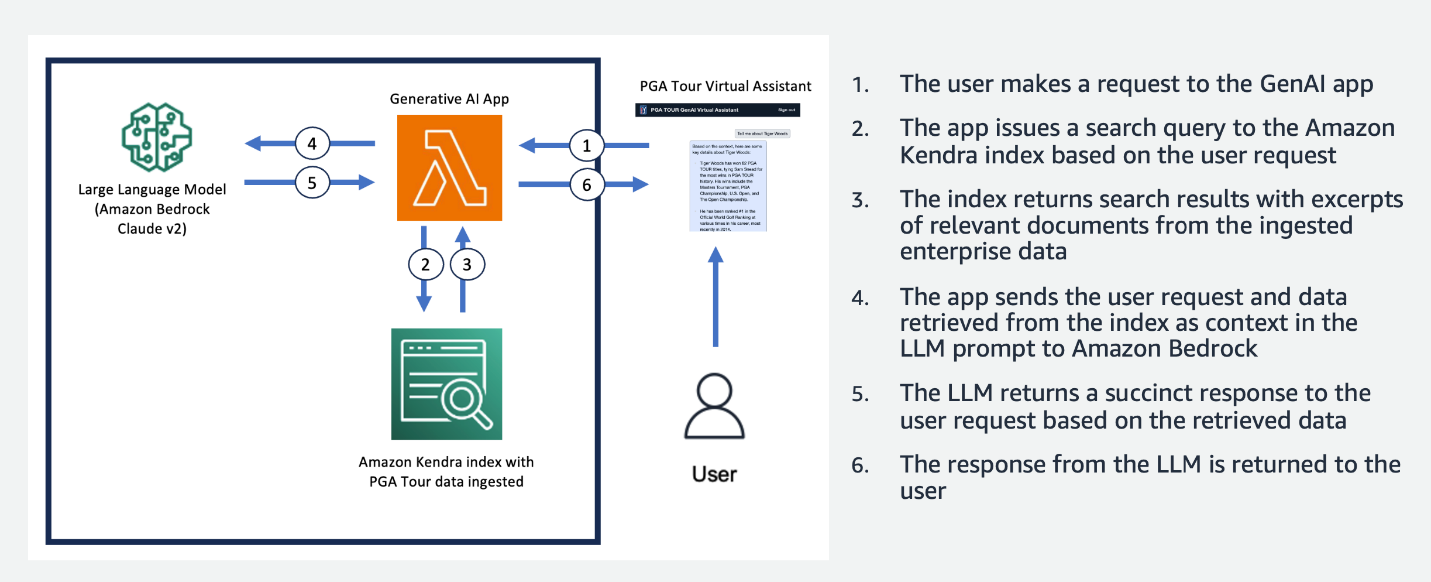

Korzystanie z danych tekstowych wymaga indeksu, którego można użyć do wyszukiwania i zapewniania odpowiedniego kontekstu LLM w celu odpowiedzi na zapytanie użytkownika. Aby umożliwić szybkie wyszukiwanie informacji, używamy Amazonka Kendra jako indeks tych dokumentów. Gdy użytkownicy zadają pytania, nasz wirtualny asystent szybko przeszukuje indeks Amazon Kendra, aby znaleźć odpowiednie informacje. Amazon Kendra wykorzystuje przetwarzanie języka naturalnego (NLP), aby zrozumieć zapytania użytkowników i znaleźć najbardziej odpowiednie dokumenty. Odpowiednie informacje są następnie przekazywane LLM w celu wygenerowania ostatecznej odpowiedzi. Nasze ostateczne rozwiązanie stanowi połączenie podejścia zamiany tekstu na SQL i tekstu RAG.

W tym poście podkreślamy, jak Centrum Innowacji Generacyjnej Sztucznej Inteligencji AWS współpracował z Usługi profesjonalne AWS i PGA TOUR opracować prototyp wirtualnego asystenta przy użyciu Amazońska skała macierzysta które mogłoby umożliwić fanom wyodrębnienie informacji o dowolnym wydarzeniu, zawodniku, dołku lub poziomie strzału w płynny i interaktywny sposób. Amazon Bedrock to w pełni zarządzana usługa oferująca wybór wysokowydajnych modeli podstawowych (FM) od wiodących firm zajmujących się sztuczną inteligencją, takich jak AI21 Labs, Anthropic, Cohere, Meta, Stability AI i Amazon za pośrednictwem jednego interfejsu API, wraz z szerokim zestawem możliwości potrzebne do tworzenia generatywnych aplikacji AI zapewniających bezpieczeństwo, prywatność i odpowiedzialną sztuczną inteligencję.

Rozwój: Przygotowanie danych

Jak w przypadku każdego projektu opartego na danych, wydajność będzie tak dobra, jak dane. Przetworzyliśmy dane, aby umożliwić LLM skuteczne przeszukiwanie i pobieranie odpowiednich danych.

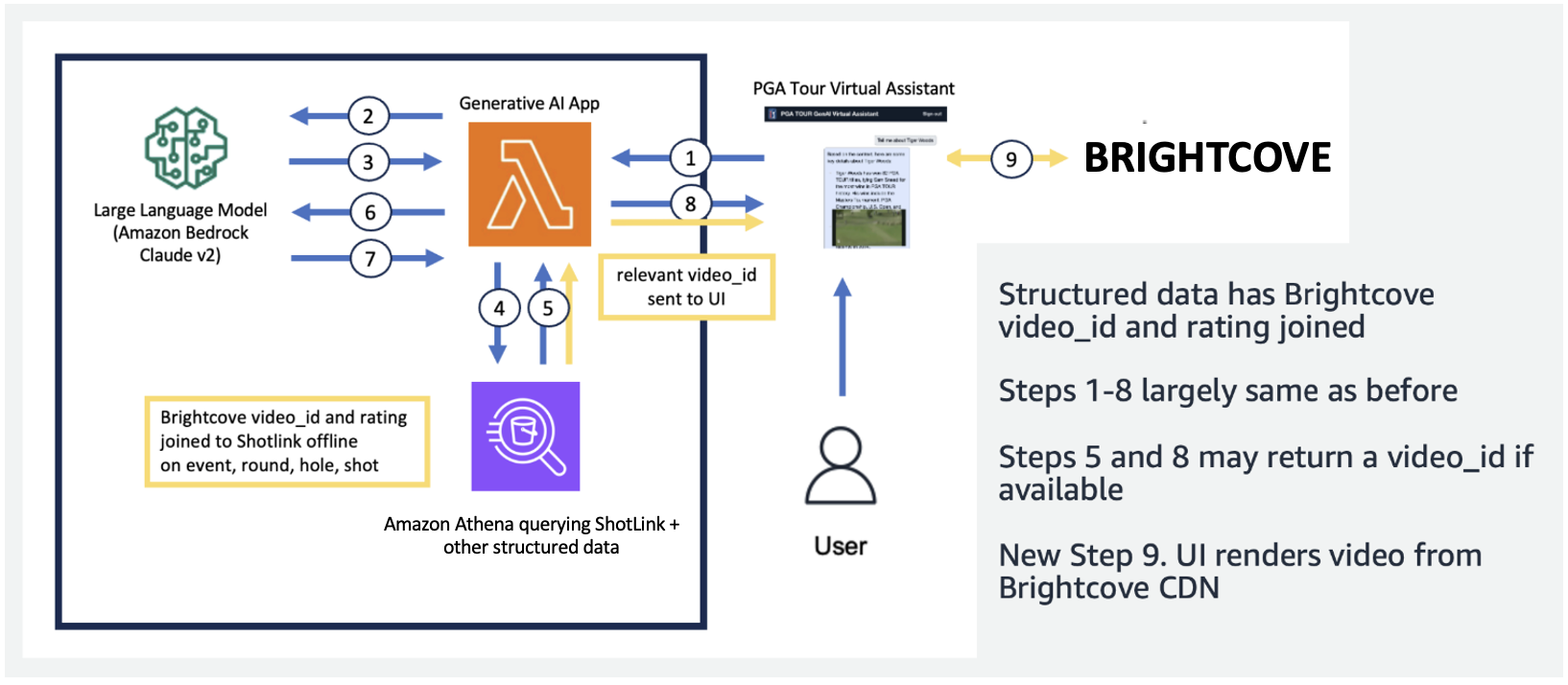

W przypadku tabelarycznych danych dotyczących konkurencji skupiliśmy się na podzbiorze danych odpowiadającym największej liczbie zapytań użytkowników i intuicyjnie oznaczyliśmy kolumny, tak aby były łatwiejsze do zrozumienia dla LLM. Stworzyliśmy także kilka kolumn pomocniczych, aby pomóc LLM zrozumieć koncepcje, z którymi w przeciwnym razie mógłby mieć trudności. Na przykład, jeśli golfista odda jeden strzał mniej niż norma (np. trafi do dołka w 3 strzałach na normie 4 lub w 4 strzałach na normie 5), powszechnie nazywa się to ptaszyna. Jeśli użytkownik zapyta: „Ile birdie wykonał gracz X w zeszłym roku?”, samo posiadanie wyniku i par w tabeli nie wystarczy. W rezultacie dodaliśmy kolumny wskazujące popularne terminy golfowe, takie jak bogey, birdie i eagle. Dodatkowo połączyliśmy dane Konkursowe z oddzielnym zbiorem wideo, dołączając kolumnę dla video_id, co umożliwiłoby naszej aplikacji pobranie filmu powiązanego z konkretnym ujęciem z danych Konkursu. Umożliwiliśmy także łączenie danych tekstowych z danymi tabelarycznymi, np. dodając biografie każdego zawodnika w formie kolumny tekstowej. Na poniższych rysunkach przedstawiono krok po kroku procedurę przetwarzania zapytania w potoku zamiany tekstu na SQL. Liczby wskazują serię kroków, w których należy odpowiedzieć na zapytanie.

Na poniższym rysunku przedstawiono nasz kompleksowy potok. Używamy AWS Lambda jako nasza funkcja orkiestracyjna odpowiedzialna za interakcję z różnymi źródłami danych, LLM i korekcję błędów na podstawie zapytania użytkownika. Kroki 1-8 są podobne do pokazanych na poniższym rysunku. Istnieją niewielkie zmiany w przypadku danych nieustrukturyzowanych, które omówimy dalej.

Dane tekstowe wymagają unikalnych etapów przetwarzania, które dzielą (lub segmentują) długie dokumenty na części zrozumiałe dla LLM, przy jednoczesnym zachowaniu spójności tematycznej. Eksperymentowaliśmy z kilkoma podejściami i zdecydowaliśmy się na schemat podziału na poziomie strony, który dobrze pasował do formatu przewodników multimedialnych. Wykorzystaliśmy Amazon Kendra, czyli usługę zarządzaną, która zajmuje się indeksowaniem dokumentów, bez konieczności określania osadzania, zapewniając jednocześnie łatwe API do wyszukiwania. Poniższy rysunek ilustruje tę architekturę.

Opracowany przez nas ujednolicony, skalowalny potok umożliwia skalowanie PGA TOUR do pełnej historii danych, z których część sięga XIX wieku. Umożliwia przyszłym aplikacjom, które będą mogły na żywo korzystać z kontekstu kursu, tworzenie bogatych doświadczeń w czasie rzeczywistym.

Rozwój: ocena LLM i opracowywanie generatywnych aplikacji AI

Dokładnie przetestowaliśmy i oceniliśmy własne i zewnętrzne LLM dostępne w Amazon Bedrock, aby wybrać model, który najlepiej pasuje do naszego rurociągu i przypadku użycia. Wybraliśmy Claude v2 i Claude Instant firmy Anthropic na Amazon Bedrock. W przypadku naszego ostatecznego potoku danych ustrukturyzowanych i nieustrukturyzowanych obserwujemy, że Claude 2 firmy Anthropic na platformie Amazon Bedrock wygenerował lepsze ogólne wyniki dla naszego ostatecznego potoku danych.

Podpowiadanie jest krytycznym aspektem zmuszania LLM do wyświetlania tekstu zgodnie z oczekiwaniami. Spędziliśmy dużo czasu eksperymentując z różnymi podpowiedziami dla każdego zadania. Na przykład w przypadku potoku zamiany tekstu na SQL mieliśmy kilka podpowiedzi zastępczych o coraz większej szczegółowości i stopniowo upraszczanych schematach tabel. Jeśli zapytanie SQL było nieprawidłowe i spowodowało błąd w usłudze Athena, opracowaliśmy monit o korektę błędu, który przekazywałby błąd i niepoprawny kod SQL do LLM i prosił o jego naprawienie. Ostatni monit w potoku zamiany tekstu na SQL prosi LLM o pobranie danych wyjściowych Atheny, które mogą być dostarczone w formacie Markdown lub CSV, i dostarczenie odpowiedzi użytkownikowi. W przypadku tekstu nieustrukturyzowanego opracowaliśmy ogólne podpowiedzi umożliwiające wykorzystanie kontekstu pobranego z Amazon Kendra w celu udzielenia odpowiedzi na pytanie użytkownika. Podpowiedź zawierała instrukcje, aby korzystać wyłącznie z informacji uzyskanych od Amazon Kendra i nie polegać na danych pochodzących ze szkolenia wstępnego LLM.

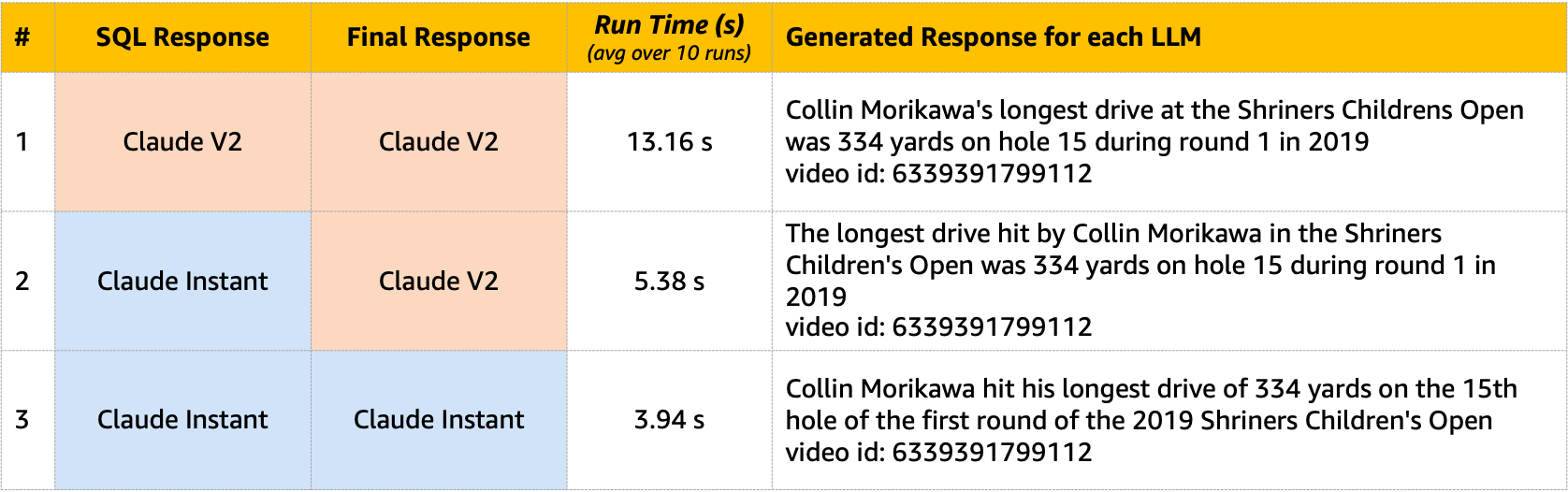

Opóźnienie jest często problemem w przypadku generatywnych aplikacji AI i ma to miejsce również w tym przypadku. Jest to szczególnie istotne w przypadku zamiany tekstu na SQL, która wymaga początkowego wywołania LLM generującego SQL, po którym następuje wywołanie LLM generujące odpowiedź. Jeśli używamy dużego LLM, takiego jak Claude V2 firmy Anthropic, skutecznie podwaja to opóźnienie tylko jednego wywołania LLM. Eksperymentowaliśmy z kilkoma konfiguracjami dużych i mniejszych LLM, aby ocenić czas działania i poprawność. Poniższa tabela przedstawia przykład jednego pytania pokazanego poniżej, który pokazuje opóźnienie, a także wygenerowane odpowiedzi za pomocą Claude V2 i Claude Instant firmy Anthropic na Amazon Bedrock.

Prototyp

W naszej aplikacji wykorzystaliśmy funkcję Lambda do koordynowania szybkich wyborów i komunikacji pomiędzy Amazon Athena, Amazon Kendra i Amazon Bedrock. Wirtualny asystent posiada interfejs konwersacyjny zbudowany przy użyciu React i Cloudscape Design System, który wykorzystuje tekst i filmy do interakcji z użytkownikami.

Nasz wirtualny asystent może zadać szeroki zakres pytań dotyczących wydarzeń PGA TOUR, graczy, statystyk, historii i nie tylko. Na przykład zapytany o najdłuższe przejazdy Tony'ego Finau podczas Shriners Children's Open (jednego z najważniejszych wydarzeń w ramach PGA TOUR) asystent może zapytać o ustrukturyzowane dane, aby uzyskać dane dotyczące poziomu oddanego strzału. Potrafi wyodrębnić dokładną odległość w jardach, okrągłą liczbę i otwór, podczas którego uzyskał ten rekord, korzystając z potoku zamiany tekstu na SQL. Następnie asystent interpretuje te dane liczbowe, aby wygenerować ostateczną odpowiedź. Poniższa tabela zawiera kilka przykładowych odpowiedzi.

| Question | Odpowiedź |

| Jaki był najdłuższy przejazd Tony’ego Finau podczas Shriners Children’s Open? | Najdłuższy przejazd Tony’ego Finau w Shriners Childrens Open wyniósł 382 jardy i został wykonany podczas pierwszej rundy na dołku numer 4 w 2018 roku. |

| Jaki był najdłuższy przejazd Collina Morikawy w Shriners Children's Open? | Najdłuższy przejazd Collina Morikawy podczas Shriners Childrens Open wyniósł 334 jardy. Miało to miejsce w 2019 roku podczas pierwszej rundy na dołku numer 15. |

| Czy ktoś strzelił asa na Shriners Children's Open 2022? | Tak, Adam Hadwin trafił do dołka nr 14 podczas 3. rundy turnieju Shriners Children's Open 2022 |

Poniższy film objaśniający przedstawia kilka przykładów interakcji z wirtualnym asystentem.

Podczas wstępnych testów nasz wirtualny asystent PGA TOUR okazał się bardzo obiecujący w zakresie poprawy doświadczeń fanów. Łącząc technologie sztucznej inteligencji, takie jak zamiana tekstu na SQL, wyszukiwanie semantyczne i generowanie języka naturalnego, asystent zapewnia pouczające i angażujące odpowiedzi. Fani mają łatwy dostęp do danych i narracji, które wcześniej były trudne do znalezienia.

Co przyniesie przyszłość?

W miarę dalszego rozwoju będziemy poszerzać zakres pytań, z którymi może sobie poradzić nasz wirtualny asystent. Będzie to wymagało szeroko zakrojonych testów w ramach współpracy pomiędzy AWS i PGA TOUR. Z biegiem czasu zamierzamy przekształcić asystenta w spersonalizowane, wielokanałowe doświadczenie dostępne w interfejsach internetowych, mobilnych i głosowych.

Utworzenie opartego na chmurze generatywnego asystenta AI umożliwia PGA TOUR prezentowanie ogromnego źródła danych wielu interesariuszom wewnętrznym i zewnętrznym. W miarę ewolucji krajobrazu generatywnej sztucznej inteligencji w sporcie umożliwia tworzenie nowych treści. Możesz na przykład użyć sztucznej inteligencji i uczenia maszynowego (ML), aby ujawnić treści, które fani chcą zobaczyć podczas oglądania wydarzenia lub gdy zespoły produkcyjne szukają ujęć z poprzednich turniejów pasujących do bieżącego wydarzenia. Na przykład, jeśli Max Homa przygotowuje się do oddania swojego ostatniego strzału w mistrzostwach PGA TOUR z miejsca znajdującego się 20 stóp od kręgla, PGA TOUR może wykorzystać sztuczną inteligencję i uczenie maszynowe do zidentyfikowania i zaprezentowania jego klipów z komentarzem wygenerowanym przez sztuczną inteligencję próbował już pięć razy oddać podobny strzał. Ten rodzaj dostępu i danych umożliwia zespołowi produkcyjnemu natychmiastowe dodanie wartości do transmisji lub umożliwienie fanom dostosowania rodzaju danych, które chcą zobaczyć.

„PGA TOUR jest liderem w branży w zakresie wykorzystania najnowocześniejszych technologii w celu poprawy wrażeń fanów. Sztuczna inteligencja znajduje się na czele naszego stosu technologii, gdzie pozwala nam tworzyć bardziej wciągające i interaktywne środowisko dla fanów. To początek naszej podróży w zakresie generatywnej sztucznej inteligencji we współpracy z Centrum innowacji AWS Generative AI w celu zapewnienia transformacyjnej, kompleksowej obsługi klienta. Pracujemy nad wykorzystaniem Amazon Bedrock i naszych zastrzeżonych danych, aby stworzyć interaktywne doświadczenie dla fanów PGA TOUR, w którym będą mogli w interaktywny sposób znaleźć interesujące informacje na temat wydarzenia, gracza, statystyk lub innych treści.

– Scott Gutterman, wiceprezes ds. transmisji i własności cyfrowych w PGA TOUR.

Wnioski

Projekt, który omówiliśmy w tym poście, jest przykładem tego, jak ustrukturyzowane i nieustrukturyzowane źródła danych można połączyć za pomocą sztucznej inteligencji, aby stworzyć wirtualnych asystentów nowej generacji. W przypadku organizacji sportowych technologia ta umożliwia bardziej wciągające zaangażowanie fanów i odblokowuje wewnętrzną wydajność. Wykrywane przez nas dane pomagają interesariuszom PGA TOUR, takim jak gracze, trenerzy, działacze, partnerzy i media, szybciej podejmować świadome decyzje. Poza sportem naszą metodologię można zastosować w dowolnej branży. Te same zasady mają zastosowanie do asystentów budynków, którzy angażują klientów, pracowników, studentów, pacjentów i innych użytkowników końcowych. Dzięki przemyślanemu projektowi i testom praktycznie każda organizacja może odnieść korzyści z systemu sztucznej inteligencji, który kontekstualizuje jej ustrukturyzowane bazy danych, dokumenty, obrazy, filmy i inną zawartość.

Jeśli jesteś zainteresowany wdrożeniem podobnych funkcjonalności, rozważ skorzystanie z Agenci Amazon Bedrock i Bazy wiedzy na temat Amazon Bedrock jako alternatywne rozwiązanie w pełni zarządzane przez AWS. Podejście to może prowadzić do dalszych badań nad zapewnieniem inteligentnej automatyzacji i możliwości wyszukiwania danych za pośrednictwem dostosowywalnych agentów. Agenci ci mogą potencjalnie przekształcić interakcje użytkownika z aplikacją tak, aby były bardziej naturalne, wydajne i skuteczne.

O autorach

Scotta Guttermana jest wiceprezesem ds. operacji cyfrowych w PGA TOUR. Jest odpowiedzialny za ogólne operacje cyfrowe TOUR, rozwój produktów i kieruje strategią GenAI.

Scotta Guttermana jest wiceprezesem ds. operacji cyfrowych w PGA TOUR. Jest odpowiedzialny za ogólne operacje cyfrowe TOUR, rozwój produktów i kieruje strategią GenAI.

Ahsan Ali jest naukowcem stosowanym w Centrum Innowacji Amazon Generative AI, gdzie współpracuje z klientami z różnych dziedzin, aby rozwiązywać ich pilne i kosztowne problemy za pomocą Generative AI.

Ahsan Ali jest naukowcem stosowanym w Centrum Innowacji Amazon Generative AI, gdzie współpracuje z klientami z różnych dziedzin, aby rozwiązywać ich pilne i kosztowne problemy za pomocą Generative AI.

Tahina Syeda jest naukowcem stosowanym w Centrum Innowacji Amazon Generative AI, gdzie współpracuje z klientami, pomagając im osiągać wyniki biznesowe dzięki generatywnym rozwiązaniom AI. Poza pracą lubi próbować nowego jedzenia, podróżować i uczyć taekwondo.

Tahina Syeda jest naukowcem stosowanym w Centrum Innowacji Amazon Generative AI, gdzie współpracuje z klientami, pomagając im osiągać wyniki biznesowe dzięki generatywnym rozwiązaniom AI. Poza pracą lubi próbować nowego jedzenia, podróżować i uczyć taekwondo.

Grace Lang jest inżynierem ds. danych i uczenia maszynowego w AWS Professional Services. Kierowana pasją pokonywania trudnych wyzwań, Grace pomaga klientom osiągać ich cele, opracowując rozwiązania oparte na uczeniu maszynowym.

Grace Lang jest inżynierem ds. danych i uczenia maszynowego w AWS Professional Services. Kierowana pasją pokonywania trudnych wyzwań, Grace pomaga klientom osiągać ich cele, opracowując rozwiązania oparte na uczeniu maszynowym.

Jae Lee jest starszym menedżerem ds. zaangażowania w pionie M&E firmy ProServe. Prowadzi i realizuje złożone projekty, wykazuje duże umiejętności rozwiązywania problemów, zarządza oczekiwaniami interesariuszy i jest kuratorem prezentacji na szczeblu kierowniczym. Lubi pracować nad projektami skupiającymi się na sporcie, generatywnej sztucznej inteligencji i doświadczeniu klienta.

Jae Lee jest starszym menedżerem ds. zaangażowania w pionie M&E firmy ProServe. Prowadzi i realizuje złożone projekty, wykazuje duże umiejętności rozwiązywania problemów, zarządza oczekiwaniami interesariuszy i jest kuratorem prezentacji na szczeblu kierowniczym. Lubi pracować nad projektami skupiającymi się na sporcie, generatywnej sztucznej inteligencji i doświadczeniu klienta.

Karna Chahara jest konsultantem ds. bezpieczeństwa w zespole wspólnego dostarczania w AWS. Jest entuzjastą technologii, który lubi pracować z klientami, aby rozwiązywać ich problemy związane z bezpieczeństwem i poprawiać ich poziom bezpieczeństwa w chmurze.

Karna Chahara jest konsultantem ds. bezpieczeństwa w zespole wspólnego dostarczania w AWS. Jest entuzjastą technologii, który lubi pracować z klientami, aby rozwiązywać ich problemy związane z bezpieczeństwem i poprawiać ich poziom bezpieczeństwa w chmurze.

Mike'a Amjadiego jest inżynierem danych i uczenia maszynowego w AWS ProServe, którego celem jest umożliwienie klientom maksymalizacji wartości z danych. Specjalizuje się w projektowaniu, budowaniu i optymalizacji potoków danych zgodnie z dobrze zaprojektowanymi zasadami. Mike pasjonuje się wykorzystaniem technologii do rozwiązywania problemów i stara się zapewniać naszym klientom najlepsze wyniki.

Mike'a Amjadiego jest inżynierem danych i uczenia maszynowego w AWS ProServe, którego celem jest umożliwienie klientom maksymalizacji wartości z danych. Specjalizuje się w projektowaniu, budowaniu i optymalizacji potoków danych zgodnie z dobrze zaprojektowanymi zasadami. Mike pasjonuje się wykorzystaniem technologii do rozwiązywania problemów i stara się zapewniać naszym klientom najlepsze wyniki.

Wruszali Sawant jest inżynierem front-end w Proserve. Posiada duże umiejętności w zakresie tworzenia responsywnych stron internetowych. Uwielbia pracować z klientami, rozumieć ich wymagania i dostarczać skalowalne, łatwe do wdrożenia rozwiązania UI/UX.

Wruszali Sawant jest inżynierem front-end w Proserve. Posiada duże umiejętności w zakresie tworzenia responsywnych stron internetowych. Uwielbia pracować z klientami, rozumieć ich wymagania i dostarczać skalowalne, łatwe do wdrożenia rozwiązania UI/UX.

Neelama Patela jest menedżerem ds. rozwiązań dla klientów w AWS, prowadzącym kluczowe inicjatywy związane z generatywną sztuczną inteligencją i modernizacją chmury. Neelam współpracuje z kluczowymi menedżerami i właścicielami technologii, aby sprostać wyzwaniom związanym z transformacją chmury i pomaga klientom maksymalizować korzyści z wdrożenia chmury. Uzyskała tytuł MBA w Warwick Business School w Wielkiej Brytanii oraz tytuł licencjata w dziedzinie inżynierii komputerowej w Indiach.

Neelama Patela jest menedżerem ds. rozwiązań dla klientów w AWS, prowadzącym kluczowe inicjatywy związane z generatywną sztuczną inteligencją i modernizacją chmury. Neelam współpracuje z kluczowymi menedżerami i właścicielami technologii, aby sprostać wyzwaniom związanym z transformacją chmury i pomaga klientom maksymalizować korzyści z wdrożenia chmury. Uzyskała tytuł MBA w Warwick Business School w Wielkiej Brytanii oraz tytuł licencjata w dziedzinie inżynierii komputerowej w Indiach.

Doktor Murali Baktha jest globalnym architektem rozwiązań golfowych w AWS i stoi na czele kluczowych inicjatyw obejmujących generatywną sztuczną inteligencję, analizę danych i najnowocześniejsze technologie chmurowe. Murali współpracuje z kluczowymi menedżerami i właścicielami technologii, aby zrozumieć wyzwania biznesowe klientów i projektować rozwiązania, aby sprostać tym wyzwaniom. Posiada tytuł MBA w dziedzinie finansów uzyskany na Uniwersytecie UConn oraz doktorat na Uniwersytecie Stanowym Iowa.

Doktor Murali Baktha jest globalnym architektem rozwiązań golfowych w AWS i stoi na czele kluczowych inicjatyw obejmujących generatywną sztuczną inteligencję, analizę danych i najnowocześniejsze technologie chmurowe. Murali współpracuje z kluczowymi menedżerami i właścicielami technologii, aby zrozumieć wyzwania biznesowe klientów i projektować rozwiązania, aby sprostać tym wyzwaniom. Posiada tytuł MBA w dziedzinie finansów uzyskany na Uniwersytecie UConn oraz doktorat na Uniwersytecie Stanowym Iowa.

Mahdiego Noora jest menedżerem ds. nauk stosowanych w Centrum Innowacji Generative Ai. Dzięki pasji do łączenia technologii i innowacji pomaga klientom AWS w uwalnianiu potencjału generatywnej sztucznej inteligencji, przekształcając potencjalne wyzwania w możliwości szybkiego eksperymentowania i innowacji, koncentrując się na skalowalnych, mierzalnych i wpływowych zastosowaniach zaawansowanych technologii sztucznej inteligencji oraz usprawniając ścieżkę do produkcji.

Mahdiego Noora jest menedżerem ds. nauk stosowanych w Centrum Innowacji Generative Ai. Dzięki pasji do łączenia technologii i innowacji pomaga klientom AWS w uwalnianiu potencjału generatywnej sztucznej inteligencji, przekształcając potencjalne wyzwania w możliwości szybkiego eksperymentowania i innowacji, koncentrując się na skalowalnych, mierzalnych i wpływowych zastosowaniach zaawansowanych technologii sztucznej inteligencji oraz usprawniając ścieżkę do produkcji.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/the-journey-of-pga-tours-generative-ai-virtual-assistant-from-concept-to-development-to-prototype/

- :ma

- :Jest

- :nie

- :Gdzie

- 100

- 13

- 14

- 15%

- 20

- 2018

- 2019

- 2022

- 7

- 8

- a

- zdolności

- Zdolny

- O nas

- dostęp

- dostępny

- Osiągać

- osiągnięty

- w poprzek

- Adam

- Dodaj

- w dodatku

- dodanie

- dodatek

- adres

- przyjąć

- Przyjęcie

- zaawansowany

- ponownie

- agentów

- AI

- Asystent AI

- zmierzać

- wyrównany

- dopuszczać

- pozwala

- wzdłuż

- również

- alternatywny

- Amazonka

- Amazonka Atena

- Amazonka Kendra

- Amazon Web Services

- an

- analityka

- i

- odpowiedź

- Antropiczny

- każdy

- ktoś

- api

- Aplikacja

- Zastosowanie

- aplikacje

- stosowany

- Aplikuj

- podejście

- awanse

- architektura

- SĄ

- sztuczny

- sztuczna inteligencja

- AS

- zapytać

- aspekt

- Asystent

- asystenci

- pomaga

- Współpracownik

- powiązany

- At

- próbując

- Automatyzacja

- dostępny

- AWS

- Usługi profesjonalne AWS

- z powrotem

- na podstawie

- BE

- Początek

- poniżej

- korzyści

- Korzyści

- BEST

- Ulepsz Swój

- pomiędzy

- Poza

- Mieszanie

- mostkowanie

- szeroki

- nadawanie

- budować

- Budowanie

- wybudowany

- biznes

- Business School

- by

- nazywa

- CAN

- możliwości

- który

- ostrożnie

- walizka

- Centrum

- wyzwania

- mistrzostwo

- Zmiany

- chatbot

- wybór

- wybory

- Dodaj

- Teledyski

- Chmura

- adopcja chmury

- współpracował

- współpraca

- kolekcja

- Kolumna

- kolumny

- połączenie

- komentarz

- zobowiązany

- wspólny

- powszechnie

- Komunikacja

- Firmy

- konkurencja

- kompleks

- komputer

- Inżynieria komputerowa

- pojęcie

- Koncepcje

- Troska

- Rozważać

- znaczny

- konsultant

- zawiera

- zawartość

- kontekst

- kontynuować

- konwersacyjny

- przeliczone

- mógłby

- Kurs

- Stwórz

- stworzony

- Tworzenie

- tworzenie

- tworzenie nowych

- krytyczny

- aspekt krytyczny

- wikary

- Aktualny

- klient

- doświadczenie klienta

- Rozwiązania dla klientów

- Klientów

- konfigurowalny

- dostosować

- pionierski nowatorski

- najnowocześniejsza technologia

- dane

- Analityka danych

- inteligencja danych

- sterowane danymi

- Bazy danych

- Decyzje

- dostarczanie

- dostarcza

- dostawa

- wykazać

- demonstruje

- Wnętrze

- projektowanie

- projekty

- życzenia

- detale

- rozwijać

- rozwinięty

- rozwijanie

- oprogramowania

- ZROBIŁ

- różne

- strawny

- cyfrowy

- dyskutować

- omówione

- dystans

- dokumenty

- robi

- domeny

- Debel

- napęd

- napędzany

- dyski

- jazdy

- podczas

- e

- każdy

- orzeł

- łatwiej

- łatwo

- Efektywne

- faktycznie

- efektywność

- wydajny

- bez wysiłku

- pracowników

- upoważniony

- umożliwiać

- włączony

- Umożliwia

- umożliwiając

- zakończenia

- koniec końców

- zobowiązany

- zaręczynowy

- angaże

- ujmujący

- inżynier

- Inżynieria

- entuzjasta

- Środowisko

- błąd

- szczególnie

- ustanowienie

- oceniać

- oceniane

- oceny

- wydarzenie

- wydarzenia

- EVER

- ewoluuje

- ewoluuje

- dokładny

- przykład

- przykłady

- wykonawczy

- kierownictwo

- stanowi przykład

- eksponaty

- Rozszerzać

- oczekiwania

- drogi

- doświadczenie

- Doświadczenia

- eksperymentować

- rozległy

- zewnętrzny

- wyciąg

- wentylator

- Fani

- Moda

- szybciej

- Korzyści

- stopy

- kilka

- pole

- Postać

- Postacie

- finał

- finansować

- Znajdź

- i terminów, a

- pięć

- Fix

- koncentruje

- skupienie

- następnie

- następujący

- jedzenie

- W razie zamówieenia projektu

- czoło

- format

- Fundacja

- od

- z przodu

- Zaczepy

- pełny

- w pełni

- funkcjonować

- funkcjonalności

- dalej

- przyszłość

- genialne

- Ogólne

- Generować

- wygenerowane

- generacja

- generatywny

- generatywna sztuczna inteligencja

- miejsce

- dany

- Globalne

- Gole

- Goes

- golf

- dobry

- dzięki

- stopniowo

- wspaniały

- Największym

- Gość

- Guest Post

- Przewodniki

- miał

- uchwyt

- Ciężko

- Have

- mający

- he

- pomoc

- pomaga

- tutaj

- wydajny

- Atrakcja

- pasemka

- wysoko

- go

- jego

- historia

- Dobranie (Hit)

- przytrzymaj

- Otwór

- W jaki sposób

- http

- HTTPS

- zidentyfikować

- if

- ilustruje

- zdjęcia

- natychmiast

- wciągające

- wpływowy

- wykonawczych

- podnieść

- ulepszenia

- poprawy

- in

- włączony

- nieprawidłowy

- wzrastający

- wskaźnik

- Indie

- wskazać

- przemysł

- Informacja

- informacyjny

- poinformowany

- początkowy

- inicjatywy

- Innowacja

- natychmiastowy

- instrukcje

- Inteligencja

- Inteligentny

- interakcji

- Interakcje

- interaktywne

- odsetki

- zainteresowany

- Interfejs

- interfejsy

- wewnętrzny

- najnowszych

- badać

- z udziałem

- Iowa

- IT

- JEGO

- łączący

- podróż

- jpeg

- jpg

- właśnie

- tylko jeden

- Klawisz

- Uprzejmy

- Labs

- krajobraz

- język

- duży

- Nazwisko

- Ostatni rok

- Utajenie

- lider

- prowadzący

- Wyprowadzenia

- nauka

- Lee

- mniej

- pozwala

- poziom

- Dźwignia

- lubić

- Prawdopodobnie

- powiązany

- relacja na żywo

- LLM

- długo

- poszukuje

- kocha

- maszyna

- uczenie maszynowe

- zrobiony

- Utrzymywanie

- robić

- WYKONUJE

- zarządzane

- kierownik

- zarządza

- sposób

- wiele

- Mecz

- max

- Maksymalizuj

- Może..

- Media

- Meta

- Metodologia

- może

- mikrofon

- ML

- Aplikacje mobilne

- model

- modele

- jeszcze

- większość

- wielokrotność

- narracje

- Naturalny

- Przetwarzanie języka naturalnego

- Potrzebować

- Nowości

- Następny

- następna generacja

- nlp

- numer

- z naszej

- obserwować

- miejsce

- of

- Oferty

- urzędnicy

- często

- Wielokanałowy

- on

- ONE

- tylko

- koncepcja

- operacje

- Szanse

- optymalizacji

- or

- orkiestracja

- organizacja

- organizacji

- Inne

- Inaczej

- ludzkiej,

- wyniki

- wydajność

- zewnętrzne

- koniec

- ogólny

- przezwyciężaniu

- właściciele

- szczególny

- wzmacniacz

- strony

- przechodzić

- pasja

- namiętny

- ścieżka

- pacjenci

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- Personalizowany

- Wycieczka PGA

- rurociąg

- kluczowy

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- gracz

- gracze

- możliwości

- Post

- potencjał

- potencjalnie

- powered

- teraźniejszość

- Presentations

- poprzedni

- poprzednio

- Zasady

- prywatność

- Problem

- problemy

- procedura

- Obrobiony

- przetwarzanie

- Produkt

- rozwój produktów

- Produkcja

- profesjonalny

- projekt

- projektowanie

- obietnica

- monity

- niska zabudowa

- przyzwoitość

- prototyp

- zapewniać

- pod warunkiem,

- że

- Q & A

- zapytania

- pytanie

- pytanie

- pytania

- Szybki

- szmata

- zasięg

- szybki

- szybko

- raczej

- React

- gotowy

- w czasie rzeczywistym

- zrealizować

- niedawny

- rekord

- polegać

- replikowane

- wymagać

- wymagania

- Wymaga

- odpowiedź

- Odpowiedzi

- odpowiedzialny

- czuły

- dalsze

- Efekt

- wyszukiwanie

- powrót

- Bogaty

- okrągły

- run

- taki sam

- skalowalny

- Skala

- schemat

- Szkoła

- nauka

- Naukowiec

- wynik

- Scott

- bezszwowy

- Szukaj

- wyszukiwania

- bezpieczeństwo

- widzieć

- segment

- wybrany

- semantyczny

- senior

- oddzielny

- Serie

- usługa

- Usługi

- zestaw

- Zestawy

- Osiadły

- kilka

- shared

- ona

- strzał

- zdjęć

- pokazane

- Targi

- podpis

- podobny

- uproszczony

- pojedynczy

- umiejętność

- wykwalifikowany

- mniejszy

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Rozwiązywanie

- kilka

- Źródło

- Źródła

- specjalizuje się

- specyfikacja

- specyficzność

- spędził

- SPORTOWE

- Spot

- Stabilność

- stos

- interesariuszy

- interesariusze

- Stan

- Zestawienie sprzedaży

- statystyka

- statystyki

- Ewolucja krok po kroku

- Cel

- Strategia

- usprawnienie

- silny

- zbudowany

- Walka

- Studenci

- taki

- wystarczający

- w kolorze

- Powierzchnia

- otaczający

- system

- systemy

- stół

- Brać

- Zadania

- trwa

- zadania

- Nauczanie

- zespół

- Zespoły

- Technologies

- Technologia

- REGULAMIN

- przetestowany

- Testowanie

- XNUMX

- niż

- że

- Połączenia

- Przyszłość

- Informacje

- ich

- Im

- następnie

- Tam.

- Te

- one

- innych firm

- to

- tych

- Przez

- czas

- czasy

- do

- Tony

- narzędzia

- aktualny

- trudny

- Wycieczka

- Turnieje

- Przekształcać

- Transformacja

- transformacyjny

- Podróżowanie

- stara

- Obrócenie

- rodzaj

- Uk

- zrozumieć

- zrozumienie

- Ujednolicony

- wyjątkowy

- uniwersytet

- odblokowywanie

- odblokowuje

- nieuporządkowany

- pilny

- us

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- wartość

- różnorodność

- różnorodny

- Naprawiono

- pionowy

- przez

- Wideo

- Filmy

- Wirtualny

- Wirtualny asystent

- prawie

- Głos

- chcieć

- była

- oglądania

- Droga..

- we

- sieć

- usługi internetowe

- strony internetowe

- tygodni

- DOBRZE

- były

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- KIM

- szeroki

- Szeroki zasięg

- będzie

- w

- bez

- Praca

- pracujący

- działa

- gorzej

- by

- X

- rok

- lat

- You

- zefirnet