コンテンツのモデレーションは、オンラインの安全性を維持し、Web サイトやソーシャル メディア プラットフォームの価値と標準を維持する上で極めて重要な役割を果たします。 その重要性は、ユーザーを不適切なコンテンツへの曝露から保護し、デジタル空間での健康を守ることで強調されます。 たとえば、広告業界では、コンテンツのモデレーションはブランドを不利な関連付けから守る役割を果たし、それによってブランドの地位向上と収益の増加に貢献します。 広告主は、自社の評判を維持し、悪評を回避するために、ブランドと適切なコンテンツとの連携を優先します。 コンテンツモデレーションは、複数の機能を果たす金融およびヘルスケア分野でも非常に重要です。 これは、個人を特定できる機密情報や健康情報 (PII、PHI) を特定し、保護する上で重要な役割を果たします。 コンテンツモデレーションは、内部標準と慣行を遵守し、外部規制に準拠することにより、ユーザーのデジタル セキュリティを強化します。 これにより、パブリック プラットフォーム上で機密データが不用意に共有されることが防止され、ユーザーのプライバシーとデータ セキュリティが確保されます。

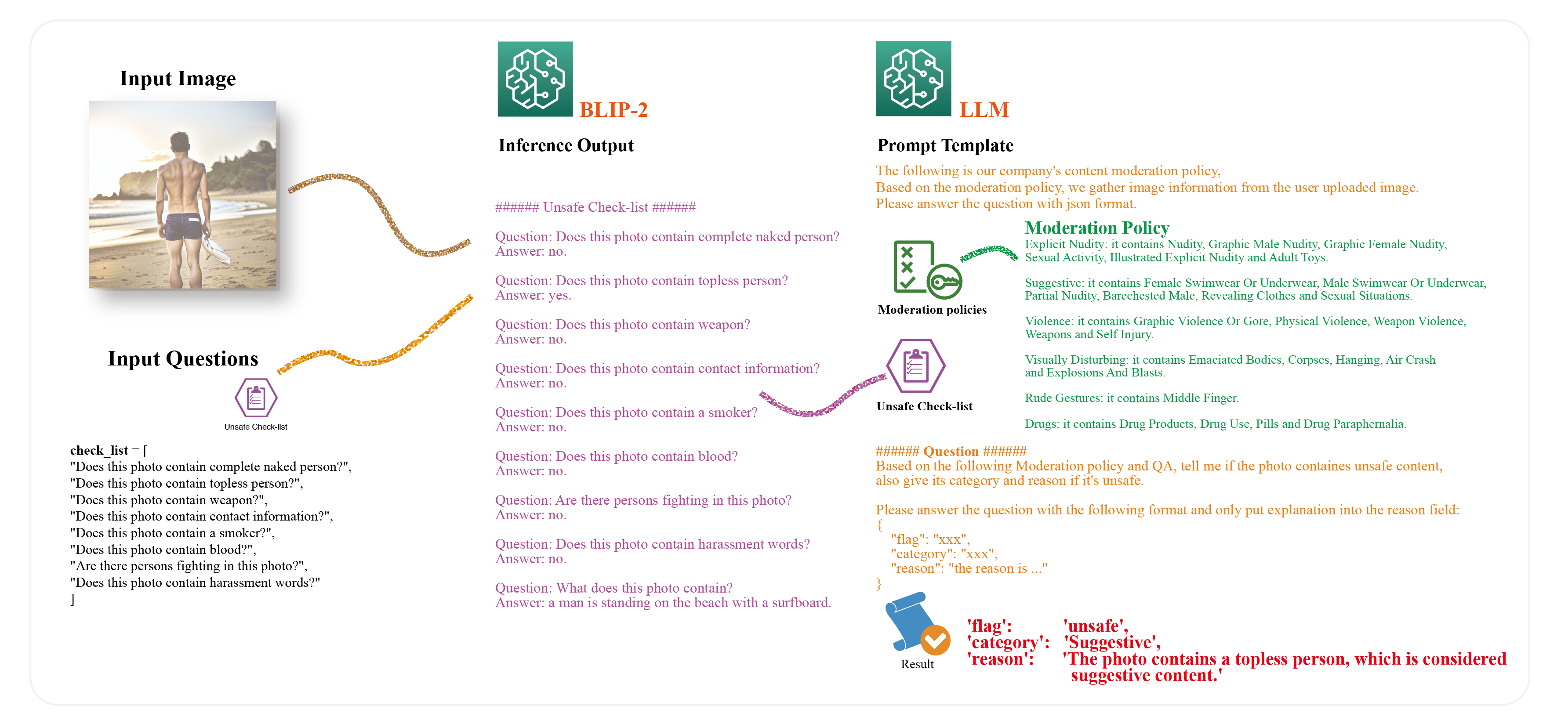

この投稿では、マルチモーダル事前トレーニングと大規模言語モデル (LLM) を使用して画像データのコンテンツ モデレーションを実行する新しい方法を紹介します。 マルチモーダル事前トレーニングを使用すると、一連の関心のある質問に基づいて画像コンテンツを直接クエリでき、モデルはこれらの質問に答えることができます。 これにより、ユーザーは画像とチャットして、組織のポリシーに違反する不適切なコンテンツが含まれているかどうかを確認できます。 LLM の強力な生成機能を使用して、安全/安全でないラベルやカテゴリ タイプを含む最終決定を生成します。 さらに、プロンプトを設計することで、LLM に JSON 形式などの定義された出力形式を生成させることができます。 設計されたプロンプト テンプレートを使用すると、LLM は画像がモデレーション ポリシーに違反しているかどうかを判断し、違反のカテゴリを特定し、その理由を説明し、構造化された JSON 形式で出力を提供できます。

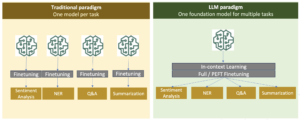

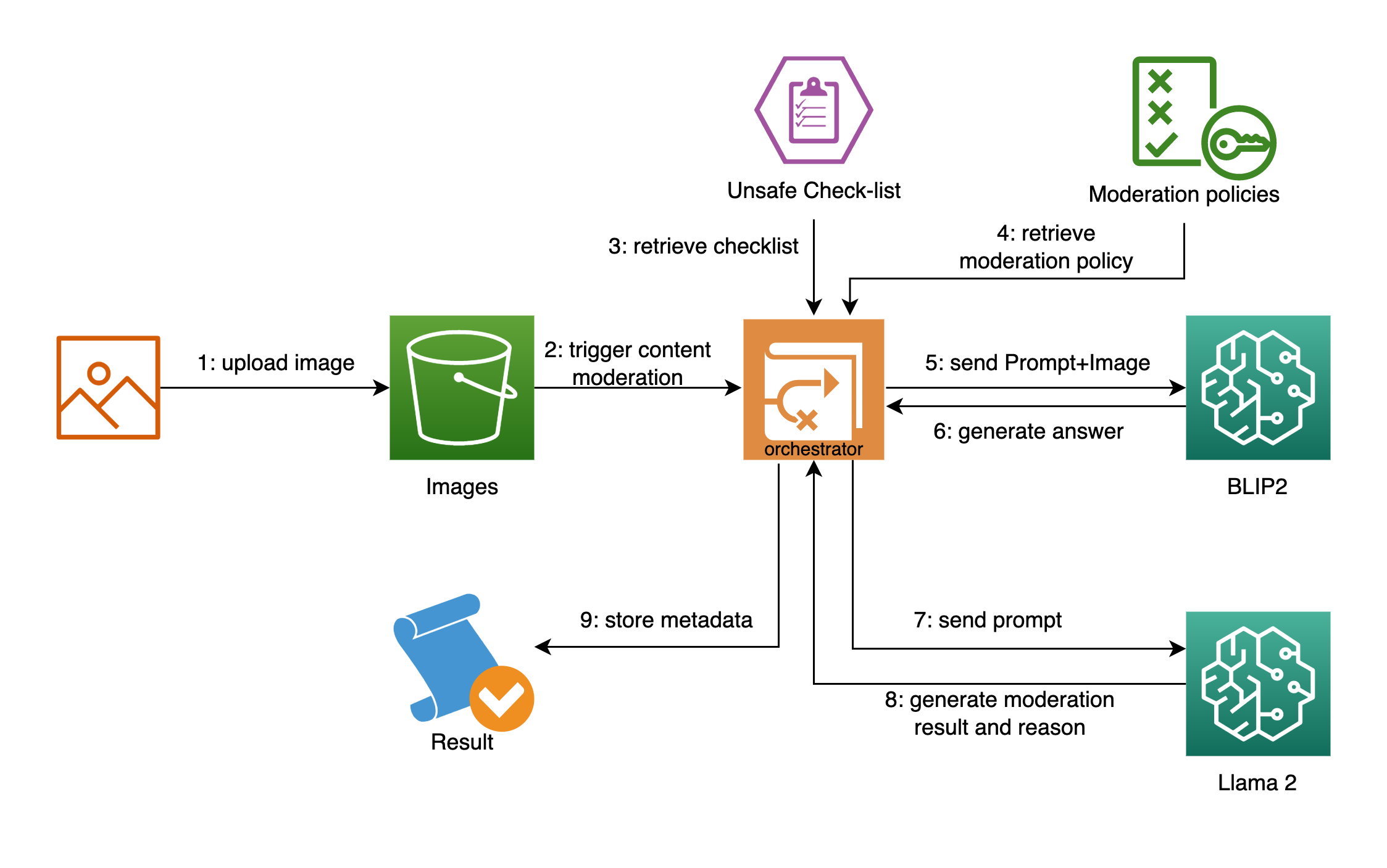

を使用しております ブリップ2 マルチモーダル事前トレーニング方法として。 BLIP-2 は、マルチモーダル事前トレーニングにおける最先端のモデルの XNUMX つであり、視覚的な質問応答、画像キャプション、および画像テキスト検索において既存のメソッドのほとんどを上回ります。 LLM には、次のものを使用します。 ラマ2、次世代のオープンソース LLM。 推論、コーディング、熟練度、知識テストなどの多くのベンチマークで、既存のオープンソース言語モデルを上回るパフォーマンスを示します。。 次の図は、ソリューションのコンポーネントを示しています。

コンテンツモデレーションにおける課題

人間によるモデレーションなどの従来のコンテンツ モデレーション方法では、ユーザー生成コンテンツ (UGC) の量の増加に追いつくことができません。 UGC の量が増加すると、人間のモデレーターは圧倒され、コンテンツを効果的にモデレートするのに苦労する可能性があります。 これにより、ユーザー エクスペリエンスが低下し、モデレーション コストが高くなり、ブランド リスクが生じます。 また、人間によるモデレーションではエラーが発生しやすく、その結果、モデレーションに一貫性がなく、偏った決定が生じる可能性があります。 これらの課題に対処するため、機械学習 (ML) を活用したコンテンツ モデレーションがソリューションとして登場しました。 ML アルゴリズムは、大量の UGC を分析し、組織のポリシーに違反するコンテンツを特定できます。 ML モデルは、パターンを認識し、ヘイトスピーチ、スパム、不適切なコンテンツなどの問題のあるコンテンツを特定するようにトレーニングできます。 研究によると AI を活用したコンテンツ モデレーションでユーザー、ブランド、予算を保護します, ML を活用したコンテンツ モデレーションにより、組織はチームが手動でコンテンツをモデレートするのに費やす時間を最大 95% 回収できます。 これにより、組織はコミュニティ構築やコンテンツ作成など、より戦略的なタスクにリソースを集中させることができます。 ML を活用したコンテンツのモデレーションは、人間によるモデレーションより効率的であるため、モデレーション コストも削減できます。

ML を利用したコンテンツモデレーションには利点がありますが、まだ改善の余地があります。 ML アルゴリズムの有効性は、トレーニングに使用されるデータの品質に大きく依存します。 偏ったデータまたは不完全なデータを使用してモデルがトレーニングされると、誤ったモデレーションの決定が下され、組織がブランド リスクや潜在的な法的責任にさらされる可能性があります。 コンテンツモデレーションに ML ベースのアプローチを採用すると、慎重な検討が必要ないくつかの課題が生じます。 これらの課題には次のようなものがあります。

- ラベル付きデータの取得 – これは、特にラベル作成者のトレーニングが必要な複雑なコンテンツ管理タスクの場合、コストがかかるプロセスになる可能性があります。 このコストにより、教師あり ML モデルを簡単にトレーニングするのに十分な大きさのデータセットを収集することが困難になる可能性があります。 さらに、モデルの精度はトレーニング データの品質に大きく依存しており、偏ったデータや不完全なデータによりモデレーションの決定が不正確になり、ブランド リスクや法的責任につながる可能性があります。

- モデルの一般化 – これは、ML ベースのアプローチを採用するために重要です。 あるデータセットでトレーニングされたモデルは、特にデータセットの分布が異なる場合、別のデータセットにうまく一般化できない可能性があります。 したがって、モデルが新しいデータに適切に一般化されるように、モデルが多様で代表的なデータセットでトレーニングされていることを確認することが重要です。

- 運用効率 – これは、コンテンツモデレーションに従来の ML ベースのアプローチを使用する場合のもう XNUMX つの課題です。 新しいラベルを常に追加し、新しいクラスが追加されたときにモデルを再トレーニングすることは、時間とコストがかかる可能性があります。 さらに、モデレートされるコンテンツの変更に対応するために、モデルが定期的に更新されていることを確認することが重要です。

- 説明可能 – 正当な理由なくコンテンツにフラグが立てられたり削除されたりすると、エンド ユーザーはプラットフォームが偏っている、または不当であると認識し、その結果、ユーザー エクスペリエンスが低下する可能性があります。 同様に、明確な説明がないと、モデレーターにとってコンテンツモデレーションプロセスが非効率的で、時間がかかり、コストがかかる可能性があります。

- 敵対的な性質 – 画像ベースのコンテンツモデレーションの敵対的な性質は、従来の ML ベースのアプローチに特有の課題をもたらします。 悪意のある攻撃者は、画像の同義語を使用したり、実際のコンテンツを問題のないコンテンツの大きな本体に埋め込んだりするなど、さまざまな方法でコンテンツを変更することにより、コンテンツ モデレーション メカニズムを回避しようとする可能性があります。 そのためには、そのような敵対的な戦術を検出して対応するために、モデルを継続的に監視し、更新する必要があります。

BLIP-2によるマルチモーダル推論

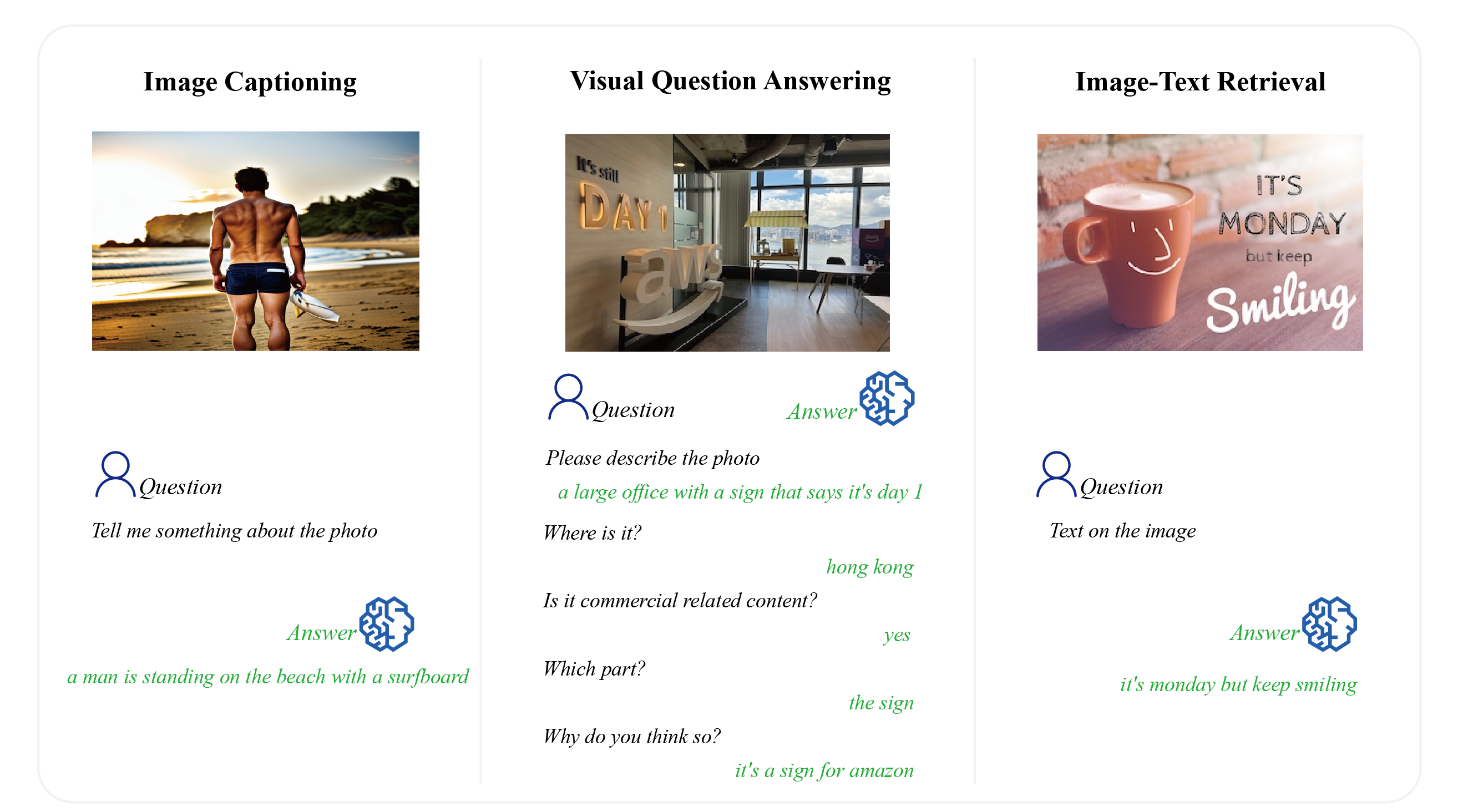

マルチモダリティ ML モデルとは、画像、テキスト、オーディオ、ビデオ、その他の形式の構造化データまたは非構造化データなど、複数のソースまたはモダリティからのデータを処理および統合できるモデルを指します。 人気のあるマルチモダリティ モデルの 2 つは、BLIP-XNUMX などの視覚言語モデルです。これは、コンピューター ビジョンと自然言語処理 (NLP) を組み合わせて、視覚情報とテキスト情報の両方を理解して生成します。 これらのモデルにより、コンピューターは人間の理解を模倣した方法で画像やテキストの意味を解釈できるようになります。 視覚言語モデルは、画像キャプション、画像テキスト検索、視覚的な質問応答などを含むさまざまなタスクに取り組むことができます。 たとえば、画像キャプション モデルは画像の自然言語記述を生成でき、画像テキスト検索モデルはテキスト クエリに基づいて画像を検索できます。 ビジュアル質問応答モデルは画像に関する自然言語の質問に応答でき、マルチモーダル チャットボットはビジュアルおよびテキスト入力を使用して応答を生成できます。 コンテンツの管理に関しては、この機能を使用して質問のリストに対してクエリを実行できます。

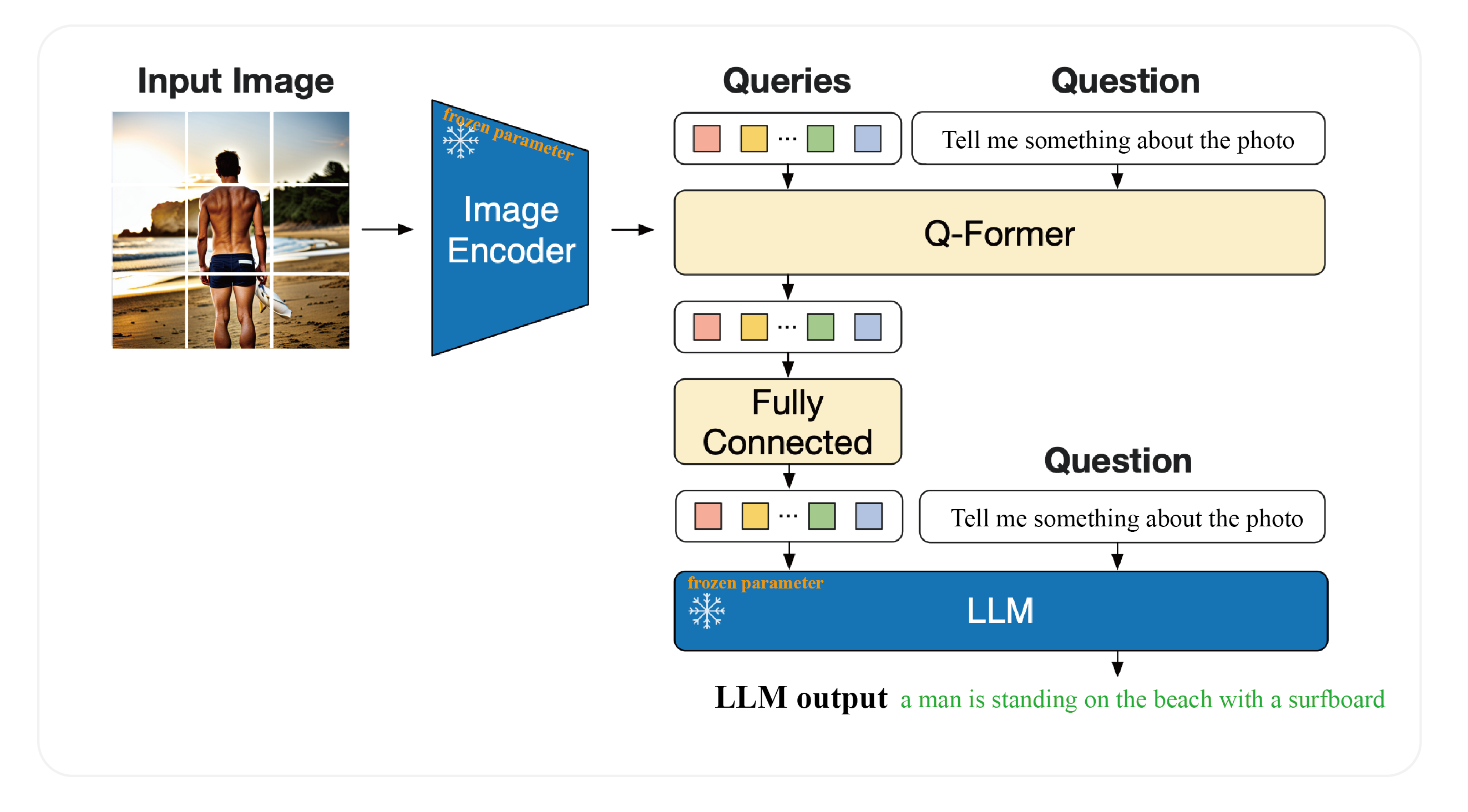

BLIP-2 には 14 つの部分が含まれています。 最初のコンポーネントは、CLIP のフリーズ画像エンコーダ ViT-L/5 で、画像データを入力として受け取ります。 XNUMX 番目のコンポーネントは、テキストを出力するフリーズされた LLM、FlanTXNUMX です。 XNUMX 番目のコンポーネントは、Q-Former と呼ばれるトレーニング可能なモジュールです。これは、フリーズされた画像エンコーダーとフリーズされた LLM を接続する軽量のトランスフォーマーです。 Q-Former は、学習可能なクエリ ベクトルを使用して、フリーズされた画像エンコーダーから視覚的特徴を抽出し、最も有用な視覚的特徴を LLM に供給して、目的のテキストを出力します。

事前トレーニング プロセスには XNUMX つの段階があります。 最初の段階では、Q-Former にテキストに最も関連性のある視覚表現を学習させるために、視覚言語表現の学習が実行されます。 第 XNUMX 段階では、Q-Former の出力を凍結された LLM に接続し、LLM が解釈できる視覚表現を出力するように Q-Former をトレーニングすることによって、視覚から言語への生成学習が実行されます。

BLIP-2 は、既存の方法よりもトレーニング可能なパラメーターが大幅に少ないにもかかわらず、さまざまな視覚言語タスクで最先端のパフォーマンスを実現します。 このモデルは、自然言語の指示に従うことができる、ゼロショット画像からテキストへの生成の新しい機能も示しています。 次の図は、 オリジナルの研究論文.

ソリューションの概要

次の図は、ソリューションのアーキテクチャを示しています。

次のセクションでは、BLIP-2 を アマゾンセージメーカー エンドポイントに接続し、コンテンツのモデレーションに BLIP-2 と LLM を使用します。

前提条件

AWS アカウントが必要です。 AWS IDおよびアクセス管理 ソリューションの一部として作成されたリソースを管理する権限を持つ (IAM) ロール。 詳細については、を参照してください。 スタンドアロンの AWS アカウントを作成する.

初めて作業する場合 Amazon SageMakerスタジオ、まず、 SageMakerドメイン。 さらに、対応する SageMaker ホスティング インスタンスのサービス クォータの増加をリクエストする必要がある場合があります。 BLIP-2 モデルの場合、 ml.g5.2xlarge SageMaker ホスティング インスタンス。 Llama 2 13B モデルの場合、 ml.g5.12xlarge SageMaker ホスティング インスタンス。

BLIP-2 を SageMaker エンドポイントにデプロイする

SageMaker で LLM をホストするには、 大規模モデルの推論 (LMI) DJLServing を使用して大規模なモデルをホストするために最適化されたコンテナー。 DJLServing は、プログラミング言語に依存しない Deep Java Library (DJL) を利用した、高性能のユニバーサル モデル サービング ソリューションです。 DJL と DJLServing の詳細については、以下を参照してください。 DJLServing と DeepSpeed モデルの並列推論を使用して、Amazon SageMaker に大規模なモデルをデプロイする。 SageMaker LMI コンテナの助けを借りて、BLIP-2 モデルは Hugging Face ライブラリで簡単に実装でき、SageMaker でホストできます。 走れるよ blip2-sagemaker.ipynb このステップのために。

Docker イメージとモデル ファイルを準備するには、DJLServing の Docker イメージを取得し、推論スクリプトと構成ファイルをパッケージ化する必要があります。 model.tar.gz ファイルを作成し、 Amazon シンプル ストレージ サービス (Amazon S3) バケット。 を参照できます。 推論スクリプトと構成ファイル のガイドをご参照ください。

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Docker イメージと推論関連ファイルの準備ができたら、モデル、エンドポイントの構成、およびエンドポイントを作成します。

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)エンドポイントのステータスがサービス中になると、画像キャプションの作成および指示されたゼロショットのビジョンから言語への生成タスクのためにエンドポイントを呼び出すことができます。 画像キャプションタスクの場合は、画像をエンドポイントに渡すだけです。

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)指示されたゼロショットのビジョンから言語への生成タスクでは、入力画像に加えて、質問をプロンプトとして定義する必要があります。

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)コンテンツモデレーションに BLIP-2 と LLM を使用する

この段階では、指定された画像に対してクエリを実行し、隠された情報を取得できます。 LLM を使用すると、クエリを整理して情報を取得し、JSON 形式の結果を生成します。 このタスクは、次の XNUMX つのサブタスクに大まかに分割できます。

- BLIP-2 モデルを使用して画像から情報を抽出します。

- LLM を使用して最終結果と説明を生成します。

BLIP-2モデルで画像から情報を抽出する

指定された画像から十分な有用な隠された情報を取得するには、クエリを定義する必要があります。 各クエリはエンドポイントを XNUMX 回呼び出すため、クエリが多いと処理時間が長くなります。 したがって、クエリを高品質にし、重複せずにすべてのポリシーをカバーすることをお勧めします。 サンプル コードでは、クエリを次のように定義します。

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]前述のクエリでは、BLIP-2 のエンドポイントを呼び出し、次のコードで情報を取得します。

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """クエリによって取得される情報に加えて、画像キャプションタスクを使用して情報を取得するには、 prompt ペイロード内のフィールド:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')クエリと回答の内容を画像キャプションと組み合わせて、この取得した情報を次のセクションで説明する下流タスクに使用できます。

LLM を使用して最終結果と説明を生成する

Llama 2 などの大規模言語モデル (LLM) は、適切なプロンプト テンプレートを使用して高品質の結果を生成できます。 使用する Amazon SageMaker ジャンプスタート, ML 実践者は、公開されている基礎モデルの幅広い選択肢から選択できます。 SageMaker Studio で数回クリックするだけで、次のことが可能になります。 Llama 2 を検出して展開する.

最終結果は、特定のプロンプト テンプレートを使用した LLM に依存します。 このようなプロンプトは以下で構成されます: 不適切または攻撃的なカテゴリに基づくモデレーション ポリシー モデレーションのカテゴリ; BLIP-2から抽出された画像情報。 写真に安全でないコンテンツが含まれているかどうかを尋ね、安全でない場合はそのカテゴリと理由を要求する LLM への質問テンプレート。 および結果を JSON 形式で出力する手順。 設計されたプロンプト テンプレートを使用すると、LLM は画像がモデレーション ポリシーに違反しているかどうかを判断し、違反のカテゴリを特定し、その理由を説明し、構造化された JSON 形式で出力を提供できます。

コアのソースコードは次のとおりです。

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]独自のユースケースに基づいてプロンプトをカスタマイズできます。 を参照してください。 ノート 詳細については。 プロンプトの準備ができたら、LLM エンドポイントを呼び出して結果を生成できます。

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]生成された出力の一部は次のとおりです。

時折、ラマ 2 はアシスタントからの回答以外に追加の説明を付け加えます。 解析コードを使用して、元の生成結果から JSON データを抽出できます。

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

生成的アプローチの利点

前のセクションでは、モデル推論のコア部分を実装する方法を説明しました。 このセクションでは、従来のアプローチや視点との比較を含め、生成的アプローチのさまざまな側面を取り上げます。

次の表では、各アプローチを比較しています。

| . | 生成的なアプローチ | 分類アプローチ |

| ラベル付きデータの取得 | 多数の画像で事前トレーニングされたモデル、ゼロショット推論 | あらゆる種類のカテゴリからのデータが必要です |

| モデルの一般化 | さまざまな種類の画像を使用した事前トレーニング済みモデル | モデルの一般化を改善するには、大量のコンテンツモデレーション関連データが必要です |

| 運用効率 | ゼロショット機能 | さまざまなパターンを認識するためにモデルをトレーニングし、ラベルが追加されたときに再トレーニングする必要があります |

| 説明可能 | テキスト出力としての推論、優れたユーザー エクスペリエンス | 推論するのが難しく、説明と解釈が難しい |

| 敵対的な性質 | 堅牢な | 高頻度の再トレーニング |

コンテンツモデレーションを超えたマルチモーダル推論の潜在的なユースケース

BLIP-2 モデルは、微調整の有無にかかわらず、次のような複数の目的に適合するように適用できます。

- 画像のキャプション – これは、画像のビジュアルコンテンツのテキスト説明を生成するようにモデルに要求します。 次の画像例 (左) に示すように、次のようにすることができます。 「男がサーフボードを持ってビーチに立っている」 画像の説明として。

- 視覚的な質問応答 – 中央の画像の例が示すように、次のように尋ねることができます。 「商業関連のコンテンツですか?」 そして私達は持っています "はい" 答えとして。 さらに、BLIP-2 はマルチラウンド会話をサポートし、次の質問を出力します。 "何でそう思うの?" 視覚的なキューと LLM 機能に基づいて、BLIP-2 出力 「これはアマゾンのサインです。」

- 画像テキストの取得 – 次のような質問があるとします 「画像上の文字」、画像テキストを抽出できます 「月曜日だけど笑っていてね」 右の図に示すように。

次の画像は、視覚的知識推論のゼロショット画像からテキストへの機能を示す例を示しています。

上記のさまざまな例からわかるように、マルチモダリティ モデルは、従来の単一モダリティ モデルでは対処が困難であった複雑な問題を解決するための新たな機会を開きます。

クリーンアップ

今後料金が発生しないようにするには、この投稿の一部として作成されたリソースを削除してください。 これを行うには、ノートブックのクリーンアップ セクションの指示に従って行うか、SageMaker コンソールを介して作成されたエンドポイントと S3 バケットに保存されているリソースを削除します。

まとめ

この投稿では、デジタル世界におけるコンテンツモデレーションの重要性について説明し、その課題に焦点を当てました。 私たちは、画像データによるコンテンツモデレーションを向上させ、画像に対して質問応答を実行して有用な情報を自動的に抽出する新しい方法を提案しました。 また、従来の分類ベースのアプローチと比較して、生成 AI ベースのアプローチを使用する利点についてもさらに説明しました。 最後に、コンテンツモデレーションを超えた視覚言語モデルの潜在的な使用例を示しました。

SageMaker を探索し、この投稿で提供されているマルチモダリティ ソリューションとビジネスに関連するデータセットを使用してソリューションを構築することで、さらに学習することをお勧めします。

著者について

ゴードン・ワン AWS のシニア AI/ML スペシャリスト TAM です。 彼は、さまざまな業界にわたる AI/ML のベスト プラクティスで戦略的な顧客をサポートしています。 彼はコンピューター ビジョン、NLP、生成 AI、MLOps に情熱を注いでいます。 余暇には、ランニングやハイキングが大好きです。

ゴードン・ワン AWS のシニア AI/ML スペシャリスト TAM です。 彼は、さまざまな業界にわたる AI/ML のベスト プラクティスで戦略的な顧客をサポートしています。 彼はコンピューター ビジョン、NLP、生成 AI、MLOps に情熱を注いでいます。 余暇には、ランニングやハイキングが大好きです。

ヤンウェイ・ツイ博士号は、AWS のシニア機械学習スペシャリスト ソリューション アーキテクトです。 IRISA (コンピューター サイエンスおよびランダム システム研究所) で機械学習の研究を開始し、コンピューター ビジョン、自然言語処理、オンライン ユーザー行動予測における AI を活用した産業用アプリケーションの構築に数年の経験があります。 AWS では、自身の専門知識を共有し、顧客がビジネスの可能性を解き放ち、大規模な機械学習によって実用的な成果を推進できるよう支援しています。 仕事以外では、読書と旅行を楽しんでいます。

ヤンウェイ・ツイ博士号は、AWS のシニア機械学習スペシャリスト ソリューション アーキテクトです。 IRISA (コンピューター サイエンスおよびランダム システム研究所) で機械学習の研究を開始し、コンピューター ビジョン、自然言語処理、オンライン ユーザー行動予測における AI を活用した産業用アプリケーションの構築に数年の経験があります。 AWS では、自身の専門知識を共有し、顧客がビジネスの可能性を解き放ち、大規模な機械学習によって実用的な成果を推進できるよう支援しています。 仕事以外では、読書と旅行を楽しんでいます。

メラニー・リー博士号は、オーストラリアのシドニーに拠点を置く AWS のシニア AI/ML スペシャリスト TAM です。 彼女は、企業顧客が AWS 上の最先端の AI/ML ツールを使用してソリューションを構築できるよう支援し、ベストプラクティスを使用した ML ソリューションの設計と実装に関するガイダンスを提供します。 余暇には、自然を探索したり、家族や友人と時間を過ごすのが大好きです。

メラニー・リー博士号は、オーストラリアのシドニーに拠点を置く AWS のシニア AI/ML スペシャリスト TAM です。 彼女は、企業顧客が AWS 上の最先端の AI/ML ツールを使用してソリューションを構築できるよう支援し、ベストプラクティスを使用した ML ソリューションの設計と実装に関するガイダンスを提供します。 余暇には、自然を探索したり、家族や友人と時間を過ごすのが大好きです。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 自動車/EV、 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- チャートプライム。 ChartPrime でトレーディング ゲームをレベルアップしましょう。 こちらからアクセスしてください。

- ブロックオフセット。 環境オフセット所有権の近代化。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :持っている

- :は

- :not

- :どこ

- $UP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 視聴者の38%が

- a

- できる

- 私たちについて

- 上記の.

- アクセス

- 従った

- 精度

- 達成する

- 達成する

- 俳優

- 実際の

- 追加されました

- 追加

- 添加

- NEW

- さらに

- 住所

- 付着

- 採用

- 養子縁組

- 利点

- 敵対者

- 広告業者

- 広告運用

- に対して

- AI

- AI電源

- AI / ML

- アルゴリズム

- アラインメント

- すべて

- ことができます

- また

- Amazon

- アマゾンセージメーカー

- Amazon SageMaker ジャンプスタート

- Amazon Webサービス

- an

- 分析します

- および

- 別の

- 回答

- 回答

- どれか

- 適用された

- アプローチ

- アプローチ

- 適切な

- 建築

- です

- AS

- 頼む

- 側面

- アシスタント

- 団体

- と仮定する

- At

- オーディオ

- オーストラリア

- 自動的に

- 利用できます

- 避ける

- AWS

- 悪い

- ベース

- BE

- (ダグラス・ビーチ)

- なぜなら

- になる

- になる

- 行動

- さ

- 以下

- ベンチマーク

- ほかに

- BEST

- ベストプラクティス

- 越えて

- 偏った

- 血

- ボディ

- 両言語で

- ブランド

- ブランド

- もたらす

- 広い

- 予算

- ビルド

- 建物

- ビジネス

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 呼ばれます

- 缶

- 取得することができます

- 機能

- 機能

- 注意深い

- 場合

- 例

- カテゴリ

- カテゴリー

- 挑戦する

- 課題

- 挑戦

- 変更

- 課金

- チャットボット

- 選択する

- クラス

- クリア

- クライアント

- 服

- コード

- コーディング

- 組み合わせる

- 組み合わせ

- コマーシャル

- コミュニティ

- コミュニティビルディング

- 会社

- 比べ

- コンプリート

- 複雑な

- コンポーネント

- コンポーネント

- コンピュータ

- コンピュータサイエンス

- Computer Vision

- コンピューター

- 確認します

- 接続する

- コネクト

- 考慮

- 見なさ

- からなる

- 領事

- 定数

- 絶えず

- 接触

- 含む

- コンテナ

- 含まれています

- コンテンツ

- コンテンツ作成

- 中身

- 貢献

- 従来の

- 会話

- 会話

- 基本

- 対応する

- 費用

- 高額で

- コスト

- 可能性

- カバー

- 作ります

- 作成した

- 創造

- 重大な

- Cross

- Customers

- カスタマイズ

- データ

- データセキュリティ

- データセット

- 決定

- 決定

- 深いです

- 定義します

- 定義済みの

- 実証します

- 実証

- 実証

- 展開します

- 記載された

- 説明

- 設計

- 設計

- 希望

- にもかかわらず

- 細部

- 検出

- 決定する

- 対話

- 異なります

- デジタル

- デジタルワールド

- 直接に

- 議論する

- 議論

- ディストリビューション

- 異なる

- do

- デッカー

- ありません

- ドメイン

- ドライブ

- 各

- 緩和する

- 簡単に

- 効果的に

- 有効

- 効率的な

- 埋め込み

- 登場

- 新興の

- 従業員

- enable

- 可能

- 奨励する

- end

- エンドポイント

- 強化

- 十分な

- 確保

- 確保する

- Enterprise

- エラー

- 特に

- 本質的な

- 例

- 例

- 既存の

- 体験

- 専門知識

- 説明する

- 説明

- 探る

- 探る

- 暴露

- 外部

- エキス

- 顔

- フォールズ

- 家族

- 特徴

- 特徴

- 女性

- 少数の

- より少ない

- フィールド

- 戦闘

- File

- ファイナル

- ファイナンス

- 名

- 初回

- フィット

- フラグが立てられた

- フォーカス

- フォロー中

- 次

- 形式でアーカイブしたプロジェクトを保存します.

- フォーム

- Foundation

- 周波数

- 友達

- から

- 凍結

- 機能

- さらに

- 未来

- 集める

- 生成する

- 生成された

- 生成

- 世代

- 生々しい

- 生成AI

- 取得する

- 与える

- 与えられた

- 素晴らしい

- 成長

- 成長性

- ガイダンス

- ハンドル

- が起こった

- ハード

- 持ってる

- 持って

- he

- 健康

- 健康情報

- ヘルスケア

- 重く

- 助けます

- ことができます

- 彼女の

- 隠されました

- ハイ

- ハイパフォーマンス

- 高品質

- 強調表示された

- 彼の

- host

- 主催

- ホスティング

- 認定条件

- How To

- HTML

- HTTP

- HTTPS

- 人間

- 識別する

- 識別

- アイデンティティ

- if

- 説明する

- 画像

- 画像

- 実装する

- 実装

- 実装

- import

- 重要性

- 重要

- 改善します

- 改善

- in

- 不正確

- include

- 含ま

- 含めて

- 増える

- 増加

- インダストリアル

- 産業

- 産業を変えます

- 非効率的な

- 情報

- 入力

- 機関

- 説明書

- 統合する

- 関心

- 内部

- に

- 紹介する

- IT

- ITS

- Java

- JPG

- JSON

- ただ

- キープ

- 知識

- ラベル

- 言語

- 大

- より大きい

- つながる

- 主要な

- LEARN

- 学習

- 左

- リーガルポリシー

- 負債

- 図書館

- 軽量

- リスト

- ラマ

- LLM

- より長いです

- で

- 機械

- 機械学習

- 保守

- make

- 作成

- man

- 管理します

- 手動で

- 多くの

- 材料

- 五月..

- me

- 意味

- メカニズム

- メディア

- Meta

- 方法

- メソッド

- 真ん中

- ML

- MLOps

- モデル

- 節度

- 修正されました

- モジュール

- 月曜日

- モニタリング

- 他には?

- もっと効率的

- 最も

- の試合に

- ナチュラル

- 自然言語処理

- 自然

- 必要

- 負

- 新作

- 次の

- NLP

- ノート

- 小説

- 今

- 数

- of

- 攻撃

- on

- かつて

- ONE

- オンライン

- の

- 開いた

- オープンソース

- 機会

- 最適化

- or

- 組織

- オリジナル

- その他

- 私たちの

- 当社

- 成果

- 優れた性能

- 出力

- 外側

- 圧倒

- 自分の

- パッケージ

- 並列シミュレーションの設定

- パラメータ

- 部

- 特に

- 部品

- パス

- 情熱的な

- パターン

- 実行する

- パフォーマンス

- 実行

- パーミッション

- 人

- 個人的な

- 人

- 視点

- 博士号

- 写真

- 極めて重要な

- プラットフォーム

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 演劇

- お願いします

- ポリシー

- 方針

- 貧しいです

- 人気

- ポスト

- 潜在的な

- ポテンシャル

- パワード

- 強力な

- プラクティス

- 予測

- 準備

- プレゼント

- 保全

- を防止

- 優先順位をつける

- プライバシー

- 問題

- プロセス

- 処理

- プログラミング

- 提案された

- 保護

- 提供します

- 提供

- は、大阪で

- 公共

- 宣伝

- 公然と

- 目的

- 置きます

- 質問と回答

- 品質

- クエリ

- 質問

- 質問

- ランダム

- リーディング

- 準備

- 理由

- 認識する

- 認識

- 減らします

- 定期的に

- 規制

- 関連する

- 関連した

- 頼る

- 削除済み

- 表現

- 代表者

- 評判

- 要求

- 必要とする

- 必要

- 研究

- リソース

- 反応します

- 応答

- 回答

- 結果

- 結果として

- 結果

- return

- 明らかにする

- 収入

- 収入の伸び

- RGB

- 右

- リスク

- リスク

- 職種

- 大体

- ルール

- ラン

- ランニング

- s

- 保護

- 安全性

- セージメーカー

- 規模

- 科学

- を検索

- 二番

- セクション

- セクション

- セクター

- セキュリティ

- 選択

- シニア

- 敏感な

- 仕える

- サービス

- サービス

- サービング

- セッションに

- いくつかの

- 性的な

- 株式

- シェアリング

- 彼女

- シールド

- 表示する

- 示されました

- 作品

- 符号

- 意義

- 著しく

- 同様に

- 簡単な拡張で

- 状況

- So

- 社会

- ソーシャルメディア

- ソーシャルメディアのプラットフォーム

- 溶液

- ソリューション

- 解決

- ソース

- ソースコード

- ソース

- スペース

- スペース

- スパム

- 専門家

- 特定の

- スピーチ

- 過ごす

- split

- ステージ

- ステージ

- スタンドアロン

- 規格

- 開始

- 最先端の

- 米国

- Status:

- 手順

- まだ

- ストレージ利用料

- 保存され

- 戦略的

- 構造化された

- 奮闘

- 研究

- 勉強

- そのような

- 示唆する

- サポート

- シドニー

- システム

- テーブル

- タックル

- 戦術

- 取り

- 仕事

- タスク

- チーム

- 言う

- template

- 条件

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- テキスト

- より

- それ

- 情報

- アプリ環境に合わせて

- そこ。

- それによって

- したがって、

- ボーマン

- 彼ら

- 考える

- 三番

- この

- 三

- 時間

- 時間がかかる

- 〜へ

- 豊富なツール群

- 伝統的な

- トレーニング

- 訓練された

- トレーニング

- トランス

- 旅行

- 2

- type

- 下

- わかる

- 理解する

- ユニーク

- ユニバーサル

- アンロック

- 更新しました

- 更新

- 支持する

- アップロード

- つかいます

- 使用事例

- ユーザー

- 操作方法

- ユーザーのプライバシー

- users

- 価値観

- 多様

- さまざまな

- 、

- ビデオ

- 違反

- ビジョン

- ボリューム

- ボリューム

- 仕方..

- 方法

- we

- ウェブ

- Webサービス

- ウェブサイト

- WELL

- この試験は

- いつ

- which

- なぜ

- 意志

- 以内

- 無し

- 言葉

- 仕事

- ワーキング

- 世界

- でしょう

- 年

- You

- あなたの

- ゼファーネット