アマゾンセージメーカー は、機械学習 (ML) インフラストラクチャとモデル展開オプションの幅広い選択肢を提供し、ML 推論のニーズを満たすのに役立ちます。 これはフルマネージド サービスであり、MLOps ツールと統合されているため、モデルのデプロイメントの拡張、推論コストの削減、本番環境でのモデルのより効果的な管理、運用負担の軽減に取り組むことができます。 SageMaker は複数の機能を提供します 推論オプション そのため、ワークロードに最適なオプションを選択できます。

新世代の CPU では、特殊な組み込み命令により、ML 推論のパフォーマンスが大幅に向上しています。 この投稿では、 AWS グラビトン 3ベースの Amazon Elastic Compute Cloud (EC2) C7g インスタンス 同等の EC50 インスタンスと比較して推論コストを最大 2% 削減できます。 リアルタイム推論 Amazon SageMaker で。 わずか数ステップで推論パフォーマンスを評価し、ML ワークロードを AWS Graviton インスタンスに切り替える方法を示します。

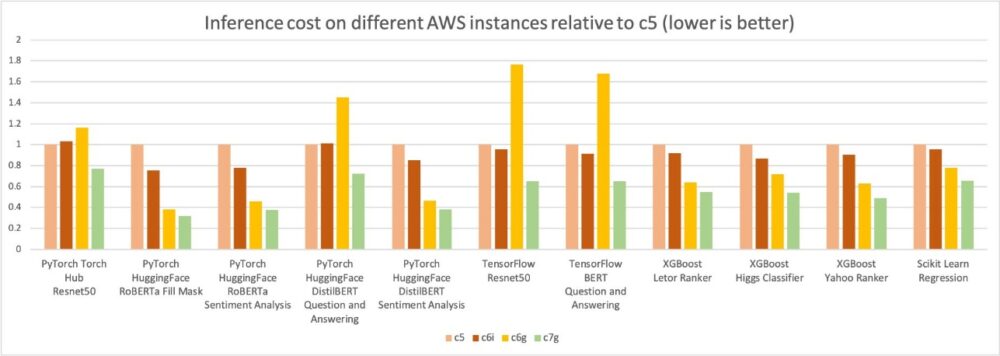

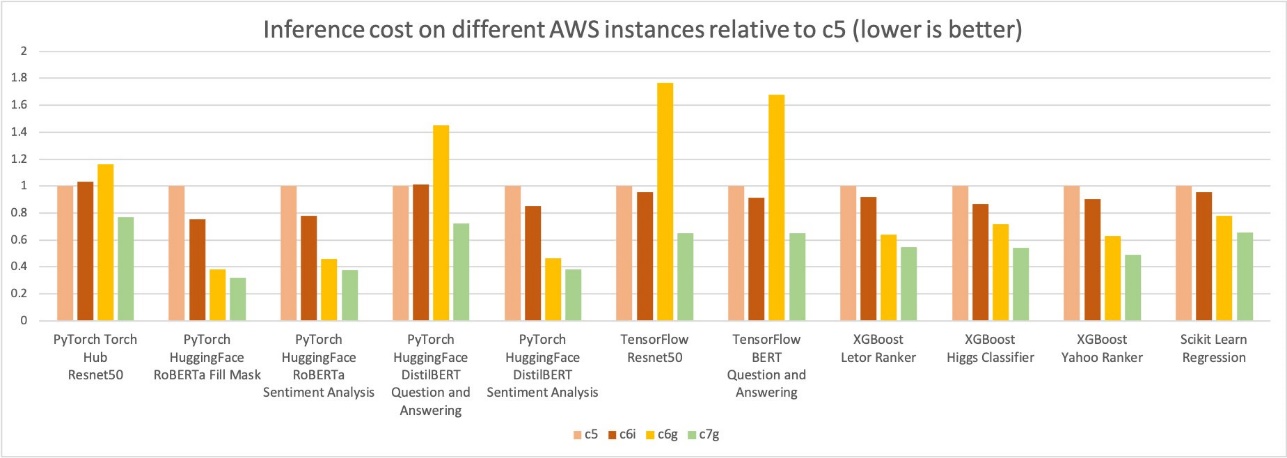

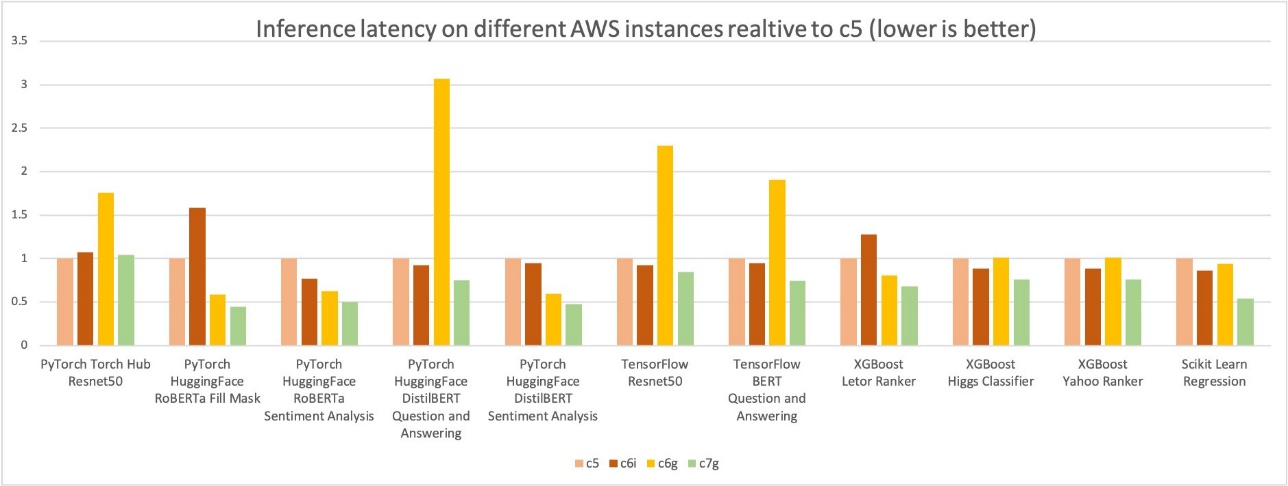

人気のある幅広い顧客アプリケーションをカバーするために、この投稿では、PyTorch、TensorFlow、XGBoost、および scikit-learn フレームワークの推論パフォーマンスについて説明します。 ベンチマーク用のモデルと ml.c6g、ml.c7g、ml.c5、ml.c6i SageMaker インスタンスのコンピューター ビジョン (CV)、自然言語処理 (NLP)、分類、およびランク付けのシナリオをカバーします。

ベンチマーク結果

AWS は、Amazon SageMaker 上の同等の EC50 インスタンスと比較して、AWS Graviton3 ベースの EC2 C7g インスタンスを使用した PyTorch、TensorFlow、XGBoost、および scikit-learn モデル推論で最大 2% のコスト削減を測定しました。 同時に、推論の待ち時間も短縮されます。

比較のために、XNUMX つの異なるインスタンス タイプを使用しました。

16 つのインスタンスすべてに 32 個の vCPU と XNUMX GiB のメモリが搭載されています。

次のグラフでは、5.4 つのインスタンス タイプの推論 1 万あたりのコストを測定しました。 さらに、7 万あたりの推論結果を c4xlarge インスタンスに正規化しました。これは、チャートの Y 軸で 3 として測定されます。 XGBoost モデルの場合、c50g.5.4xlarge (AWS Graviton40) の 6 万あたりのコストは、c4xlarge の約 30%、c50i.5xlarge の 6% であることがわかります。 PyTorch NLP モデルの場合、c4 および c30i.5xlarge インスタンスと比較してコストが約 6 ~ 4% 削減されます。 他のモデルとフレームワークでは、cXNUMX および cXNUMXi.XNUMXxlarge インスタンスと比較して少なくとも XNUMX% のコスト削減が測定されました。

前述の推論コストの比較グラフと同様に、次のグラフは同じ 90 つのインスタンス タイプのモデル p5.4 レイテンシを示しています。 さらに、レイテンシーの結果を c1xlarge インスタンスに正規化しました。これは、チャートの Y 軸で 7 として測定されます。 c4g.3xlarge (AWS Graviton50) モデルの推論レイテンシーは、c5.4xlarge および c6i.4xlarge で測定されたレイテンシーより最大 XNUMX% 優れています。

AWS Graviton インスタンスへの移行

モデルを AWS Graviton インスタンスにデプロイするには、次のいずれかを使用できます。 AWS深層学習コンテナ (DLC) または 自分の容器を持ってくる ARMv8.2 アーキテクチャと互換性があります。

AWS は PyTorch、TensorFlow、scikit-learn、XGBoost を使用してモデルをホストするためのコンテナを提供するだけでなく、モデルがアーキテクチャに依存しないため、AWS Graviton インスタンスへのモデルの移行 (または新規デプロイメント) は簡単です。 独自のライブラリを持ち込むこともできますが、コンテナが ARMv8.2 アーキテクチャをサポートする環境で構築されていることを確認してください。 詳細については、「」を参照してください。 独自のアルゴリズム コンテナの構築.

モデルをデプロイするには、次の XNUMX つの手順を完了する必要があります。

- SageMaker モデルを作成します。 これには、他のパラメーターの中でも、モデル ファイルの場所、デプロイメントに使用されるコンテナー、推論スクリプトの場所に関する情報が含まれます。 (既存のモデルがコンピューティング最適化推論インスタンスに既にデプロイされている場合は、この手順をスキップできます。)

- エンドポイント構成を作成します。 これには、エンドポイントに必要なインスタンスのタイプ (たとえば、AWS Graviton7 の ml.c3g.xlarge)、前のステップで作成したモデルの名前、およびエンドポイントごとのインスタンスの数に関する情報が含まれます。

- 前の手順で作成したエンドポイント構成を使用してエンドポイントを起動します。

詳細な手順については、を参照してください。 Amazon SageMaker を使用して AWS Graviton ベースのインスタンスで機械学習推論ワークロードを実行する

ベンチマーク方法論

我々は、使用 AmazonSageMaker推論レコメンダー さまざまなインスタンスにわたるパフォーマンスのベンチマークを自動化します。 このサービスは、さまざまなインスタンスのレイテンシとコストの観点から ML モデルのパフォーマンスを比較し、最小のコストで最高のパフォーマンスを提供するインスタンスと構成を推奨します。 Inference Recommender を使用して前述のパフォーマンス データを収集しました。 詳細については、を参照してください。 GitHubレポ.

あなたが使用することができます サンプルノート ベンチマークを実行して結果を再現します。 ベンチマークには次のモデルを使用しました。

まとめ

AWS は、Amazon SageMaker 上の同等の EC50 インスタンスと比較して、AWS Graviton3 ベースの EC2 C7g インスタンスを使用した PyTorch、TensorFlow、XGBoost、および scikit-learn モデル推論で最大 2% のコスト削減を測定しました。 この投稿で説明されている手順に従って、既存の推論ユースケースを移行したり、新しい ML モデルを AWS Graviton にデプロイしたりできます。 も参照できます。 AWS Graviton テクニカルガイドには、さまざまなワークロードにわたって AWS Graviton インスタンスを使用してコスト上のメリットを達成するのに役立つ、最適化されたライブラリとベストプラクティスのリストが記載されています。

AWS Graviton で同様のパフォーマンスの向上が観察されないユースケースを見つけた場合は、お問い合わせください。 AWS Graviton を最もコスト効率が高く効率的な ML 推論用の汎用プロセッサにするために、パフォーマンスの改善をさらに追加していきます。

著者について

スニタ・ナダンパリ AWS のソフトウェア開発マネージャーです。 彼女は、機械学習、HPC、マルチメディア ワークロードの Graviton ソフトウェア パフォーマンスの最適化を主導しています。 彼女はオープンソース開発と、Arm SoC を使用したコスト効率の高いソフトウェア ソリューションの提供に情熱を注いでいます。

スニタ・ナダンパリ AWS のソフトウェア開発マネージャーです。 彼女は、機械学習、HPC、マルチメディア ワークロードの Graviton ソフトウェア パフォーマンスの最適化を主導しています。 彼女はオープンソース開発と、Arm SoC を使用したコスト効率の高いソフトウェア ソリューションの提供に情熱を注いでいます。

ジェイミン・デサイ は、Amazon SageMaker Inference チームのソフトウェア開発エンジニアです。 彼は、AI を大衆に普及させ、最先端の AI 資産を機能やサービスとして製品化することでその使いやすさを向上させることに情熱を注いでいます。 自由時間には、音楽の探索や旅行を楽しんでいます。

ジェイミン・デサイ は、Amazon SageMaker Inference チームのソフトウェア開発エンジニアです。 彼は、AI を大衆に普及させ、最先端の AI 資産を機能やサービスとして製品化することでその使いやすさを向上させることに情熱を注いでいます。 自由時間には、音楽の探索や旅行を楽しんでいます。

マイク・シュナイダー アリゾナ州フェニックスに拠点を置くシステム開発者です。 彼は Deep Learning コンテナのメンバーであり、Graviton Inference を含むさまざまなフレームワーク コンテナ イメージをサポートしています。 彼はインフラストラクチャの効率と安定性に専念しています。

マイク・シュナイダー アリゾナ州フェニックスに拠点を置くシステム開発者です。 彼は Deep Learning コンテナのメンバーであり、Graviton Inference を含むさまざまなフレームワーク コンテナ イメージをサポートしています。 彼はインフラストラクチャの効率と安定性に専念しています。

モハンガンディー AWS のシニア ソフトウェア エンジニアです。 彼は過去 10 年間 AWS に勤務しており、EMR、EFA、RDS などのさまざまな AWS サービスに取り組んできました。 現在、彼は SageMaker Inference Experience の改善に重点を置いています。 余暇には、ハイキングやマラソンを楽しんでいます。

モハンガンディー AWS のシニア ソフトウェア エンジニアです。 彼は過去 10 年間 AWS に勤務しており、EMR、EFA、RDS などのさまざまな AWS サービスに取り組んできました。 現在、彼は SageMaker Inference Experience の改善に重点を置いています。 余暇には、ハイキングやマラソンを楽しんでいます。

チンウェイ・リー アマゾンウェブサービスの機械学習スペシャリストです。 彼は彼の博士号を受け取りました。 彼は顧問の研究助成金口座を破り、彼が約束したノーベル賞を授与することに失敗した後、オペレーションズリサーチで働いた。 現在、彼は金融サービスおよび保険業界のお客様がAWSで機械学習ソリューションを構築するのを支援しています。 趣味は読書と教えることです。

チンウェイ・リー アマゾンウェブサービスの機械学習スペシャリストです。 彼は彼の博士号を受け取りました。 彼は顧問の研究助成金口座を破り、彼が約束したノーベル賞を授与することに失敗した後、オペレーションズリサーチで働いた。 現在、彼は金融サービスおよび保険業界のお客様がAWSで機械学習ソリューションを構築するのを支援しています。 趣味は読書と教えることです。

ウェイン・トー AWS の Graviton のスペシャリスト ソリューション アーキテクトです。 彼は、顧客が大規模なコンテナ ワークロードに ARM アーキテクチャを導入できるよう支援することに重点を置いています。 AWS に入社する前は、ウェインは IBM や Red Hat などのいくつかの大手ソフトウェア ベンダーで働いていました。

ウェイン・トー AWS の Graviton のスペシャリスト ソリューション アーキテクトです。 彼は、顧客が大規模なコンテナ ワークロードに ARM アーキテクチャを導入できるよう支援することに重点を置いています。 AWS に入社する前は、ウェインは IBM や Red Hat などのいくつかの大手ソフトウェア ベンダーで働いていました。

ローレン・マレネックス コロラド州デンバーに拠点を置くソリューションアーキテクトです。顧客と協力して、AWS でのソリューションの構築を支援します。 余暇には、ハイキングやハワイ料理の料理を楽しんでいます。

ローレン・マレネックス コロラド州デンバーに拠点を置くソリューションアーキテクトです。顧客と協力して、AWS でのソリューションの構築を支援します。 余暇には、ハイキングやハワイ料理の料理を楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- プラトアイストリーム。 Web3 データ インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- 未来を鋳造する w エイドリエン・アシュリー。 こちらからアクセスしてください。

- PREIPO® を使用して PRE-IPO 企業の株式を売買します。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :持っている

- :は

- :not

- :どこ

- $UP

- 1

- 10

- 100

- 7

- 98

- a

- 私たちについて

- 達成する

- 越えて

- 加えます

- 採用

- 利点

- 後

- AI

- アルゴリズム

- 既に

- また

- Amazon

- アマゾンセージメーカー

- Amazon Webサービス

- 間で

- an

- および

- 建築

- です

- ARM

- AS

- 資産

- At

- 自動化する

- AWS

- ベース

- BE

- なぜなら

- き

- ベンチマーク

- ベンチマーク

- 利点

- BEST

- ベストプラクティス

- より良いです

- 持って来る

- 広い

- 壊れた

- ビルド

- 内蔵

- 内蔵

- 負担

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 缶

- 例

- チャート

- 分類

- クラウド

- CO

- 匹敵します

- 比べ

- 比較

- 互換性のあります

- コンプリート

- 計算

- コンピュータ

- Computer Vision

- 含む

- コンテナ

- コンテナ

- 続ける

- 費用

- コスト削減

- コスト効率の良い

- コスト

- カバー

- 作成した

- 現在

- 顧客

- Customers

- データ

- 専用の

- 深いです

- 深い学習

- 配信する

- 配信する

- デンバー

- 展開します

- 展開

- 展開

- 詳細な

- 細部

- Developer

- 開発

- 異なります

- 話し合います

- ありません

- 原因

- 効果的に

- 効率

- 効率的な

- どちら

- エンドポイント

- エンジニア

- 環境

- 評価する

- 例

- 既存の

- 体験

- 探る

- Failed:

- 特徴

- 少数の

- File

- ファイナンシャル

- 金融サービス

- もう完成させ、ワークスペースに掲示しましたか?

- フォーカス

- 焦点を当て

- 焦点を当てて

- フォロー中

- 4

- フレームワーク

- フレームワーク

- 無料版

- さらに

- 利益

- 一般的用途

- 世代

- 与える

- 助成金

- グラフ

- 持っています

- 持ってる

- he

- 助けます

- 助け

- ことができます

- 彼女の

- 彼の

- host

- 認定条件

- hpc

- HTML

- HTTPS

- IBM

- if

- 画像

- 改善

- 改善

- 改善

- in

- include

- 含めて

- 産業を変えます

- 情報

- インフラ関連事業

- 説明書

- 保険

- 統合する

- に

- 参加

- JPG

- ただ

- 言語

- 大

- 姓

- レイテンシ

- リード

- 学習

- 最低

- ライブラリ

- ような

- 好き

- リスト

- 場所

- 最低

- 機械

- 機械学習

- make

- 管理します

- マネージャー

- 大衆

- 大会

- メンバー

- メモリ

- 移動します

- 移行

- 百万

- ML

- MLOps

- モデル

- 他には?

- 最も

- マルチメディア

- の試合に

- 音楽を聴く際のスピーカーとして

- 名

- ナチュラル

- 自然言語処理

- 必要

- ニーズ

- 新作

- NLP

- ノーベル賞

- 数

- of

- 提供

- on

- の

- オープンソース

- オペレーショナル

- 業務執行統括

- 最適化

- オプション

- オプション

- or

- 注文

- その他

- でる

- 自分の

- パラメータ

- 情熱的な

- パフォーマンス

- フェニックス

- 選ぶ

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- お願いします

- 人気

- ポスト

- プラクティス

- 前

- 事前の

- 賞

- 処理

- プロセッサ

- 生産

- 約束された

- 提供します

- 提供

- は、大阪で

- パイトーチ

- 範囲

- ランキング

- リーチ

- リーディング

- 受け

- お勧めする

- レッド

- レッドハット

- 減らします

- 電話代などの費用を削減

- 研究

- 結果

- ラン

- セージメーカー

- SageMaker の推論

- 同じ

- 貯蓄

- 規模

- シナリオ

- scikit-学ぶ

- 選択

- シニア

- サービス

- サービス

- いくつかの

- 彼女

- 表示する

- 作品

- 重要

- 同様の

- So

- ソフトウェア

- ソフトウェア開発

- ソフトウェアエンジニア

- ソリューション

- 専門家

- 専門の

- 安定性

- 最先端の

- 手順

- ステップ

- 簡単な

- 支援する

- サポート

- スイッチ

- システム

- 取る

- 取得

- ティーチング

- チーム

- 技術的

- テンソルフロー

- 条件

- より

- それ

- 情報

- それら

- この

- 三

- 時間

- 〜へ

- 豊富なツール群

- 旅行

- type

- us

- 使いやすさ

- つかいます

- 中古

- さまざまな

- ベンダー

- ビジョン

- 欲しいです

- we

- ウェブ

- Webサービス

- WELL

- which

- 意志

- 仕事

- 働いていました

- 作品

- XGブースト

- 年

- You

- あなたの

- ゼファーネット