Szept OpenAI to zaawansowany model automatycznego rozpoznawania mowy (ASR) z licencją MIT. Technologia ASR znajduje zastosowanie w usługach transkrypcji, asystentach głosowych i zwiększaniu dostępności dla osób z wadami słuchu. Ten najnowocześniejszy model jest szkolony na rozległym i zróżnicowanym zestawie wielojęzycznych i wielozadaniowych nadzorowanych danych zebranych z Internetu. Wysoka dokładność i możliwości adaptacji sprawiają, że jest to cenny atut w szerokim zakresie zadań związanych z głosem.

W stale zmieniającym się krajobrazie uczenia maszynowego i sztucznej inteligencji, Amazon Sage Maker zapewnia kompleksowy ekosystem. SageMaker umożliwia badaczom danych, programistom i organizacjom opracowywanie, szkolenie, wdrażanie i zarządzanie modelami uczenia maszynowego na dużą skalę. Oferując szeroką gamę narzędzi i możliwości, upraszcza cały proces uczenia maszynowego, od wstępnego przetwarzania danych i opracowywania modeli po łatwe wdrażanie i monitorowanie. Przyjazny dla użytkownika interfejs SageMaker sprawia, że jest to kluczowa platforma pozwalająca uwolnić pełny potencjał sztucznej inteligencji, ustanawiając ją jako rewolucyjne rozwiązanie w dziedzinie sztucznej inteligencji.

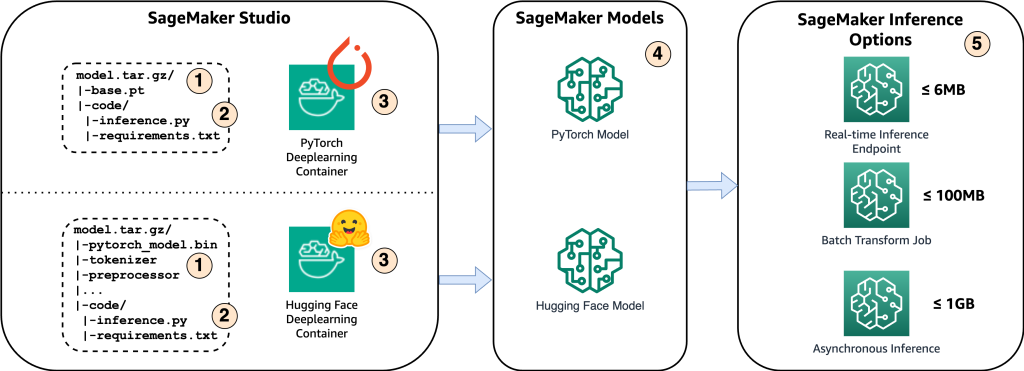

W tym poście rozpoczynamy eksplorację możliwości SageMaker, koncentrując się szczególnie na hostowaniu modeli Whisper. Zagłębimy się w dwie metody: jedna wykorzystująca model Whisper PyTorch, a druga wykorzystująca implementację modelu Whisper z Hugging Face. Dodatkowo przeprowadzimy dogłębną analizę opcji wnioskowania SageMaker, porównując je pod względem parametrów, takich jak szybkość, koszt, rozmiar ładunku i skalowalność. Analiza ta umożliwia użytkownikom podejmowanie świadomych decyzji podczas integrowania modeli Whisper z ich konkretnymi przypadkami użycia i systemami.

Omówienie rozwiązania

Poniższy diagram przedstawia główne elementy tego rozwiązania.

- Aby hostować model w Amazon SageMaker, pierwszym krokiem jest zapisanie artefaktów modelu. Artefakty te odnoszą się do podstawowych komponentów modelu uczenia maszynowego potrzebnych do różnych zastosowań, w tym do wdrażania i ponownego szkolenia. Mogą obejmować parametry modelu, pliki konfiguracyjne, komponenty do wstępnego przetwarzania, a także metadane, takie jak szczegóły wersji, autorstwo i wszelkie uwagi związane z jego działaniem. Należy zauważyć, że modele Whisper dla implementacji PyTorch i Hugging Face składają się z różnych artefaktów modelu.

- Następnie tworzymy niestandardowe skrypty wnioskowania. W ramach tych skryptów definiujemy sposób ładowania modelu i określamy proces wnioskowania. W razie potrzeby w tym miejscu możemy również uwzględnić parametry niestandardowe. Dodatkowo możesz wyświetlić listę wymaganych pakietów Pythona w pliku

requirements.txtplik. Podczas wdrażania modelu te pakiety Pythona są automatycznie instalowane w fazie inicjalizacji. - Następnie wybieramy kontenery głębokiego uczenia się (DLC) PyTorch lub Hugging Face dostarczone i obsługiwane przez AWS. Te kontenery to wstępnie skompilowane obrazy platformy Docker z platformami głębokiego uczenia się i innymi niezbędnymi pakietami języka Python. Aby uzyskać więcej informacji, możesz to sprawdzić link.

- Dzięki artefaktom modelu, niestandardowym skryptom wnioskowania i wybranym DLC stworzymy modele Amazon SageMaker odpowiednio dla PyTorch i Hugging Face.

- Wreszcie modele można wdrożyć w SageMaker i używać z następującymi opcjami: punkty końcowe wnioskowania w czasie rzeczywistym, zadania transformacji wsadowej i asynchroniczne punkty końcowe wnioskowania. Zajmiemy się tymi opcjami bardziej szczegółowo w dalszej części tego postu.

Przykładowy notatnik i kod do tego rozwiązania są dostępne na tym Repozytorium GitHub.

Rysunek 1. Przegląd kluczowych komponentów rozwiązania

Opis przejścia

Hostowanie modelu Whisper na Amazon SageMaker

W tej sekcji wyjaśnimy kroki hostowania modelu Whisper w Amazon SageMaker, używając odpowiednio PyTorch i Hugging Face Frameworks. Aby poeksperymentować z tym rozwiązaniem, potrzebujesz konta AWS i dostępu do usługi Amazon SageMaker.

Framework PyTorch

- Zapisz artefakty modelu

Pierwszą opcją hostowania modelu jest użycie Szepnij oficjalny pakiet Pythona, które można zainstalować za pomocą pip install openai-whisper. Ten pakiet zawiera model PyTorch. Podczas zapisywania artefaktów modelu w lokalnym repozytorium pierwszym krokiem jest zapisanie parametrów modelu, których można się nauczyć, takich jak wagi modelu i odchylenia każdej warstwy w sieci neuronowej, jako plik „pt”. Możesz wybierać spośród różnych rozmiarów modeli, w tym „mały”, „podstawowy”, „mały”, „średni” i „duży”. Większe rozmiary modeli zapewniają wyższą dokładność, ale kosztem dłuższych opóźnień wnioskowania. Ponadto należy zapisać słownik stanu modelu i słownik wymiarów, które zawierają słownik języka Python mapujący każdą warstwę lub parametr modelu PyTorch na odpowiadające mu parametry, których można się nauczyć, wraz z innymi metadanymi i niestandardowymi konfiguracjami. Poniższy kod pokazuje, jak zapisać artefakty Whisper PyTorch.

- Wybierz DLC

Następnym krokiem jest wybranie z tego gotowego DLC link. Zachowaj ostrożność przy wyborze prawidłowego obrazu, biorąc pod uwagę następujące ustawienia: framework (PyTorch), wersja frameworka, zadanie (wnioskowanie), wersja Pythona i sprzęt (tj. GPU). Jeśli to możliwe, zaleca się używanie najnowszych wersji frameworka i Pythona, ponieważ skutkuje to lepszą wydajnością i rozwiązuje znane problemy i błędy z poprzednich wydań.

- Twórz modele Amazon SageMaker

Następnie korzystamy z SageMaker SDK dla Pythona do tworzenia modeli PyTorch. Podczas tworzenia modelu PyTorch należy pamiętać o dodaniu zmiennych środowiskowych. Domyślnie TorchServe może przetwarzać tylko pliki o rozmiarze do 6 MB, niezależnie od użytego typu wnioskowania.

Poniższa tabela przedstawia ustawienia dla różnych wersji PyTorch:

| Framework | Zmienne środowiskowe |

| PyTorch 1.8 (oparty na TorchServe) | "TS_MAX_REQUEST_SIZE„: „100000000”" TS_MAX_RESPONSE_SIZE„: „100000000”" TS_DEFAULT_RESPONSE_TIMEOUT„: „1000” |

| PyTorch 1.4 (w oparciu o MMS) | "MMS_MAX_REQUEST_SIZE„: „1000000000”" MMS_MAX_RESPONSE_SIZE„: „1000000000”" MMS_DEFAULT_RESPONSE_TIMEOUT„: „900” |

- Zdefiniuj metodę ładowania modelu w pliku inference.py

W zwyczaju inference.py skrypt, najpierw sprawdzamy dostępność procesora graficznego obsługującego CUDA. Jeśli taki procesor graficzny jest dostępny, przypisujemy go 'cuda' urządzenie do DEVICE zmienny; w przeciwnym razie przypisujemy 'cpu' urządzenie. Ten krok gwarantuje, że model zostanie umieszczony na dostępnym sprzęcie w celu zapewnienia wydajnych obliczeń. Ładujemy model PyTorch za pomocą pakietu Whisper Python.

Ramy przytulania twarzy

- Zapisz artefakty modelu

Drugą opcją jest użycie Szept Przytulającej Twarzy realizacja. Model można załadować za pomocą metody AutoModelForSpeechSeq2Seq klasa transformatorów. Parametry, których można się nauczyć, są zapisywane w pliku binarnym (bin) przy użyciu formatu save_pretrained metoda. Tokenizator i preprocesor również należy zapisać osobno, aby zapewnić prawidłowe działanie modelu Hugging Face. Alternatywnie możesz wdrożyć model w Amazon SageMaker bezpośrednio z Hugging Face Hub, ustawiając dwie zmienne środowiskowe: HF_MODEL_ID i HF_TASK. Aby uzyskać więcej informacji, zapoznaj się z tym strona.

- Wybierz DLC

Podobnie jak w przypadku frameworku PyTorch, możesz wybrać z niego gotowe DLC Hugging Face link. Upewnij się, że wybierasz DLC, które obsługuje najnowsze transformatory Hugging Face i obsługuje procesor graficzny.

- Twórz modele Amazon SageMaker

Podobnie korzystamy z SageMaker SDK dla Pythona do tworzenia modeli Przytulonej Twarzy. Model Hugging Face Whisper ma domyślne ograniczenie, zgodnie z którym może przetwarzać tylko segmenty audio trwające do 30 sekund. Aby rozwiązać to ograniczenie, możesz uwzględnić chunk_length_s parametr w zmiennej środowiskowej podczas tworzenia modelu Hugging Face, a później przekazać ten parametr do niestandardowego skryptu wnioskowania podczas ładowania modelu. Na koniec ustaw zmienne środowiskowe, aby zwiększyć rozmiar ładunku i limit czasu odpowiedzi dla kontenera Hugging Face.

| Framework | Zmienne środowiskowe |

|

Kontener wnioskowania HuggingFace (na podstawie MMS-a) |

"MMS_MAX_REQUEST_SIZE„: „2000000000”" MMS_MAX_RESPONSE_SIZE„: „2000000000”" MMS_DEFAULT_RESPONSE_TIMEOUT„: „900” |

- Zdefiniuj metodę ładowania modelu w pliku inference.py

Tworząc niestandardowy skrypt wnioskowania dla modelu Hugging Face, wykorzystujemy potok, który pozwala nam przekazać chunk_length_s jako parametr. Ten parametr umożliwia modelowi wydajne przetwarzanie długich plików audio podczas wnioskowania.

Odkrywanie różnych opcji wnioskowania w Amazon SageMaker

Kroki wyboru opcji wnioskowania są takie same dla modeli PyTorch i Hugging Face, dlatego poniżej nie będziemy ich rozróżniać. Warto jednak zauważyć, że w chwili pisania tego postu wnioskowanie bezserwerowe opcja z SageMaker nie obsługuje procesorów graficznych, w związku z czym wykluczamy tę opcję w tym przypadku użycia.

Możemy wdrożyć model jako punkt końcowy w czasie rzeczywistym, zapewniając odpowiedzi w milisekundach. Należy jednak pamiętać, że ta opcja jest ograniczona do przetwarzania danych wejściowych o rozmiarze mniejszym niż 6 MB. Serializator definiujemy jako serializator audio, który odpowiada za konwersję danych wejściowych do formatu odpowiedniego dla wdrożonego modelu. Do wnioskowania wykorzystujemy instancję GPU, pozwalającą na przyspieszone przetwarzanie plików audio. Dane wejściowe wnioskowania to plik audio pochodzący z lokalnego repozytorium.

Drugą opcją wnioskowania jest zadanie transformacji wsadowej, które może przetwarzać ładunki wejściowe o rozmiarze do 100 MB. Jednak ta metoda może wymagać kilku minut opóźnienia. Każda instancja może obsłużyć tylko jedno żądanie wsadowe na raz, a inicjowanie i zamykanie instancji również wymaga kilku minut. Wyniki wnioskowania są zapisywane w usłudze Amazon Simple Storage Service (Amazon S3) wiadro po zakończeniu zadania transformacji wsadowej.

Konfigurując transformator wsadowy, pamiętaj o uwzględnieniu max_payload = 100 aby skutecznie obsługiwać większe ładunki. Danem wejściowym powinna być ścieżka Amazon S3 do pliku audio lub folder Amazon S3 Bucket zawierający listę plików audio, każdy o rozmiarze mniejszym niż 100 MB.

Batch Transform dzieli obiekty Amazon S3 na wejściu według klucza i mapuje obiekty Amazon S3 na instancje. Na przykład, jeśli masz wiele plików audio, jedna instancja może przetworzyć plik input1.wav, a inna instancja może przetworzyć plik o nazwie input2.wav, aby zwiększyć skalowalność. Batch Transform pozwala na konfigurację max_concurrent_transforms aby zwiększyć liczbę żądań HTTP kierowanych do każdego indywidualnego kontenera transformatora. Należy jednak pamiętać, że wartość (max_concurrent_transforms* max_payload) nie może przekraczać 100 MB.

Wreszcie, wnioskowanie asynchroniczne Amazon SageMaker idealnie nadaje się do jednoczesnego przetwarzania wielu żądań, oferując umiarkowane opóźnienia i obsługując ładunki wejściowe do 1 GB. Ta opcja zapewnia doskonałą skalowalność, umożliwiając konfigurację grupy autoskalowania dla punktu końcowego. Kiedy pojawia się gwałtowny wzrost liczby żądań, następuje automatyczne skalowanie w górę, aby obsłużyć ruch, a po przetworzeniu wszystkich żądań punkt końcowy skaluje się w dół do 0, aby zaoszczędzić koszty.

Korzystając z wnioskowania asynchronicznego, wyniki są automatycznie zapisywane w zasobniku Amazon S3. w AsyncInferenceConfig, możesz skonfigurować powiadomienia o pomyślnym lub nieudanym ukończeniu. Ścieżka wejściowa wskazuje lokalizację pliku audio w Amazon S3. Więcej informacji można znaleźć w kodzie na GitHub.

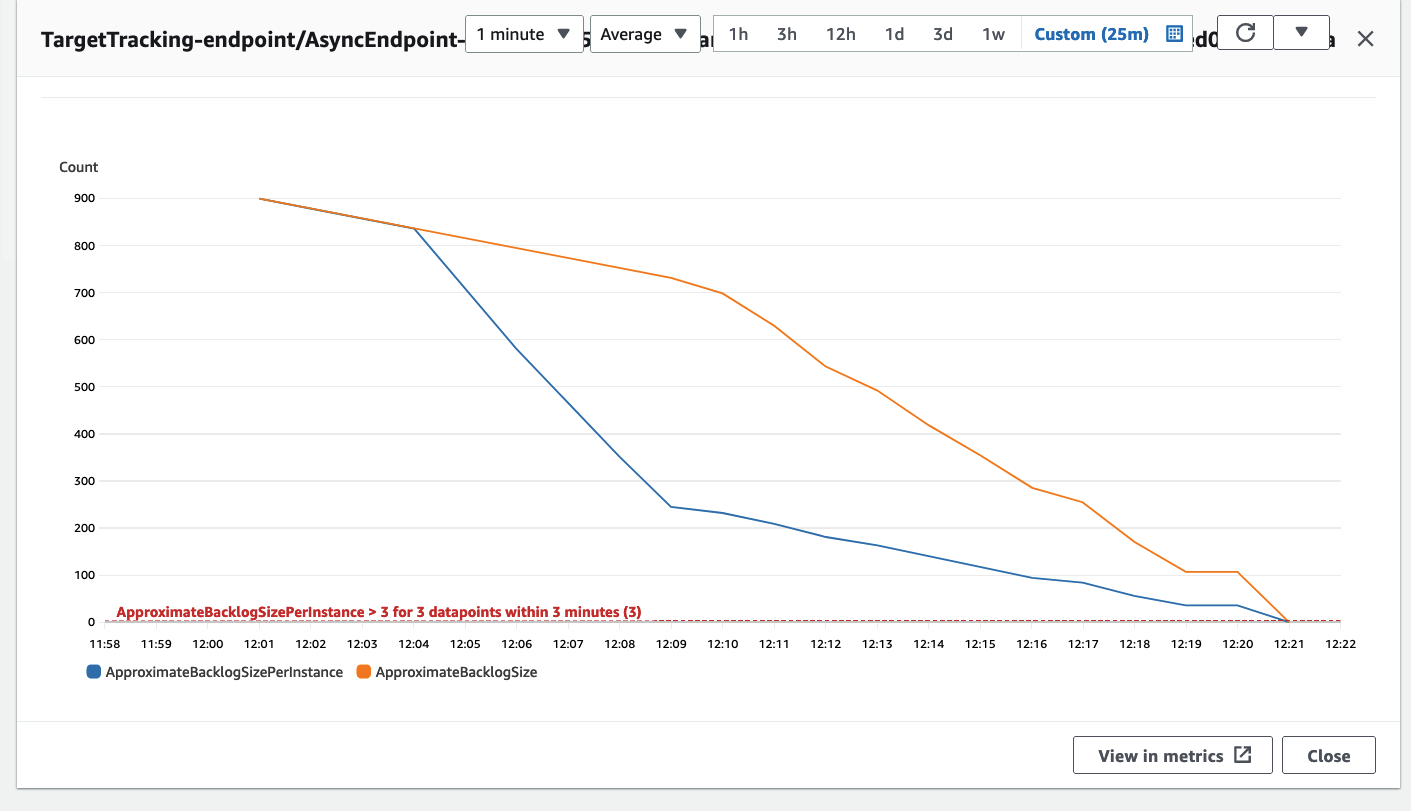

Opcjonalny: Jak wspomniano wcześniej, mamy możliwość skonfigurowania grupy autoskalowania dla asynchronicznego punktu końcowego wnioskowania, co pozwala mu obsłużyć nagły wzrost liczby żądań wnioskowania. Przykładowy kod znajduje się w this Repozytorium GitHub. Na poniższym diagramie można zaobserwować wykres liniowy przedstawiający dwie metryki Amazon Cloud Watch: ApproximateBacklogSize i ApproximateBacklogSizePerInstance. Początkowo, gdy wyzwolono 1000 żądań, dostępna była tylko jedna instancja do obsługi wnioskowania. Przez trzy minuty rozmiar zaległości stale przekraczał trzy (należy pamiętać, że te liczby można skonfigurować), a grupa autoskalowania zareagowała, uruchamiając dodatkowe instancje, aby skutecznie usunąć zaległości. Spowodowało to znaczny spadek ww ApproximateBacklogSizePerInstance, co pozwala na znacznie szybsze przetwarzanie żądań dotyczących zaległości w porównaniu z fazą początkową.

Rysunek 2. Wykres liniowy ilustrujący czasowe zmiany wskaźników Amazon CloudWatch

Analiza porównawcza opcji wnioskowania

Porównania różnych opcji wnioskowania opierają się na typowych przypadkach użycia przetwarzania dźwięku. Wnioskowanie w czasie rzeczywistym zapewnia najszybszą prędkość wnioskowania, ale ogranicza rozmiar ładunku do 6 MB. Ten typ wnioskowania jest odpowiedni dla systemów poleceń dźwiękowych, w których użytkownicy sterują urządzeniami lub oprogramowaniem lub wchodzą z nimi w interakcję za pomocą poleceń głosowych lub instrukcji mówionych. Polecenia głosowe mają zazwyczaj niewielki rozmiar, a niskie opóźnienie wnioskowania ma kluczowe znaczenie, aby transkrybowane polecenia mogły szybko wywołać kolejne działania. Batch Transform jest idealny do zaplanowanych zadań offline, gdy rozmiar każdego pliku audio jest mniejszy niż 100 MB i nie ma szczególnych wymagań dotyczących szybkiego czasu reakcji wnioskowania. Wnioskowanie asynchroniczne umożliwia przesyłanie danych o wielkości do 1 GB i zapewnia umiarkowane opóźnienia w wnioskowaniu. Ten typ wnioskowania doskonale nadaje się do transkrypcji filmów, seriali telewizyjnych i nagranych konferencji, w przypadku których należy przetworzyć większe pliki audio.

Zarówno opcje wnioskowania w czasie rzeczywistym, jak i asynchroniczne zapewniają możliwości automatycznego skalowania, umożliwiając instancjom punktów końcowych automatyczne skalowanie w górę lub w dół w zależności od liczby żądań. W przypadku braku żądań autoskalowanie usuwa niepotrzebne instancje, pomagając uniknąć kosztów związanych z instancjami udostępnionymi, które nie są aktywnie używane. Jednak do wnioskowania w czasie rzeczywistym należy zachować co najmniej jedną trwałą instancję, co może prowadzić do wyższych kosztów, jeśli punkt końcowy działa nieprzerwanie. Natomiast wnioskowanie asynchroniczne umożliwia zmniejszenie woluminu instancji do 0, gdy nie jest ona używana. Podczas konfigurowania zadania transformacji wsadowej można użyć wielu instancji do przetworzenia zadania i dostosować parametr max_concurrent_transforms, aby umożliwić jednej instancji obsługę wielu żądań. Dlatego wszystkie trzy opcje wnioskowania oferują dużą skalowalność.

Sprzątanie

Po zakończeniu korzystania z rozwiązania pamiętaj o usunięciu punktów końcowych SageMaker, aby zapobiec ponoszeniu dodatkowych kosztów. Dostarczonego kodu można użyć do usunięcia odpowiednio punktów końcowych wnioskowania w czasie rzeczywistym i asynchronicznych.

Wnioski

W tym poście pokazaliśmy, jak wdrażanie modeli uczenia maszynowego do przetwarzania dźwięku staje się coraz bardziej istotne w różnych branżach. Biorąc za przykład model Whisper, zademonstrowaliśmy, jak hostować modele ASR typu open source w Amazon SageMaker przy użyciu podejścia PyTorch lub Hugging Face. Eksploracja objęła różne opcje wnioskowania w aplikacji Amazon SageMaker, oferując wgląd w efektywne przetwarzanie danych audio, dokonywanie prognoz i efektywne zarządzanie kosztami. Celem tego postu jest dostarczenie wiedzy badaczom, programistom i badaczom danych zainteresowanym wykorzystaniem modelu Whisper do zadań związanych z dźwiękiem i podejmowaniem świadomych decyzji dotyczących strategii wnioskowania.

Aby uzyskać bardziej szczegółowe informacje na temat wdrażania modeli w SageMaker, zapoznaj się z tym Przewodnik programisty. Dodatkowo model Whisper można wdrożyć za pomocą SageMaker JumpStart. Aby uzyskać dodatkowe informacje, prosimy sprawdzić Modele szeptów do automatycznego rozpoznawania mowy są teraz dostępne w Amazon SageMaker JumpStart stanowisko.

Zapraszam do zapoznania się z notatnikiem i kodem tego projektu na stronie GitHub i podziel się z nami swoim komentarzem.

O autorze

Doktor Ying Hou, jest architektem prototypowania opartym na uczeniu maszynowym w AWS. Jej główne obszary zainteresowań obejmują głębokie uczenie się, ze szczególnym uwzględnieniem GenAI, widzenia komputerowego, NLP i przewidywania danych szeregów czasowych. W wolnym czasie lubi spędzać wartościowe chwile z rodziną, zagłębiając się w powieściach i spacerując po parkach narodowych Wielkiej Brytanii.

Doktor Ying Hou, jest architektem prototypowania opartym na uczeniu maszynowym w AWS. Jej główne obszary zainteresowań obejmują głębokie uczenie się, ze szczególnym uwzględnieniem GenAI, widzenia komputerowego, NLP i przewidywania danych szeregów czasowych. W wolnym czasie lubi spędzać wartościowe chwile z rodziną, zagłębiając się w powieściach i spacerując po parkach narodowych Wielkiej Brytanii.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/host-the-whisper-model-on-amazon-sagemaker-exploring-inference-options/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 12

- 14

- 140

- 16

- 19

- 30

- 32

- 7

- 8

- 900

- a

- przyśpieszony

- dostęp

- dostępność

- Konto

- precyzja

- w poprzek

- działania

- aktywnie

- Dodaj

- Dodatkowy

- do tego

- adres

- zaawansowany

- AI

- Cele

- Wszystkie kategorie

- Pozwalać

- pozwala

- wzdłuż

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- an

- analiza

- i

- Inne

- każdy

- aplikacje

- awanse

- SĄ

- obszary

- Szyk

- sztuczny

- sztuczna inteligencja

- AS

- kapitał

- asystenci

- powiązany

- At

- audio

- Autorstwo

- automatycznie

- automatycznie

- dostępność

- dostępny

- uniknąć

- AWS

- baza

- na podstawie

- BE

- stają się

- poniżej

- Ulepsz Swój

- pomiędzy

- uprzedzenia

- BIN

- obie

- błędy

- ale

- by

- CAN

- możliwości

- zdolny

- ostrożny

- Etui

- Zmiany

- Wykres

- ZOBACZ

- Dodaj

- Wybierając

- klasa

- jasny

- kod

- jak

- komentarz

- wspólny

- porównanie

- porównania

- Zakończony

- ukończenia

- składniki

- wszechstronny

- obliczenia

- komputer

- Wizja komputerowa

- Prowadzenie

- konferencje

- systemu

- skonfigurowany

- konfigurowanie

- wobec

- konsekwentnie

- zawierać

- Pojemnik

- Pojemniki

- bez przerwy

- kontrast

- kontrola

- 轉換

- skorygowania

- Odpowiedni

- Koszty:

- Koszty:

- mógłby

- Stwórz

- Tworzenie

- istotny

- zwyczaj

- dane

- Decyzje

- spadek

- głęboko

- głęboka nauka

- Domyślnie

- określić

- wykazać

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- detal

- szczegółowe

- detale

- rozwijać

- deweloperzy

- oprogramowania

- urządzenie

- urządzenia

- różne

- różnicować

- Wymiary

- bezpośrednio

- wyświetlanie

- nurkować

- inny

- Doker

- Nie

- robi

- na dół

- podczas

- e

- każdy

- Wcześniej

- Ekosystem

- faktycznie

- wydajny

- skutecznie

- łatwy

- bądź

- więcej

- zaokrętować

- upoważnia

- umożliwiać

- Umożliwia

- umożliwiając

- objąć

- obejmowała

- Punkt końcowy

- wzmacniać

- wzmocnienie

- zapewnić

- zapewnia

- Cały

- Środowisko

- niezbędny

- ustanowienie

- przykład

- przekraczać

- prace

- doskonała

- eksperyment

- Wyjaśniać

- eksploracja

- Exploring

- Twarz

- Failed

- fałszywy

- członków Twojej rodziny

- FAST

- szybciej

- najszybszy

- kilka

- filet

- Akta

- znajduje

- i terminów, a

- Skupiać

- skupienie

- następujący

- W razie zamówieenia projektu

- format

- Framework

- Ramy

- Darmowy

- od

- pełny

- GPU

- GPU

- wspaniały

- Zarządzanie

- uchwyt

- Prowadzenie

- sprzęt komputerowy

- Have

- przesłuchanie

- pomoc

- jej

- Wysoki

- wyższy

- gospodarz

- Hosting

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- Piasta

- Przytulanie twarzy

- i

- idealny

- if

- ilustrujące

- obraz

- zdjęcia

- realizacja

- wdrożenia

- importować

- ważny

- in

- informacje

- zawierać

- obejmuje

- Włącznie z

- włączać

- Zwiększać

- coraz bardziej

- indywidualny

- osób

- przemysłowa

- Informacja

- poinformowany

- początkowy

- początkowo

- inicjacja

- wkład

- Wejścia

- spostrzeżenia

- zainstalować

- zainstalowany

- przykład

- instrukcje

- Integracja

- Inteligencja

- interakcji

- odsetki

- zainteresowany

- Interfejs

- najnowszych

- problemy

- IT

- JEGO

- Praca

- Oferty pracy

- jpg

- Klawisz

- wiedza

- znany

- krajobraz

- większe

- w końcu

- Utajenie

- później

- firmy

- warstwa

- prowadzić

- nauka

- najmniej

- lewarowanie

- Licencja

- ograniczenie

- Ograniczony

- Linia

- Lista

- załadować

- załadunek

- miejscowy

- lokalizacja

- długo

- dłużej

- niski

- maszyna

- uczenie maszynowe

- zrobiony

- Główny

- robić

- WYKONUJE

- Dokonywanie

- zarządzanie

- zarządzający

- Mapy

- Może..

- wzmiankowany

- Metadane

- metoda

- metody

- Metryka

- może

- milisekund

- minut

- MIT

- ML

- model

- modele

- umiarkowanego

- Chwile

- monitorowanie

- jeszcze

- Kino

- dużo

- wielokrotność

- musi

- O imieniu

- narodowy

- niezbędny

- Potrzebować

- potrzebne

- sieć

- nerwowy

- sieci neuronowe

- Następny

- nlp

- Nie

- noty

- notatnik

- Uwagi

- powiadomienie

- Powiadomienia

- Zauważając

- już dziś

- numer

- z naszej

- przedmiot

- obiekty

- obserwować

- of

- oferta

- oferuje

- Oferty

- urzędnik

- nieaktywny

- on

- pewnego razu

- ONE

- tylko

- open source

- działa

- Option

- Opcje

- or

- zamówienie

- organizacji

- OS

- Inne

- Inaczej

- na zewnątrz

- przegląd

- pakiet

- Pakiety

- parametr

- parametry

- przechodzić

- ścieżka

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- faza

- rurociąg

- kluczowy

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- zwrotnica

- możliwy

- Post

- potencjał

- przepowiednia

- Przewidywania

- zapobiec

- poprzedni

- pierwotny

- wygląda tak

- Obrobiony

- przetwarzanie

- Procesor

- projekt

- prawidłowo

- prototypowanie

- zapewniać

- pod warunkiem,

- zapewnia

- że

- Python

- płomień

- jakość

- zasięg

- w czasie rzeczywistym

- królestwo

- uznanie

- Zalecana

- nagrany

- Zredukowany

- odnosić się

- Bez względu

- związane z

- prasowe

- pamiętać

- usunąć

- usuwa

- składnica

- zażądać

- wywołań

- wymagać

- wymagany

- wymaganie

- Badacze

- odpowiednio

- odpowiedź

- Odpowiedzi

- odpowiedzialny

- dalsze

- Efekt

- powrót

- sagemaker

- taki sam

- Zapisz

- zapisywane

- oszczędność

- Skalowalność

- Skala

- waga

- zaplanowane

- Naukowcy

- scenariusz

- skrypty

- druga

- sekund

- Sekcja

- Segmenty

- wybierać

- wybrany

- wybierając

- Serie

- usługa

- Usługi

- zestaw

- ustawienie

- w panelu ustawień

- Share

- ona

- powinien

- pokazał

- Targi

- zamknięcie

- znaczący

- Prosty

- upraszcza

- Rozmiar

- rozmiary

- mały

- mniejszy

- So

- Tworzenie

- rozwiązanie

- specyficzny

- swoiście

- określony

- przemówienie

- Rozpoznawanie mowy

- prędkość

- Spędzanie

- mówiony

- początek

- Stan

- state-of-the-art

- Ewolucja krok po kroku

- Cel

- przechowywanie

- strategie

- kolejny

- udany

- taki

- nagły

- odpowiedni

- wsparcie

- Wspierający

- podpory

- pewnie

- powstaje

- systemy

- stół

- Brać

- biorąc

- Zadanie

- zadania

- Technologia

- niż

- że

- Połączenia

- UK

- ich

- Im

- następnie

- Tam.

- w związku z tym

- Te

- one

- to

- trzy

- czas

- Szereg czasowy

- czasy

- do

- narzędzia

- pochodnia

- ruch drogowy

- Pociąg

- przeszkolony

- Przekształcać

- transformator

- Transformatory

- wyzwalać

- rozsierdzony

- tv

- drugiej

- rodzaj

- zazwyczaj

- Uk

- dla

- odblokowywanie

- niepotrzebny

- na

- us

- posługiwać się

- używany

- łatwy w obsłudze

- Użytkownicy

- za pomocą

- użyteczność

- wykorzystać

- Wykorzystując

- Cenny

- wartość

- zmienna

- różnorodny

- Naprawiono

- wersja

- Wersje

- wizja

- Głos

- Tom

- czekać

- chcieć

- była

- we

- sieć

- usługi internetowe

- DOBRZE

- były

- jeśli chodzi o komunikację i motywację

- ilekroć

- który

- Szept

- szeroki

- Szeroki zasięg

- w

- w ciągu

- workflow

- działa

- wartość

- pisanie

- You

- Twój

- zefirnet