本日、Technology Innovation Institute (TII) によって開発され、Amazon SageMaker でトレーニングされた Falcon 180B 基礎モデルが、以下を通じてお客様に提供されることを発表できることを嬉しく思います。 Amazon SageMaker ジャンプスタート ワンクリックでデプロイして推論を実行できます。 Falcon 180B は、パラメータ サイズが 3.5 億で、180 兆トークンの大規模なデータセットでトレーニングされた、オープンにアクセス可能な重みを備えた最大かつ最もパフォーマンスの高いモデルの 180 つです。 このモデルを SageMaker JumpStart で試すことができます。SageMaker JumpStart は、アルゴリズム、モデル、ML ソリューションへのアクセスを提供する機械学習 (ML) ハブであり、ML をすぐに始めることができます。 この投稿では、SageMaker JumpStart を介して Falcon XNUMXB モデルを検出してデプロイする方法を説明します。

ファルコン180Bとは

Falcon 180Bは、から発売されたモデルです。 IIT これは、Falcon ファミリーの以前のリリースに続くものです。 これは Falcon 40B のスケールアップ バージョンであり、スケーラビリティを向上させるためにマルチクエリ アテンションを使用します。 これは、最適化されたトランスフォーマー アーキテクチャを使用する自動回帰言語モデルです。 これは、主に次の Web データで構成される 3.5 兆 XNUMX 億のデータ トークンでトレーニングされました。 洗練されたウェブ (約85%)。 このモデルには、180B と 180B-Chat の 180 つのバージョンがあります。 180B は未加工の事前トレーニング済みモデルであり、ほとんどのユースケースに合わせてさらに微調整する必要があります。 XNUMXB-Chat は、一般的な指示を受けるのに適しています。 チャット モデルは、チャットと指示のデータセットといくつかの大規模な会話データセットで微調整されています。

モデルは以下で利用可能です Falcon-180B TII ライセンス および Acceptable Use Policy.

ファルコン 180B は TII によって訓練されました。 アマゾンセージメーカー、約 4K A100 GPU のクラスター上にあります。 これは、ZeRO との 3D 並列処理を使用する Gigatron という名前のカスタム分散トレーニング コードベースと、カスタムの高性能 Triton カーネルを使用しました。 使用される分散トレーニング アーキテクチャ Amazon シンプル ストレージ サービス (Amazon S3) は、データのロードとチェックポイントの書き込みと読み取りのための唯一の統合サービスであり、特にワークロードの信頼性と運用の簡素化に貢献しました。

SageMaker JumpStart とは

SageMaker JumpStart を使用すると、ML 実践者は、増え続ける最高のパフォーマンスの基盤モデルのリストから選択できます。 ML 実践者は、ネットワーク分離された環境内の専用の SageMaker インスタンスに基盤モデルをデプロイし、モデルのトレーニングとデプロイのために Amazon SageMaker を使用してモデルをカスタマイズできます。

数回クリックするだけで Falcon 180B を検出して展開できるようになりました。 Amazon SageMakerスタジオ または、SageMaker Python SDK を介してプログラム的に、次のような SageMaker 機能を使用してモデルのパフォーマンスと MLOps コントロールを導き出すことができます。 AmazonSageMakerパイプライン, Amazon SageMakerデバッガ、またはコンテナーのログ。 モデルは AWS の安全な環境にデプロイされ、VPC の制御下に置かれるため、データのセキュリティが確保されます。 Falcon 180B は検出可能であり、必要なインスタンスが利用可能なリージョンにデプロイできます。 現在、ml.p4de インスタンスは米国東部 (バージニア北部) と米国西部 (オレゴン) で利用できます。

モデルを発見する

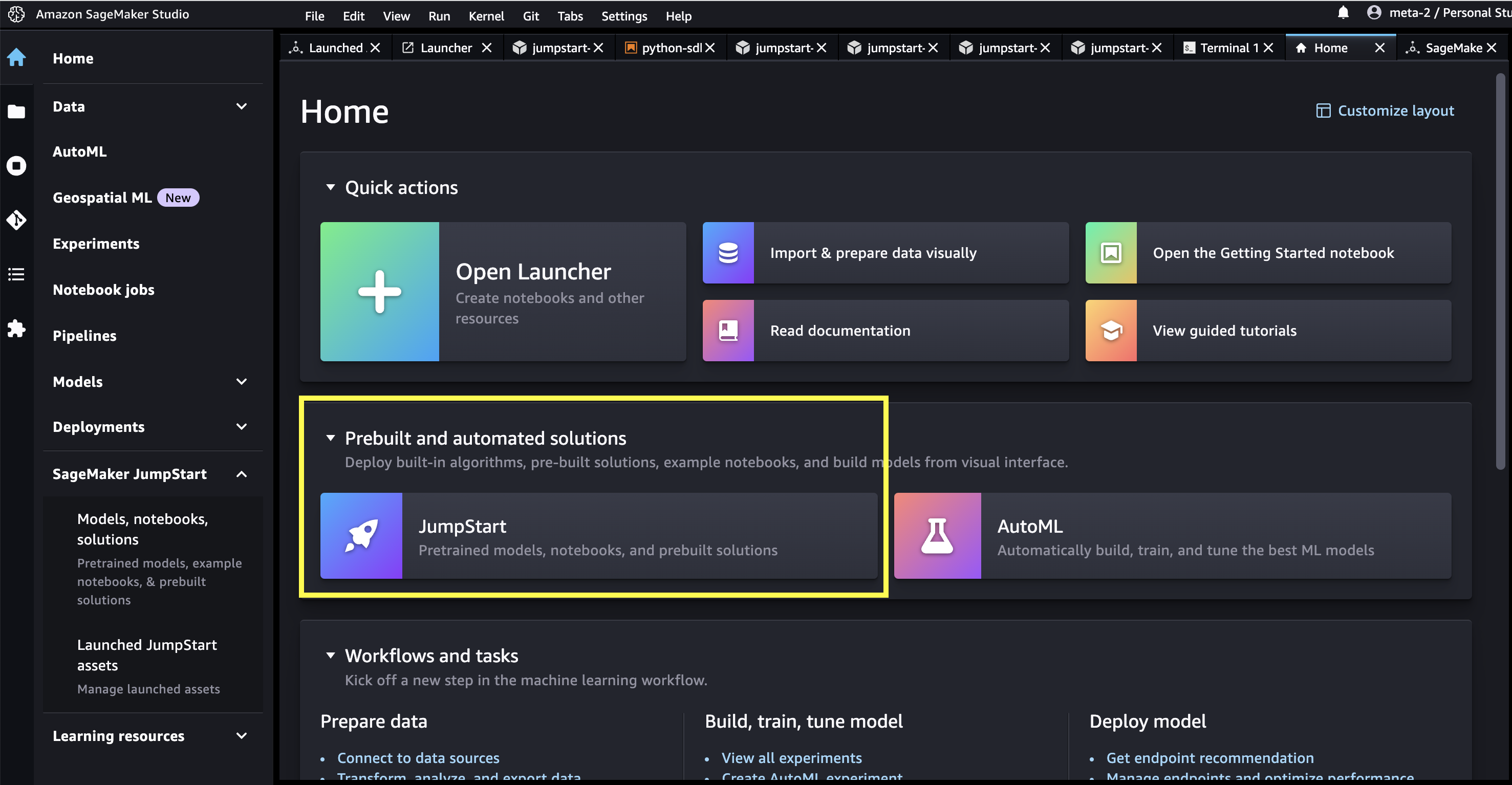

基礎モデルには、SageMaker Studio UI の SageMaker JumpStart および SageMaker Python SDK を通じてアクセスできます。 このセクションでは、SageMaker Studio でモデルを検出する方法について説明します。

SageMaker Studio は、単一の Web ベースのビジュアル インターフェイスを提供する統合開発環境 (IDE) であり、専用ツールにアクセスして、データの準備から ML モデルの構築、トレーニング、デプロイまで、すべての ML 開発ステップを実行できます。 SageMaker Studio の開始方法とセットアップ方法の詳細については、以下を参照してください。 Amazon SageMakerスタジオ.

SageMaker Studio では、事前トレーニングされたモデル、ノートブック、事前構築されたソリューションを含む SageMaker JumpStart にアクセスできます。 事前に構築された自動化されたソリューション.

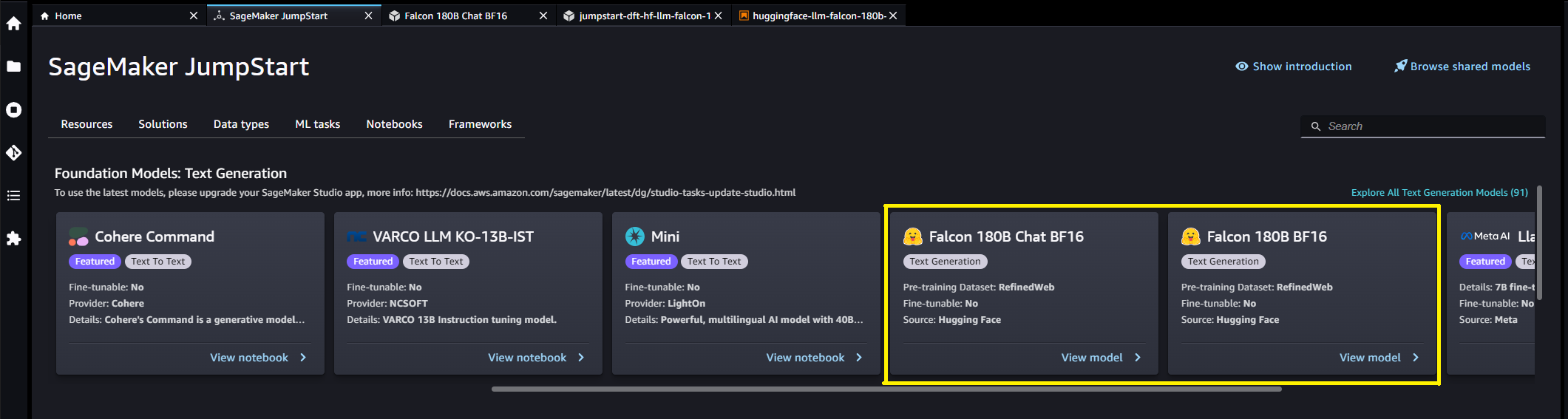

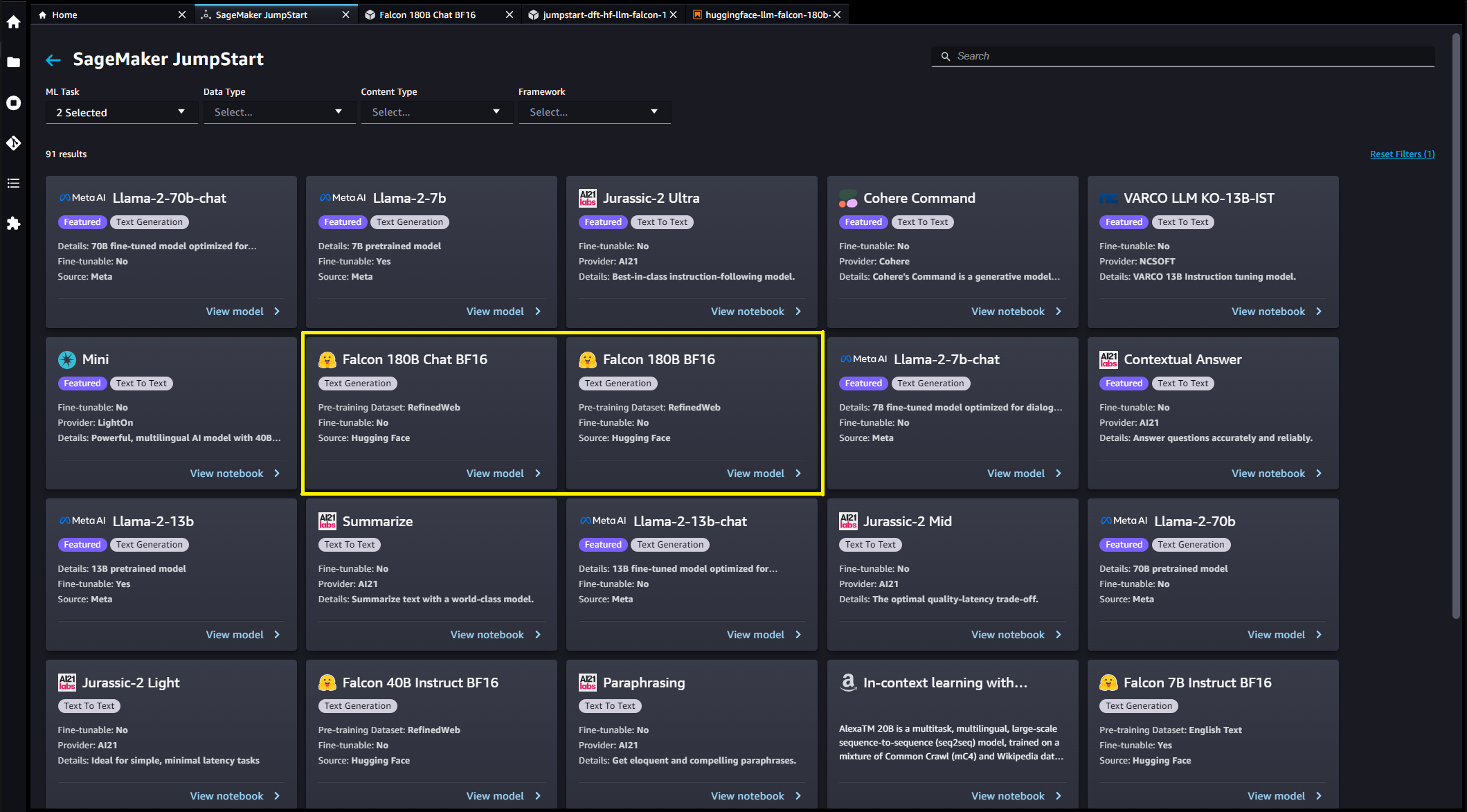

SageMaker JumpStart ランディング ページから、ソリューション、モデル、ノートブック、その他のリソースを参照できます。 Falcon 180B は、 基礎モデル: テキスト生成 カルーセル

を選択して、他のモデル バリエーションを見つけることもできます。 すべてのテキスト生成モデルを調べる または検索 Falcon.

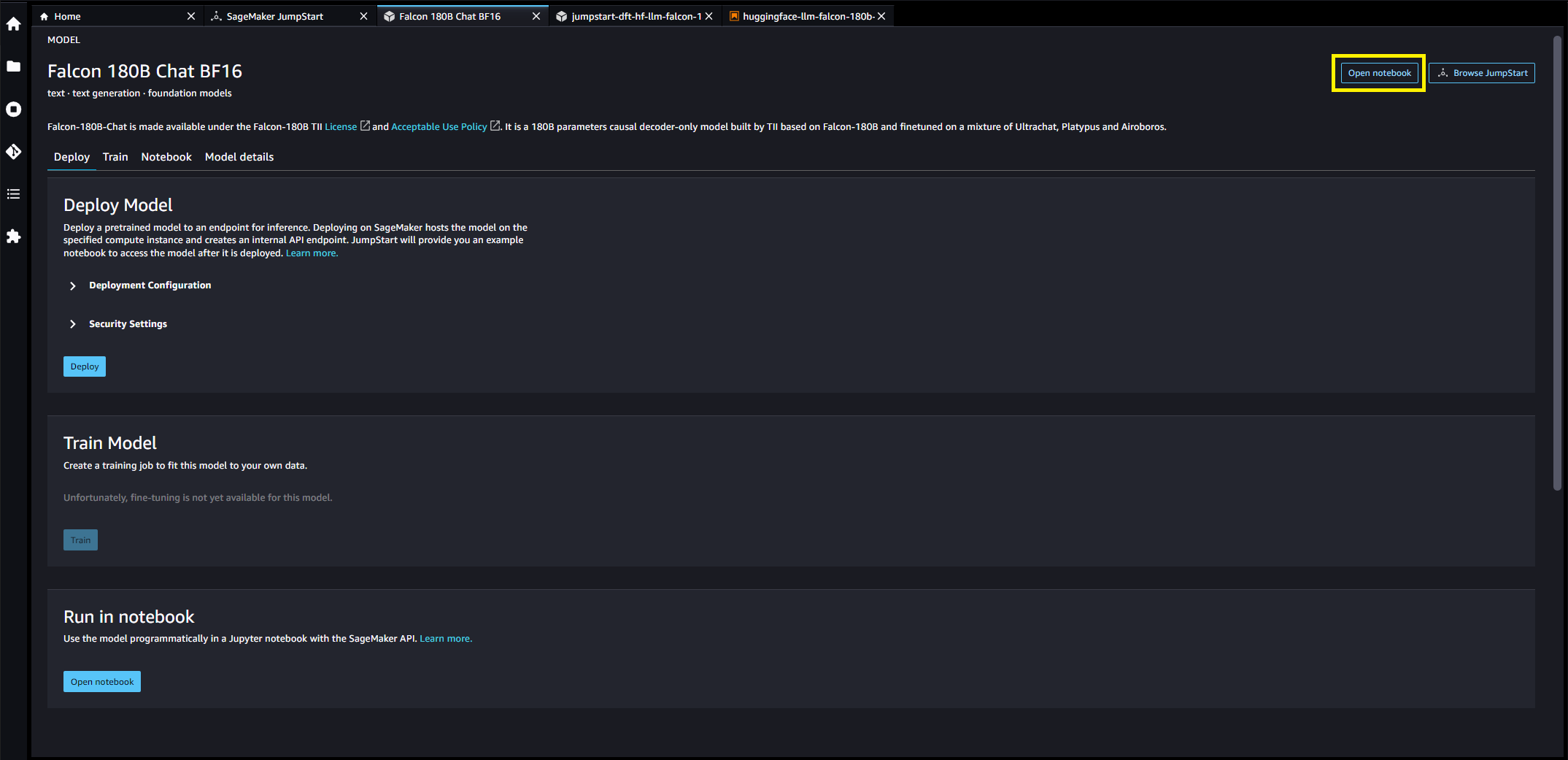

モデル カードを選択すると、ライセンス、トレーニングに使用されるデータ、使用方法などのモデルに関する詳細が表示されます。 ボタンも XNUMX つあります。 配備します および ノートブックを開くこれは、モデルの使用に役立ちます (次のスクリーンショットは、 配備します オプション)。

モデルを展開する

選ぶとき 配備します, モデルのデプロイが開始されます。 または、選択して表示されるサンプル ノートブックを通じてデプロイすることもできます。 ノートブックを開く。 サンプル ノートブックは、推論用のモデルをデプロイし、リソースをクリーンアップする方法に関するエンドツーエンドのガイダンスを提供します。

ノートブックを使用してデプロイするには、まず、 model_id。 次のコードを使用して、選択したモデルのいずれかを SageMaker にデプロイできます。

これにより、デフォルトのインスタンス タイプやデフォルトの VPC 構成などのデフォルト構成でモデルが SageMaker にデプロイされます。 これらの構成は、デフォルト以外の値を指定することで変更できます。 JumpStartModel。 詳細については、を参照してください。 APIドキュメント。 デプロイ後は、SageMaker プレディクターを通じて、デプロイされたエンドポイントに対して推論を実行できます。 次のコードを参照してください。

推論パラメータは、エンドポイントでのテキスト生成プロセスを制御します。 最大新しいトークンのコントロールは、モデルによって生成される出力のサイズを指します。 モデルの語彙は英語の語彙と同じではなく、各トークンは英語の単語ではない可能性があるため、これは単語の数と同じではないことに注意してください。 温度は出力のランダム性を制御します。 温度が高いほど、より創造的で幻覚的な出力が得られます。 すべての推論パラメータはオプションです。

この 180B パラメーター モデルは 335GB で、16 ビット精度で推論を十分に実行するにはさらに多くの GPU メモリが必要です。 現在、JumpStart は ml.p4de.24xlarge インスタンスでのみこのモデルをサポートしています。 以下を提供することで、8 ビット量子化モデルを ml.p4d.24xlarge インスタンスにデプロイできます。 env={"HF_MODEL_QUANTIZE": "bitsandbytes"} のキーワード引数 JumpStartModel コンストラクターと指定 instance_type="ml.p4d.24xlarge" デプロイメソッドに。 ただし、この量子化された構成では、トークンごとのレイテンシーが約 5 倍遅くなることに注意してください。

次の表は、SageMaker JumpStart で利用可能なすべての Falcon モデルと、モデル ID、デフォルトのインスタンス タイプ、サポートされている合計トークンの最大数 (入力トークンの数と生成されたトークンの数の合計)、およびトークンごとの一般的な応答レイテンシーをリストしています。これらのモデルごとに。

| モデル名 | モデルID | デフォルトのインスタンスタイプ | 最大合計トークン数 | トークンごとのレイテンシ* |

| ファルコン7B | huggingface-llm-falcon-7b-bf16 |

ml.g5.2xラージ | 2048 | 34ミリ秒 |

| ファルコン 7B の指示 | huggingface-llm-falcon-7b-instruct-bf16 |

ml.g5.2xラージ | 2048 | 34ミリ秒 |

| ファルコン40B | huggingface-llm-falcon-40b-bf16 |

ml.g5.12xラージ | 2048 | 57ミリ秒 |

| ファルコン 40B の指示 | huggingface-llm-falcon-40b-instruct-bf16 |

ml.g5.12xラージ | 2048 | 57ミリ秒 |

| ファルコン180B | huggingface-llm-falcon-180b-bf16 |

ml.p4de.24xlarge | 2048 | 45ミリ秒 |

| ファルコン 180B チャット | huggingface-llm-falcon-180b-chat-bf16 |

ml.p4de.24xlarge | 2048 | 45ミリ秒 |

*トークンごとの遅延は、このブログで提供されているサンプル プロンプトの応答時間の中央値として提供されます。 この値は、入力シーケンスと出力シーケンスの長さに基づいて変化します。

Falcon 180B の推論とプロンプト例

Falcon モデルは、あらゆるテキストのテキスト補完に使用できます。 テキスト生成を通じて、質問への回答、言語翻訳、感情分析など、さまざまなタスクを実行できます。 エンドポイントは、次の入力ペイロード スキーマを受け入れます。

これらの定義を調べることができます クライアントパラメータ およびテキスト生成推論リポジトリ内のデフォルト値。

以下は、プロンプトのサンプル例とモデルによって生成されたテキストです。 ここでのすべての出力は推論パラメータを使用して生成されます {"max_new_tokens": 768, "stop": ["<|endoftext|>", "###"]}.

Web サイトの構築は 10 の簡単なステップで行うことができます。

この事前トレーニング済みモデルは、ダイアログのユースケースには必ずしも理想的ではない長いテキスト シーケンスを生成することに気づくかもしれません。 微調整されたチャット モデルが大規模なダイアログ ベースのプロンプトに対してどのように実行されるかを示す前に、次の XNUMX つの例で、Falcon モデルを少数ショットのコンテキスト内学習で使用する方法を説明します。ここでは、モデルで使用できるトレーニング サンプルを提供します。 「少数ショット学習」ではモデルの重みが調整されないことに注意してください。ギルド モデルの出力を支援するために、入力コンテキスト内でいくつかの例を提供しながら、このプロセス中にデプロイされたモデルの推論のみを実行します。

Falcon 180B-Chat の推論とプロンプト例

対話のユースケース向けに最適化された Falcon 180B-Chat モデルでは、チャット モデルのエンドポイントへの入力にチャット アシスタントとユーザーの間の以前の履歴が含まれる場合があります。 これまでの会話に関連した質問をすることができます。 チャット アシスタントの動作を定義するペルソナなどのシステム構成を提供することもできます。 エンドポイントへの入力ペイロードは、次の点を除いて Falcon 180B モデルと同じです。 inputs 文字列値には次の形式を使用する必要があります。

以下は、プロンプトのサンプル例とモデルによって生成されたテキストです。 すべての出力は推論パラメーターを使用して生成されます {"max_new_tokens":256, "stop": ["nUser:", "<|endoftext|>", " User:", "###"]}.

次の例では、ユーザーはアシスタントとパリの観光地について会話しています。 次に、ユーザーはチャット アシスタントが推奨する最初のオプションについて問い合わせています。

クリーンアップ

ノートブックの実行が完了したら、請求が停止されるように、プロセス中に作成したすべてのリソースを必ず削除してください。 次のコードを使用します。

まとめ

この投稿では、SageMaker Studio で Falcon 180B の使用を開始し、推論用のモデルをデプロイする方法を説明しました。 基礎モデルは事前にトレーニングされているため、トレーニングとインフラストラクチャのコストを削減し、ユースケースに合わせたカスタマイズを可能にすることができます。 今すぐ SageMaker Studio の SageMaker JumpStart にアクセスして開始してください。

リソース

著者について

カイル・ウルリッヒ博士 Amazon SageMaker JumpStart チームの応用科学者です。 彼の研究対象には、スケーラブルな機械学習アルゴリズム、コンピューター ビジョン、時系列、ベイジアン ノンパラメトリック、ガウス プロセスなどがあります。 彼はデューク大学で博士号を取得しており、NeurIPS、Cell、および Neuron で論文を発表しています。

カイル・ウルリッヒ博士 Amazon SageMaker JumpStart チームの応用科学者です。 彼の研究対象には、スケーラブルな機械学習アルゴリズム、コンピューター ビジョン、時系列、ベイジアン ノンパラメトリック、ガウス プロセスなどがあります。 彼はデューク大学で博士号を取得しており、NeurIPS、Cell、および Neuron で論文を発表しています。

アシッシュ・ケタン博士 Amazon SageMaker JumpStart の上級応用科学者であり、機械学習アルゴリズムの開発を支援しています。 イリノイ大学アーバナ・シャンペーン校で博士号を取得しました。 彼は機械学習と統計的推論の積極的な研究者であり、NeurIPS、ICML、ICLR、JMLR、ACL、および EMNLP カンファレンスで多くの論文を発表しています。

アシッシュ・ケタン博士 Amazon SageMaker JumpStart の上級応用科学者であり、機械学習アルゴリズムの開発を支援しています。 イリノイ大学アーバナ・シャンペーン校で博士号を取得しました。 彼は機械学習と統計的推論の積極的な研究者であり、NeurIPS、ICML、ICLR、JMLR、ACL、および EMNLP カンファレンスで多くの論文を発表しています。

オリヴィエ・クルシャン彼は、フランスに拠点を置く AWS のプリンシパル機械学習スペシャリスト ソリューション アーキテクトです。 Olivier は、小規模なスタートアップから大企業まで、AWS の顧客が実稼働グレードの機械学習アプリケーションを開発およびデプロイできるよう支援します。 余暇には、研究論文を読んだり、友人や家族と一緒に大自然を探索したりすることを楽しんでいます。

オリヴィエ・クルシャン彼は、フランスに拠点を置く AWS のプリンシパル機械学習スペシャリスト ソリューション アーキテクトです。 Olivier は、小規模なスタートアップから大企業まで、AWS の顧客が実稼働グレードの機械学習アプリケーションを開発およびデプロイできるよう支援します。 余暇には、研究論文を読んだり、友人や家族と一緒に大自然を探索したりすることを楽しんでいます。

カール・アルバートセン Amazon SageMaker の基盤モデルハブ、アルゴリズム、パートナーシップチームを率いています。

カール・アルバートセン Amazon SageMaker の基盤モデルハブ、アルゴリズム、パートナーシップチームを率いています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 自動車/EV、 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- チャートプライム。 ChartPrime でトレーディング ゲームをレベルアップしましょう。 こちらからアクセスしてください。

- ブロックオフセット。 環境オフセット所有権の近代化。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/falcon-180b-foundation-model-from-tii-is-now-available-via-amazon-sagemaker-jumpstart/

- :持っている

- :は

- :not

- :どこ

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 150

- 20

- 25

- 視聴者の38%が

- 3d

- 4k

- 7

- 8

- 9

- a

- 私たちについて

- 受け入れる

- アクセス

- アクセス可能な

- 達成する

- アクティブ

- 加えます

- さらに

- 住所

- 後

- に対して

- アルゴリズム

- すべて

- ことができます

- 沿って

- また

- 常に

- am

- Amazon

- アマゾンセージメーカー

- Amazon SageMaker ジャンプスタート

- Amazon Webサービス

- an

- 分析

- および

- とインフラ

- アナウンス

- 別の

- 回答

- どれか

- 誰も

- 訴える

- 適用された

- 適切な

- 約

- 建築

- です

- 引数

- 宝品

- 記事

- AS

- 頼む

- アシスタント

- At

- 注意

- 引き付ける

- アトラクション

- 自動化

- 利用できます

- 通り

- AWS

- ベース

- バッテリー

- ベイジアン

- BE

- 美しい

- なぜなら

- き

- 行動

- より良いです

- の間に

- 請求

- ブログ

- 誇る

- ブラウザ

- ビルダー

- ビルダー

- 建物

- ビジネス

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- カフェ

- 缶

- 機能

- カード

- カルーセル

- 場合

- 例

- 変化する

- チェック

- 選択する

- 選択する

- 選ばれた

- 市町村

- 分類します

- クラスタ

- Cms

- コード

- コードベース

- コレクション

- コラム

- COM

- 組み合わせた

- コマンドと

- 会社

- コンプリート

- 完成

- コンピュータ

- Computer Vision

- 会議

- からなる

- 接触

- 含む

- コンテナ

- 含まれています

- コンテンツ

- コンテキスト

- 文脈上の

- 連続的に

- 貢献

- コントロール

- controls

- 会話

- 会話

- コスト

- 作ります

- 作成した

- 作成

- クリエイティブ

- カップ

- 電流プローブ

- 現在

- カスタム

- 顧客

- カスタマーサービス

- Customers

- カスタム化

- カスタマイズ

- データ

- データセキュリティ

- データセット

- 中

- 決定

- 専用の

- デフォルト

- 定義します

- 定義

- 実証します

- によっては

- 展開します

- 展開

- 展開する

- 展開

- 配備する

- 設計

- デスティネーション

- 細部

- 決定する

- 開発する

- 発展した

- 開発

- 対話

- 対話

- 異なります

- 発見する

- 配布

- 分散トレーニング

- do

- ありません

- ドメイン

- ドメイン名

- ドメイン名

- 行われ

- 夢

- デューク

- デューク大学

- 間に

- 各

- 緩和する

- 簡単に

- 東

- 簡単に

- enable

- 有効にする

- 端から端まで

- エンドポイント

- エネルギー

- エンジニアリング

- 英語

- 確保

- 企業

- 環境

- 特に

- さらに

- 例

- 例

- 除く

- 興奮した

- 専門知識

- 探る

- 探る

- 表現

- エクステンション

- 広範囲

- 家族

- 有名な

- 遠く

- 魅惑的な

- 特徴

- 少数の

- もう完成させ、ワークスペースに掲示しましたか?

- 名

- フロート

- フォロー中

- 次

- 形式でアーカイブしたプロジェクトを保存します.

- 前者

- Foundation

- 4

- FRAME

- フランス

- フランス語

- 友達

- から

- 機能します

- さらに

- ガーデン

- 宝石

- 生成する

- 生成された

- 生成

- 世代

- 取得する

- ガラス

- Go

- 目標

- 目標

- 行く

- 良い

- だ

- GPU

- GPU

- 素晴らしい

- 成長

- ガイダンス

- ギルド

- 持っていました

- が起こった

- 嫌い

- 持ってる

- 持って

- he

- ハート

- 助けます

- 役立つ

- 助け

- ことができます

- こちら

- 隠されました

- 秘宝

- ハイパフォーマンス

- より高い

- 彼の

- history

- ホーム

- host

- ホスティング

- 認定条件

- How To

- しかしながら

- HTML

- HTTPS

- ハブ

- i

- 象徴的な

- ID

- 理想

- イド

- if

- イリノイ州

- 画像

- 画像

- import

- 印象的

- in

- include

- 含めて

- 信じられない

- 情報

- インフラ関連事業

- 革新的手法

- 入力

- 機関

- 説明書

- 統合された

- 興味がある

- 利益

- インタフェース

- に

- 分離された

- IT

- ITS

- JPG

- 既知の

- カイル

- 着陸

- 言語

- 大

- 大企業

- 大規模

- より大きい

- 最大の

- レイテンシ

- 最新の

- 起動する

- 法制

- レイアウト

- リード

- LEARN

- 学習

- 長さ

- ライセンス

- 光

- 裏打ちされた

- LINK

- リンク

- リスト

- リスト

- ローディング

- 長い

- 下側

- ルクセンブルク

- 機械

- 機械学習

- 製

- make

- 作成

- 管理

- 管理する

- 多くの

- 驚異

- 質量

- 大規模な

- マックス

- 五月..

- 意味

- 手段

- メディア

- 中世の

- メモリ

- メッセージ

- 方法

- かもしれない

- 混合

- 混合

- ML

- MLOps

- モデル

- 他には?

- 最も

- モーション

- 博物館

- 音楽を聴く際のスピーカーとして

- my

- 名

- 名前付き

- 名

- ナビゲート

- ナビゲーション

- 必ずしも

- 必要

- 負

- net

- ネットワーク

- 普通

- 新作

- 次の

- 夜

- いいえ

- ノート

- 知らせ..

- 今

- 数

- オブザーバー

- of

- オファー

- 油

- オリーブ

- on

- かつて

- ONE

- の

- 公然と

- オペレーショナル

- 最適化

- オプション

- オプション

- or

- オレゴン

- その他

- でる

- 概説

- 出力

- が

- ページ

- ページ

- 宮殿

- 論文

- パラメーター

- パラメータ

- パリ

- パーク

- 特に

- パートナーシップ

- 支払い

- 支払方法

- のワークプ

- 以下のために

- 完璧

- 実行する

- パフォーマンス

- 実行する

- 博士号

- 電話

- 物理学

- ピース

- 計画

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- お願いします

- 正の

- 可能

- ポスト

- 投稿

- 精度

- Predictor

- 準備中

- 現在

- 前

- 主に

- 校長

- 問題

- プロセス

- ラボレーション

- プロダクト

- 推進する

- 正しく

- 提供します

- 提供

- プロバイダー

- は、大阪で

- 提供

- 公表

- 目的

- 置きます

- Python

- 質問

- すぐに

- ランダム

- Raw

- リーディング

- レシピ

- 推奨される

- 参照する

- 指し

- 関係なく

- 地域

- 登録

- 登録

- レジストラ

- 参加申し込み

- 相対

- 相対性理論

- リリース

- リリース

- 関連した

- 信頼性

- 信頼性のある

- 覚えています

- 倉庫

- 表し

- 必要

- 必要条件

- 研究

- 研究者

- リソース

- 応答

- 結果

- 富裕層

- Ride

- 印税

- ラン

- ランニング

- s

- セージメーカー

- 塩

- 同じ

- スケーラビリティ

- ド電源のデ

- 規模

- 科学者

- SDDK

- SEA

- を検索

- 検索

- シーズン

- 二番

- セクション

- 安全に

- セキュリティ

- シード

- 選択

- 選択

- シニア

- 感情

- シリーズ

- サービス

- サービス

- セッションに

- 設定

- いくつかの

- シェアする

- ショップ

- ショート

- すべき

- 表示する

- 示されました

- 作品

- 符号

- 簡単な拡張で

- 単純

- 単に

- サイト

- サイズ

- ゆっくり

- 小さい

- So

- これまでのところ

- 社会

- ソーシャルメディア

- ソーシャルメディアの投稿

- ソリューション

- 一部

- 何か

- ソース

- スペース

- 専門家

- 指定の

- スピード

- start

- 開始

- スタートアップ

- 米国

- 駅

- 統計的

- ステップ

- Force Stop

- 停止

- ストレージ利用料

- 店舗

- ストリート

- 文字列

- 研究

- 見事な

- そのような

- サポート

- サポート

- サポート

- 確か

- シンボル

- テーブル

- 取る

- 取得

- タスク

- キー

- チーム

- チーム

- テクノロジー

- 技術革新

- template

- test

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- それ

- 世界

- アプリ環境に合わせて

- それら

- テーマ

- その後

- 理論

- そこ。

- ボーマン

- 彼ら

- 三番

- この

- 介して

- 時間

- 時系列

- 〜へ

- 一緒に

- トークン

- トークン

- ツール

- 豊富なツール群

- トータル

- タワー

- トレーニング

- 訓練された

- トレーニング

- トランス

- 翻訳する

- インタビュー

- 1兆

- 旅行

- トリトン

- 試します

- ツイート

- 2

- type

- 典型的な

- ui

- 下

- 統一

- ユニーク

- 大学

- まで

- アップロード

- us

- つかいます

- 使用事例

- 中古

- ユーザー

- users

- 使用されます

- 値

- 価値観

- 多様

- さまざまな

- バージョン

- バージョン

- 、

- バイブ

- ビデオ

- 動画

- 詳しく見る

- ビュー

- バージニア州

- ビジョン

- 訪問

- 訪問者

- 視覚的に

- 歩く

- 欲しいです

- ました

- 透かし

- we

- ウェブ

- Webサービス

- ウェブベースの

- ウェブサイト

- 週間

- ウィークス

- WELL

- ウェスト

- この試験は

- 何ですか

- いつ

- which

- while

- 意志

- ウィンドウズ

- 以内

- 無し

- Word

- 言葉

- 世界

- 書き込み

- はい

- You

- あなたの

- ゼファーネット

- ゼロ