最新のチャットボットはデジタル エージェントとして機能し、多くの業界にわたって年中無休の顧客サービスとサポートを提供するための新しい手段を提供します。その人気の理由は、顧客からの問い合わせにリアルタイムで応答し、複数の問い合わせを異なる言語で同時に処理できることです。チャットボットは、ユーザーベースの成長に合わせて簡単に拡張しながら、顧客の行動に関する貴重なデータ主導の洞察も提供します。したがって、顧客を魅了するための費用対効果の高いソリューションを提供します。チャットボットは、大規模言語モデル (LLM) の高度な自然言語機能を使用して、顧客の質問に応答します。彼らは会話言語を理解し、自然に反応することができます。ただし、基本的な質問に答えるだけのチャットボットの有用性は限られています。信頼できるアドバイザーになるために、チャットボットは思慮深く、カスタマイズされた応答を提供する必要があります。

より状況に応じた会話を可能にする 1 つの方法は、チャットボットを社内のナレッジ ベースや情報システムにリンクすることです。社内のナレッジ ベースから独自の企業データを統合することで、チャットボットが各ユーザーの個別のニーズや興味に応じた応答をコンテキスト化できるようになります。たとえば、チャットボットは、買い物客の好みや過去の購入内容に一致する商品を提案したり、ユーザーの専門知識レベルに合わせた言語で詳細を説明したり、顧客の特定の記録にアクセスしてアカウント サポートを提供したりできます。情報をインテリジェントに組み込み、自然言語を理解し、会話フローでカスタマイズされた応答を提供する機能により、チャットボットはさまざまなユースケースにわたって真のビジネス価値を提供できます。

人気のあるアーキテクチャ パターン 検索拡張生成 (RAG) は、ユーザーのクエリ コンテキストと応答を強化するためによく使用されます。 RAG は、LLM の機能と、データのコーパスから関連するテキストや文章を取得することから得られる事実や現実世界の知識に基づく機能を組み合わせます。これらの取得されたテキストは、出力を通知および根拠付けるために使用され、幻覚を軽減し、関連性を向上させます。

この投稿では、次を使用してチャットボットをコンテキストに応じて強化する方法を説明します。 Amazon Bedrock のナレッジベース、フルマネージドのサーバーレス サービス。 Amazon Bedrock のナレッジベースの統合により、チャットボットはユーザーのクエリを関連情報のデータポイントにリンクすることで、より関連性の高いパーソナライズされた応答を提供できるようになります。内部的に、 アマゾンの岩盤 ベクトル データベースに保存された埋め込みを使用して、実行時にユーザー クエリ コンテキストを強化し、マネージド RAG アーキテクチャ ソリューションを有効にします。私たちが使用するのは、 株主へのアマゾンの手紙 このソリューションを開発するためのデータセット。

検索拡張生成

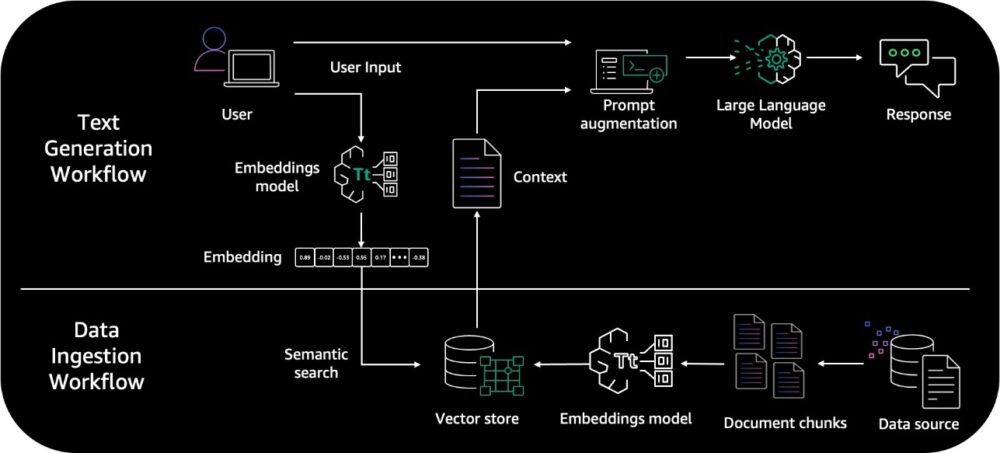

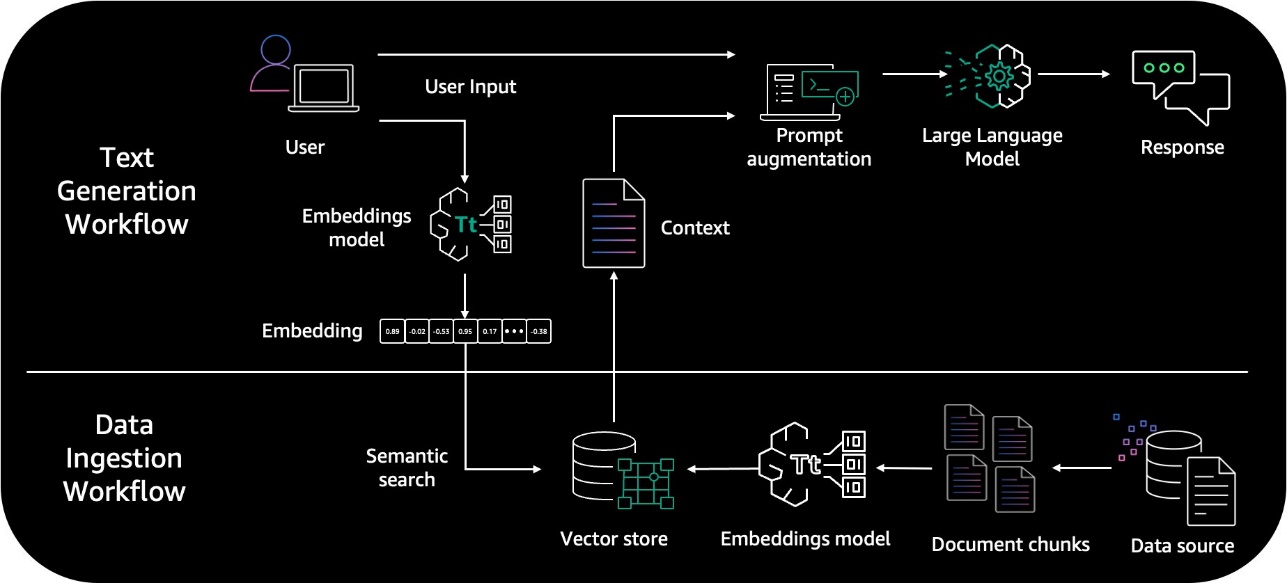

RAG は、生成プロセスに情報検索を組み込んだ自然言語生成へのアプローチです。 RAG アーキテクチャには、取り込みによるデータの前処理と、拡張コンテキストを使用したテキスト生成という 2 つの主要なワークフローが含まれます。

データ取り込みワークフローは、LLM を使用して、テキストの意味論的な意味を表す埋め込みベクトルを作成します。埋め込みはドキュメントとユーザーの質問に対して作成されます。ドキュメントの埋め込みはチャンクに分割され、ベクトル データベースにインデックスとして保存されます。次に、テキスト生成ワークフローは質問の埋め込みベクトルを取得し、それを使用してベクトルの類似性に基づいて最も類似したドキュメント チャンクを取得します。これらの関連チャンクでプロンプトを拡張し、LLM を使用して回答を生成します。詳細については、を参照してください。 検索拡張生成、埋め込み、およびベクトル データベースに関する入門書 のセクション プレビュー – Agent for Amazon Bedrock を使用して基盤モデルを会社のデータ ソースに接続する.

次の図は、高レベルの RAG アーキテクチャを示しています。

RAG アーキテクチャには多くの利点がありますが、データベース、取得メカニズム、プロンプト、生成モデルなどの複数のコンポーネントが必要です。これらの相互依存する部分を管理すると、システムの開発と展開が複雑になる可能性があります。検索と生成を統合するには、追加のエンジニアリング作業と計算リソースも必要になります。一部のオープン ソース ライブラリには、このオーバーヘッドを軽減するためのラッパーが提供されています。ただし、ライブラリを変更するとエラーが発生し、バージョン管理のオーバーヘッドが追加される可能性があります。オープンソース ライブラリを使用する場合でも、コードの作成、最適なチャンク サイズの決定、埋め込みの生成などには多大な労力が必要です。データ量によっては、このセットアップ作業だけでも数週間かかる場合があります。

したがって、これらの未分化タスクを処理するマネージド ソリューションは、RAG アプリケーションの実装と管理のプロセスを合理化し、加速することができます。

Amazon Bedrock のナレッジベース

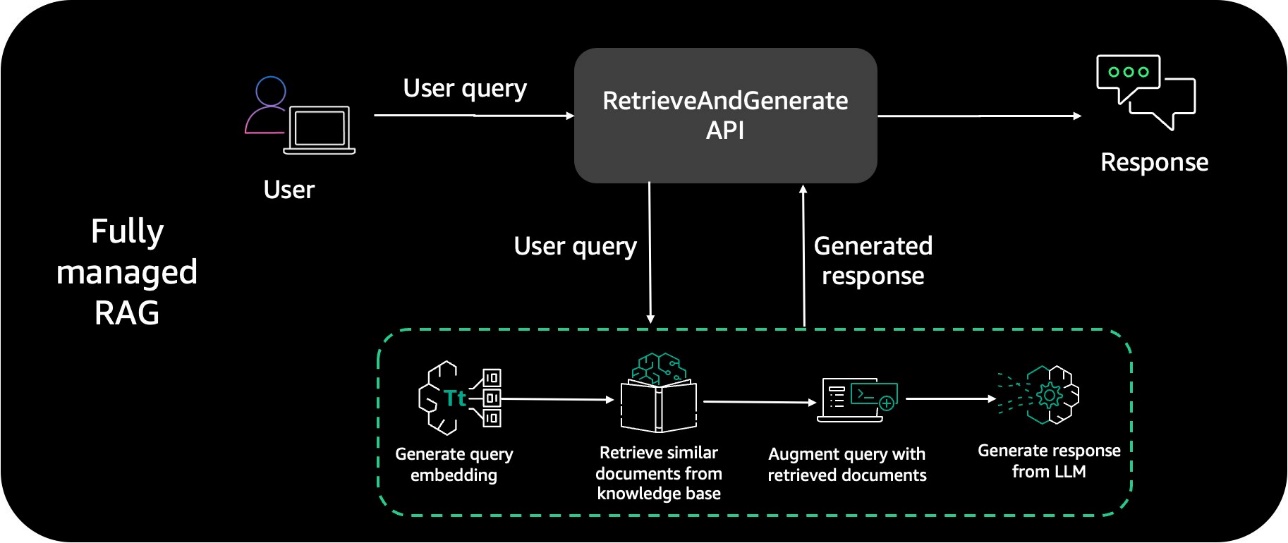

Knowledge Bases for Amazon Bedrock は、RAG を使用して強力な会話型 AI システムを構築するためのサーバーレス オプションです。フルマネージドのデータ取り込みとテキスト生成のワークフローを提供します。

データの取り込みでは、ベクトル データベース内のドキュメント データのテキスト埋め込みの作成、保存、管理、更新を自動的に処理します。効率的に検索できるよう、ドキュメントを管理しやすいチャンクに分割します。その後、チャンクは埋め込みに変換され、ベクトル インデックスに書き込まれますが、質問に答えるときにソース ドキュメントを確認できるようになります。

テキスト生成のために、Amazon Bedrock は 取得して生成する ユーザー クエリの埋め込みを作成し、ベクター データベースから関連するチャンクを取得して正確な応答を生成する API。また、RAG アプリケーションに必要なソースの帰属と短期メモリもサポートします。

これにより、中核となるビジネス アプリケーションに集中できるようになり、差別化されていない重労働が軽減されます。

ソリューションの概要

この投稿で紹介されているソリューションでは、 ストリームライト アプリケーションには次の AWS サービスが含まれます。

次の図は、チャットボット アプリケーションを Amazon Bedrock のナレッジベースに統合するために使用できる一般的なソリューション アーキテクチャ パターンです。

このアーキテクチャには次の手順が含まれます。

- ユーザーは Streamlit チャットボット インターフェイスを操作し、自然言語でクエリを送信します

- これにより Lambda 関数がトリガーされ、ナレッジベースが呼び出されます。

RetrieveAndGenerateAPI。内部的には、ナレッジベースは アマゾンタイタン モデルを埋め込み、ユーザー クエリをベクトルに変換し、ユーザー クエリと意味的に類似したチャンクを見つけます。ユーザー プロンプトは、ナレッジ ベースから取得したチャンクで拡張されます。その後、追加のコンテキストとともにプロンプトが応答生成のために LLM に送信されます。このソリューションでは、 人間のクロード・インスタント LLM として追加のコンテキストを使用してユーザー応答を生成します。このソリューションは、Amazon Bedrock の Anthropic Claude が存在するリージョンでサポートされていることに注意してください。 利用できます. - コンテキストに関連した応答がチャットボット アプリケーションとユーザーに返されます。

前提条件

Amazon Bedrock ユーザーは、基礎モデルを使用できるようにする前に、基礎モデルへのアクセスをリクエストする必要があります。これは 1 回限りのアクションであり、1.2 分もかかりません。このソリューションでは、Amazon Bedrock の Titan Embeddings GXNUMX – Text および Claude Instant – vXNUMX モデルへのアクセスを有効にする必要があります。詳細については、以下を参照してください。 モデルアクセス.

GitHubリポジトリのクローンを作成します

この投稿で紹介したソリューションは次の場所から入手できます。 GitHubレポ。 GitHub リポジトリのクローンをローカル マシンに作成する必要があります。ターミナル ウィンドウを開き、次のコマンドを実行します。これは 1 つの git clone コマンドであることに注意してください。

ナレッジデータセットを Amazon S3 にアップロードする

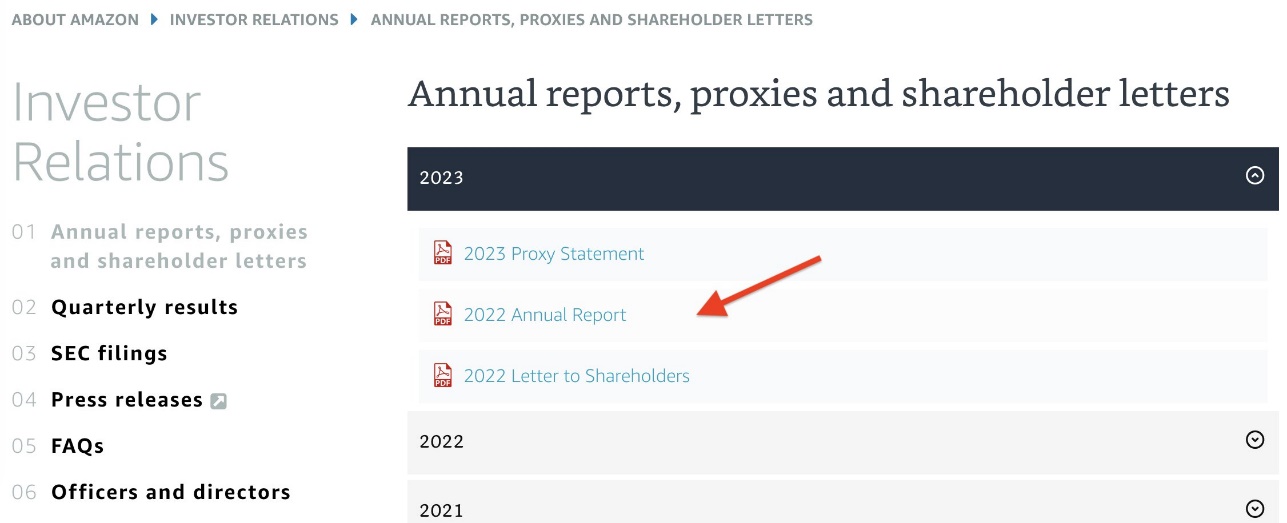

ナレッジベースのデータセットをダウンロードし、S3 バケットにアップロードします。このデータセットはナレッジ ベースに情報を提供し、強化します。次の手順を実行します。

- に移動します 年次報告書、委任状、株主への手紙 データリポジトリを作成し、過去数年間の Amazon 株主レターをダウンロードします。

- Amazon S3コンソールで、 バケット ナビゲーションペインに表示されます。

- 選択する バケットを作成する.

- バケットに名前を付けます

knowledgebase-<your-awsaccount-number>. - 他のバケット設定はすべてデフォルトのままにして、 創造する.

- に移動します

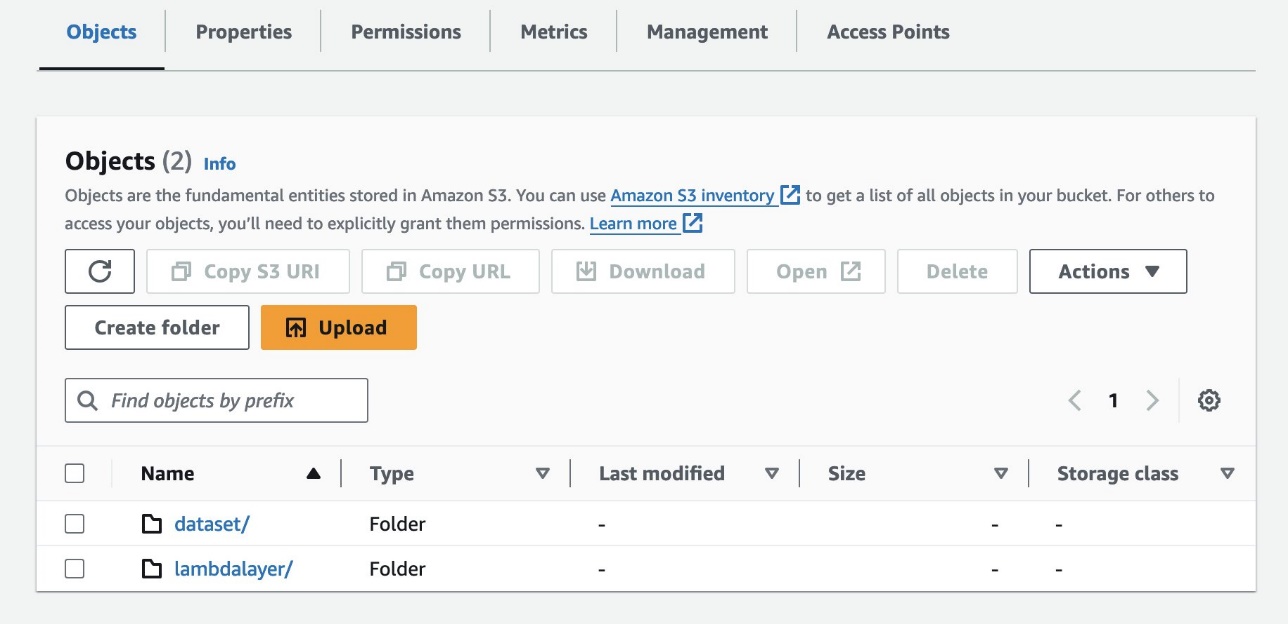

knowledgebase-<your-awsaccount-number>バケツ。 - 選択する フォルダを作成する データセットという名前を付けます。

- 他のフォルダー設定はすべてデフォルトのままにして、 創造する.

- バケットのホームに戻り、選択します フォルダを作成する 新しいフォルダーを作成して名前を付けるには

lambdalayer. - 他のすべての設定をデフォルトのままにして、 創造する.

- に移動します

datasetフォルダにコピーします。 - 前にダウンロードした年次報告書、委任状、株主レターのデータセット ファイルをこのバケットにアップロードし、選択します アップロード.

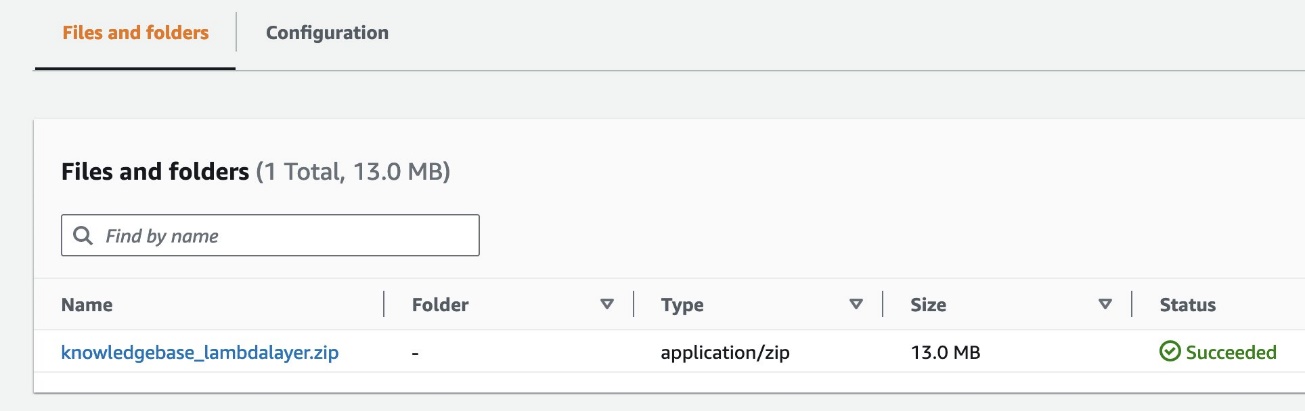

- に移動します

lambdalayerフォルダにコピーします。 - アップロード

knowledgebase-lambdalayer.zipファイルは以下で利用可能です/lambda/layer先ほど複製した GitHub リポジトリ内のフォルダーを選択し、 アップロード。後でこの Lambda レイヤーコードを使用して Lambda 関数を作成します。

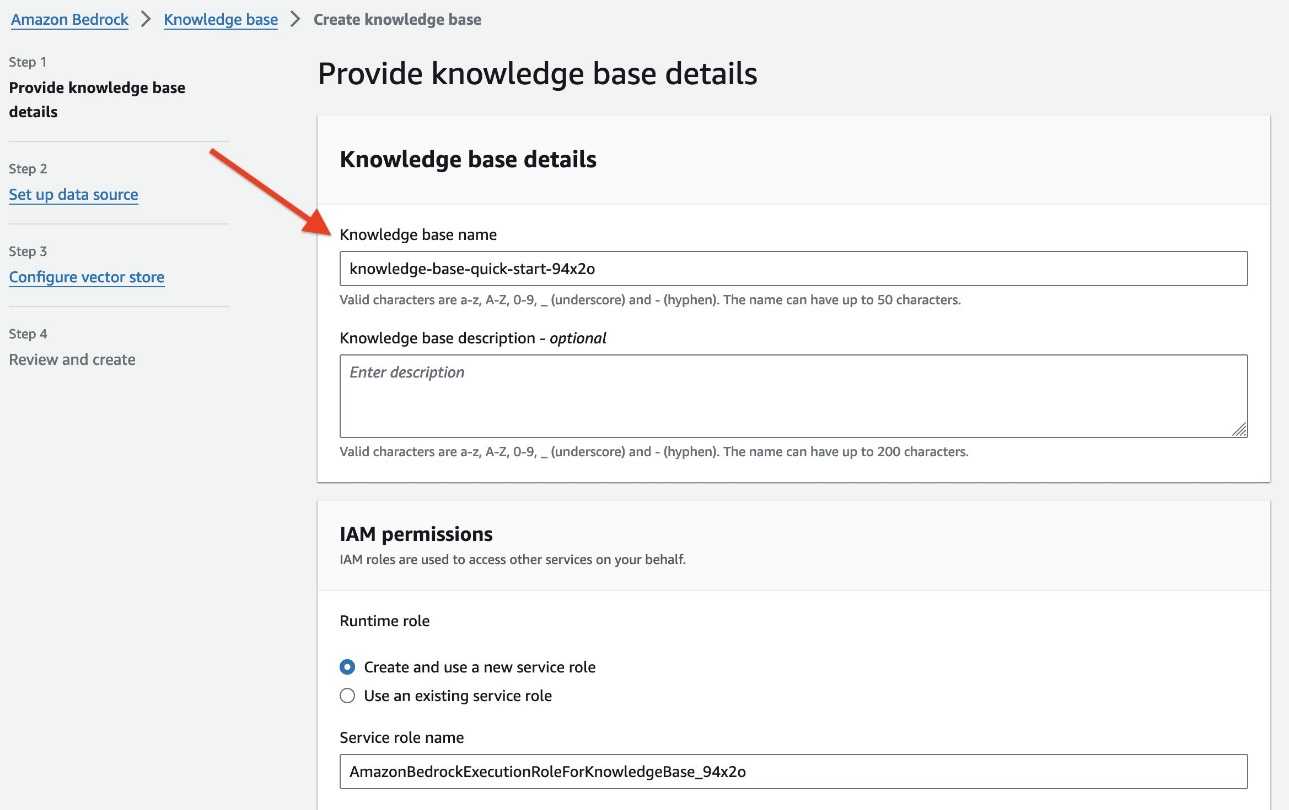

知識ベースを作成する

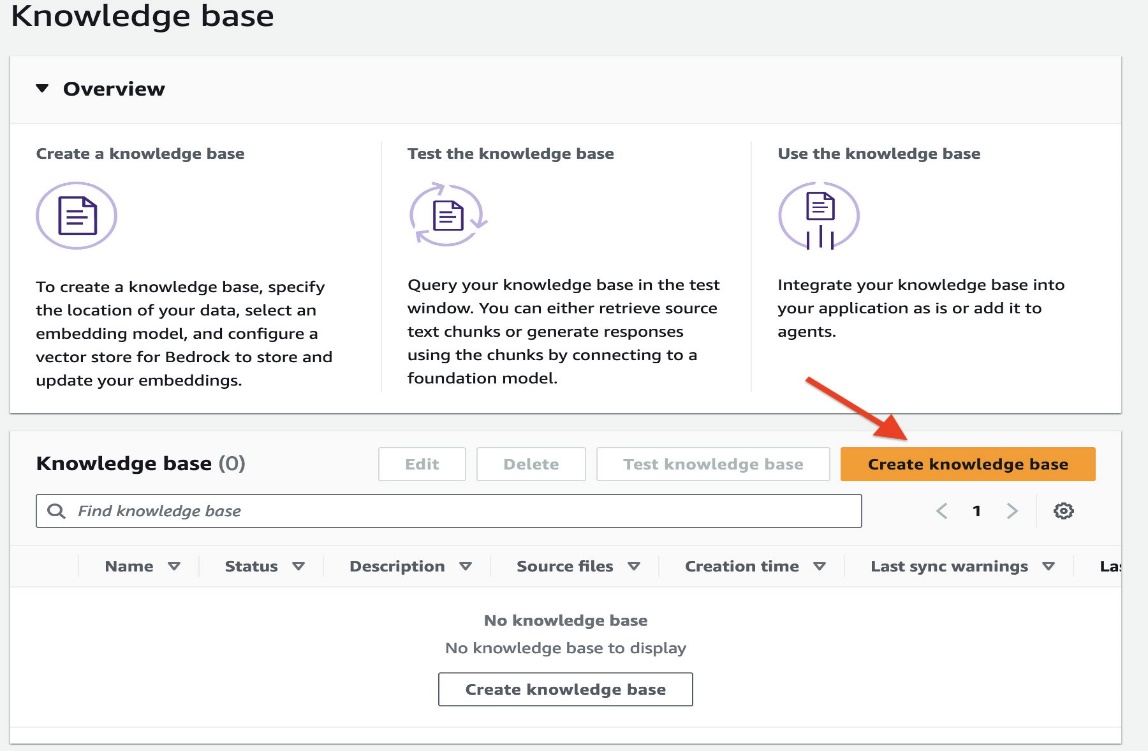

このステップでは、前のステップで S3 バケットにアップロードした Amazon 株主レター データセットを使用してナレッジ ベースを作成します。

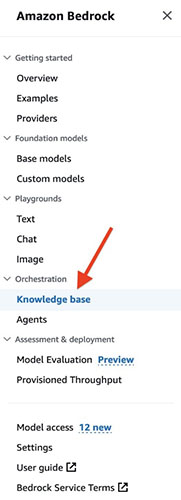

- Amazon Bedrock コンソールの次の場所にあります。 編成 ナビゲーション ペインで、 知識ベース.

- 選択する 知識ベースを作成する.

- ナレッジベースの詳細 セクションで、名前とオプションの説明を入力します。

- IAM権限 セクション、選択 新しいサービスロールを作成して使用する ロールの名前を入力します。

- 必要に応じてタグを追加します。

- 選択する Next.

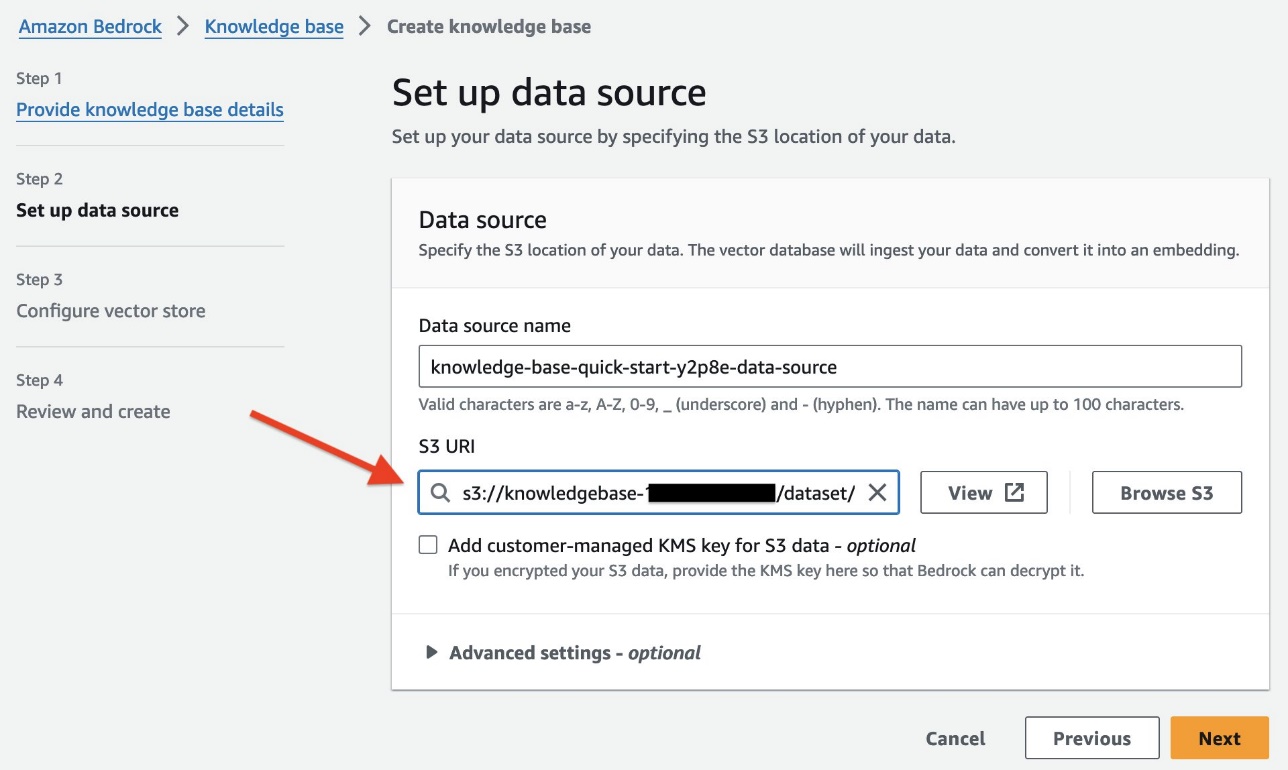

- コメントを残す データソース名 デフォルト名として。

- S3 URI、選択する S3を参照 S3 バケットを選択するには

knowledgebase-<your-account-number>/dataset/前の手順で作成したバケットとデータセット フォルダーを指定する必要があります。 - 詳細設定 セクションでは、デフォルト値のままにします (必要に応じて、デフォルトのチャンク化戦略を変更し、チャンク サイズとオーバーレイをパーセンテージで指定できます)。

- 選択する Next.

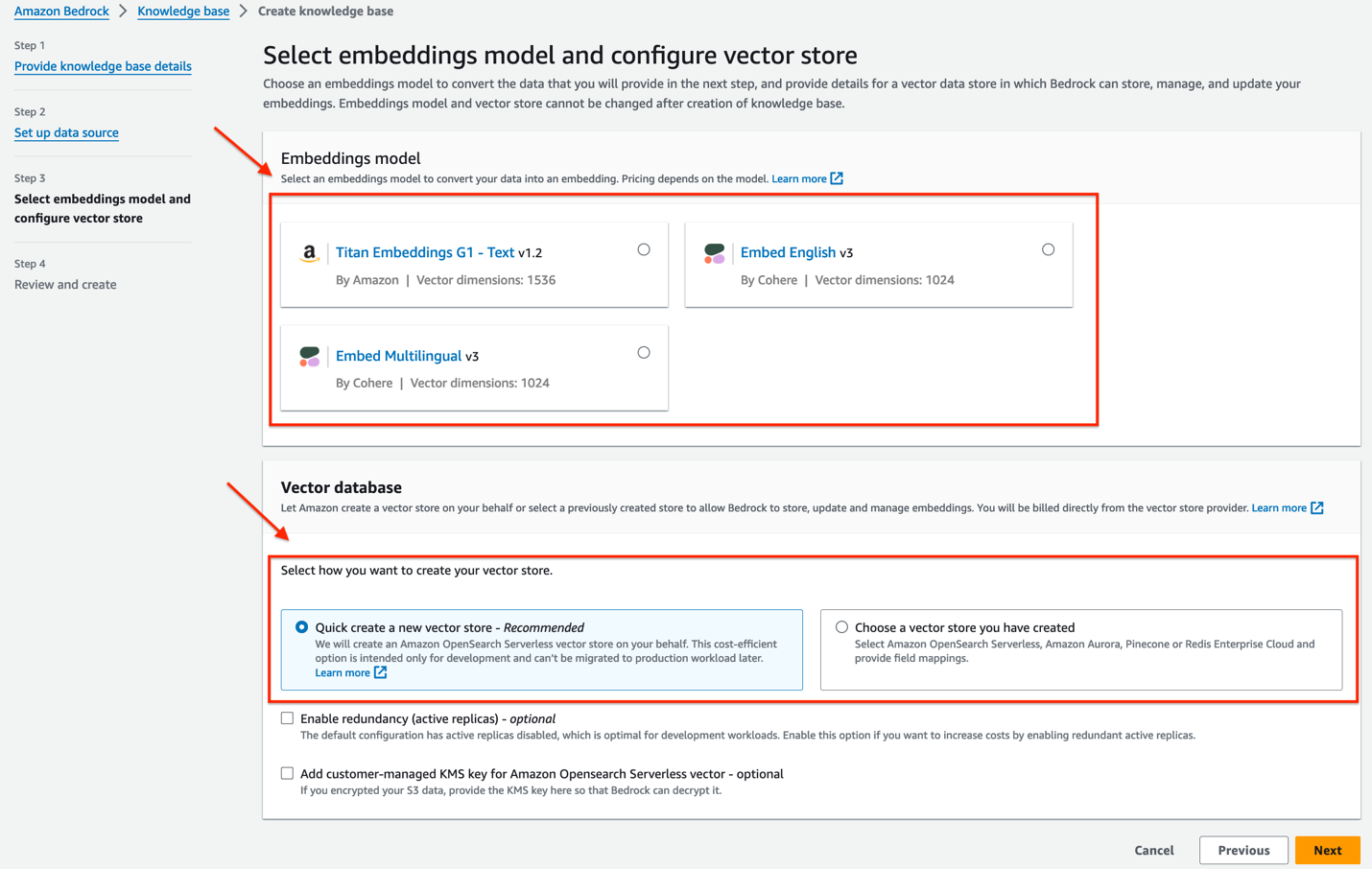

- 埋め込みモデル選択 Titan 埋め込み G1 – テキスト.

- ベクトルデータベース、どちらかを選択できます 新しいベクター ストアを簡単に作成する or 作成したベクター ストアを選択します。選択したベクター ストアを使用するには、使用するようにベクター ストアを事前に構成しておく必要があることに注意してください。現在、Amazon OpenSearch Serverless、Amazon Aurora、Pinecone、Redis Enterprise Cloud 用のベクトル エンジンの 4 つのベクトル エンジン タイプをサポートしています。この投稿では、[新しいベクター ストアのクイック作成] を選択します。これにより、デフォルトでアカウントに新しい OpenSearch サーバーレス ベクター ストアが作成されます。

- 選択する Next.

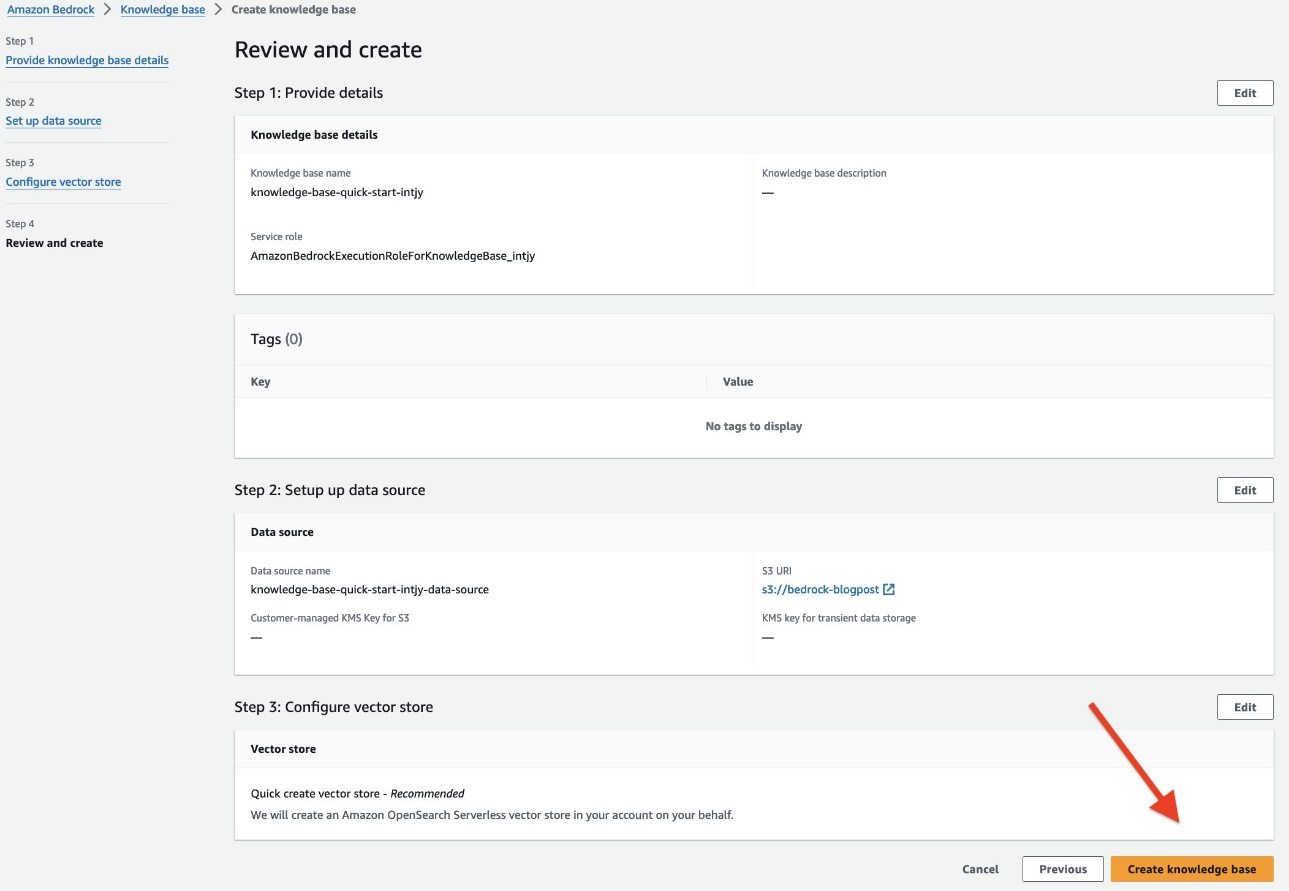

- ソフトウェア設定ページで、下図のように 確認して作成する ページに移動して、すべての情報を確認するか、選択します 前へ をクリックしてオプションを変更します。

- 選択する 知識ベースを作成する.

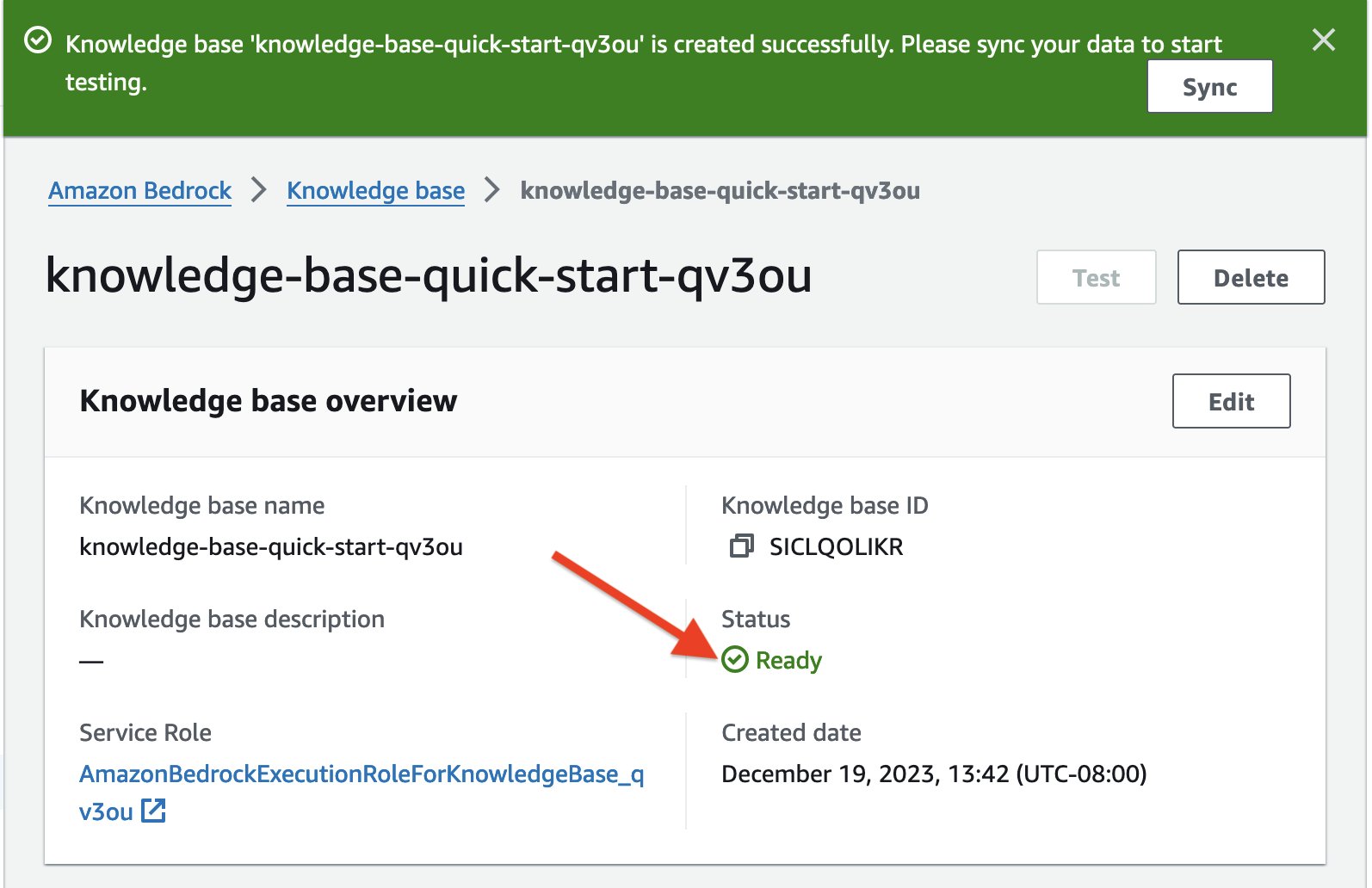

ナレッジ ベースの作成プロセスが開始され、ステータスが [進行中] になることに注意してください。ベクター ストアとナレッジ ベースの作成には数分かかります。ページから移動しないでください。移動しないと、作成が失敗します。

ナレッジ ベースの作成プロセスが開始され、ステータスが [進行中] になることに注意してください。ベクター ストアとナレッジ ベースの作成には数分かかります。ページから移動しないでください。移動しないと、作成が失敗します。 - ナレッジベースのステータスが

Ready状態にある場合は、ナレッジ ベース ID をメモします。次のステップでこれを使用して、Lambda 関数を設定します。

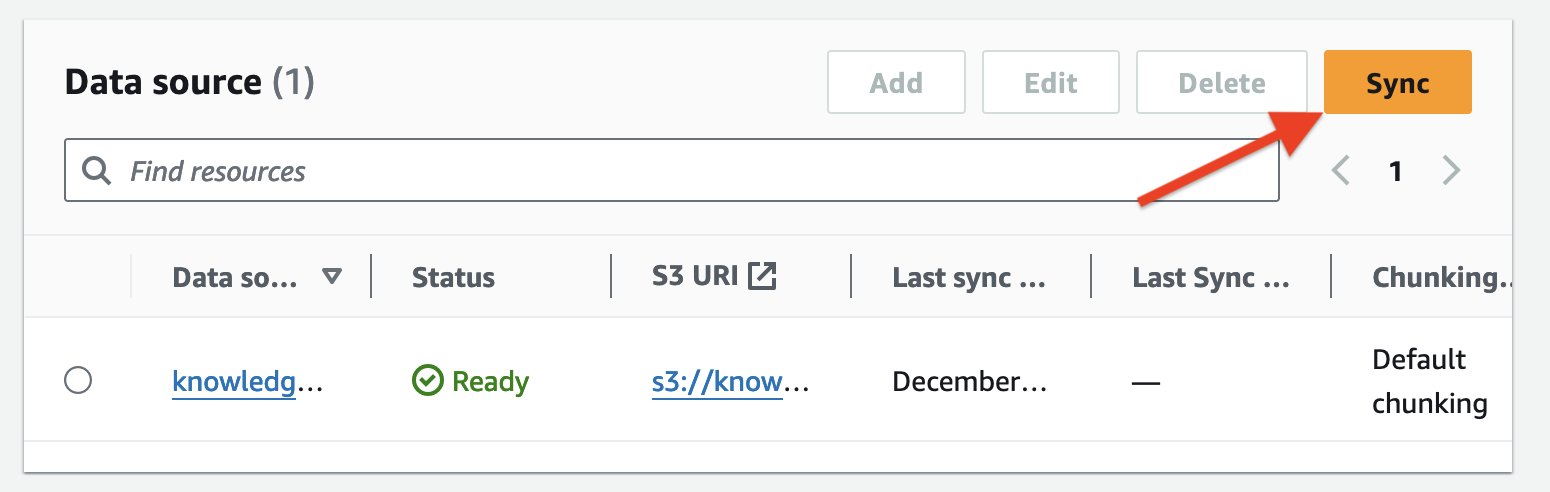

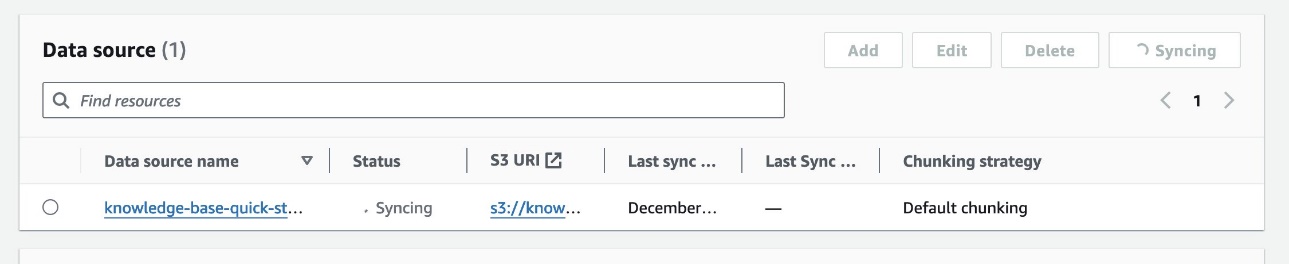

- ナレッジベースの準備ができたので、Amazon 株主レターデータをナレッジベースに同期する必要があります。の中に 情報元 ナレッジ ベースの詳細ページのセクションで、選択します 同期 S3 バケットからナレッジベースへのデータ取り込みプロセスをトリガーします。

この同期プロセスは、ドキュメントファイルを前に指定したチャンクサイズの小さなチャンクに分割し、選択したテキスト埋め込みモデルを使用してベクトル埋め込みを生成し、Amazon Bedrock のナレッジベースによって管理されるベクトルストアに保存します。

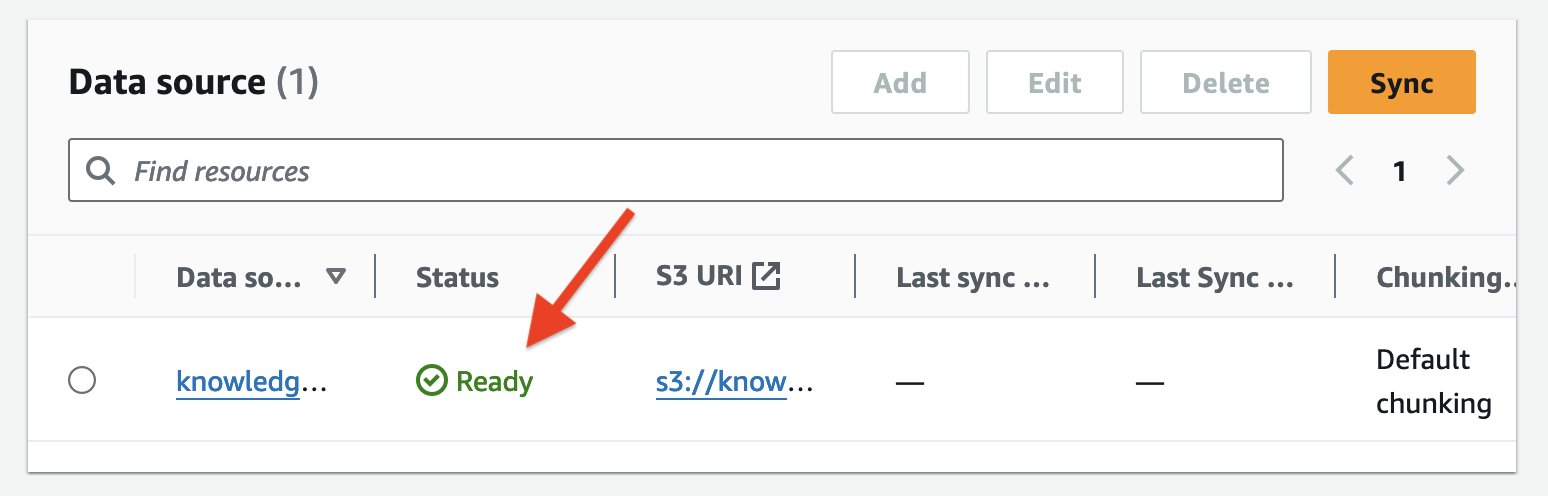

データセットの同期が完了すると、データ ソースのステータスは次のように変わります。 Ready 州。 S3 データ フォルダーにドキュメントを追加する場合は、ナレッジ ベースを再同期する必要があることに注意してください。

おめでとうございます。ナレッジベースの準備が整いました。

Amazon Bedrock サービス API のナレッジベースを使用することもできることに注意してください。 AWSコマンドラインインターフェイス (AWS CLI) を使用してプログラムでナレッジベースを作成します。以下で提供される Jupyter ノートブックのさまざまなセクションを実行する必要があります。 /notebook GitHub リポジトリ内のフォルダー。

Lambda関数を作成する

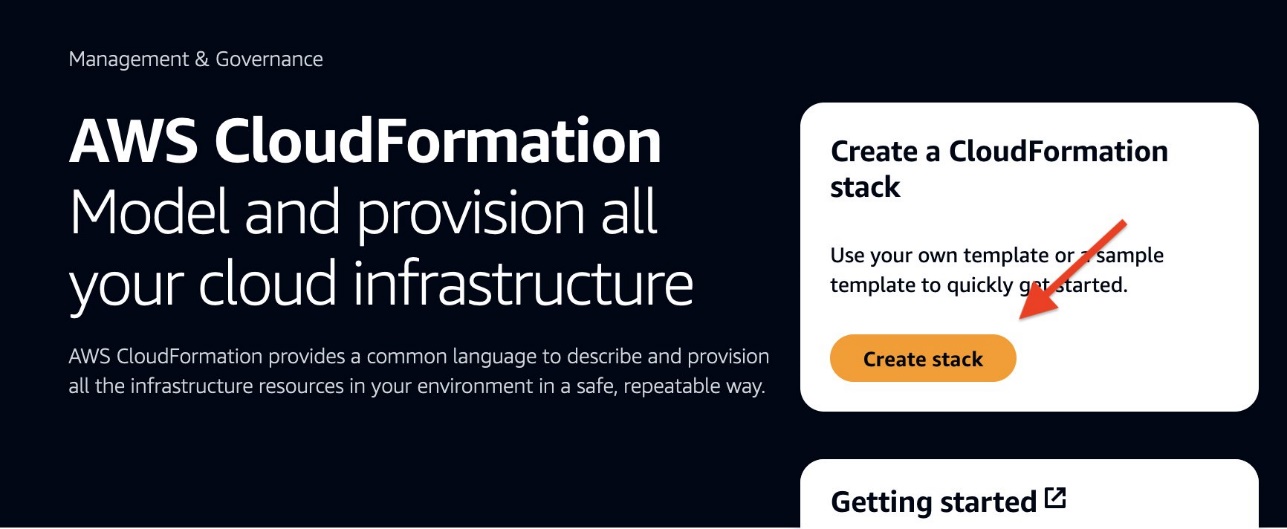

この Lambda 関数は、 AWS CloudFormation テンプレートは GitHub リポジトリで入手できます。 /cfn フォルダ。テンプレートには、S3 バケット名とナレッジ ベース ID の XNUMX つのパラメータが必要です。

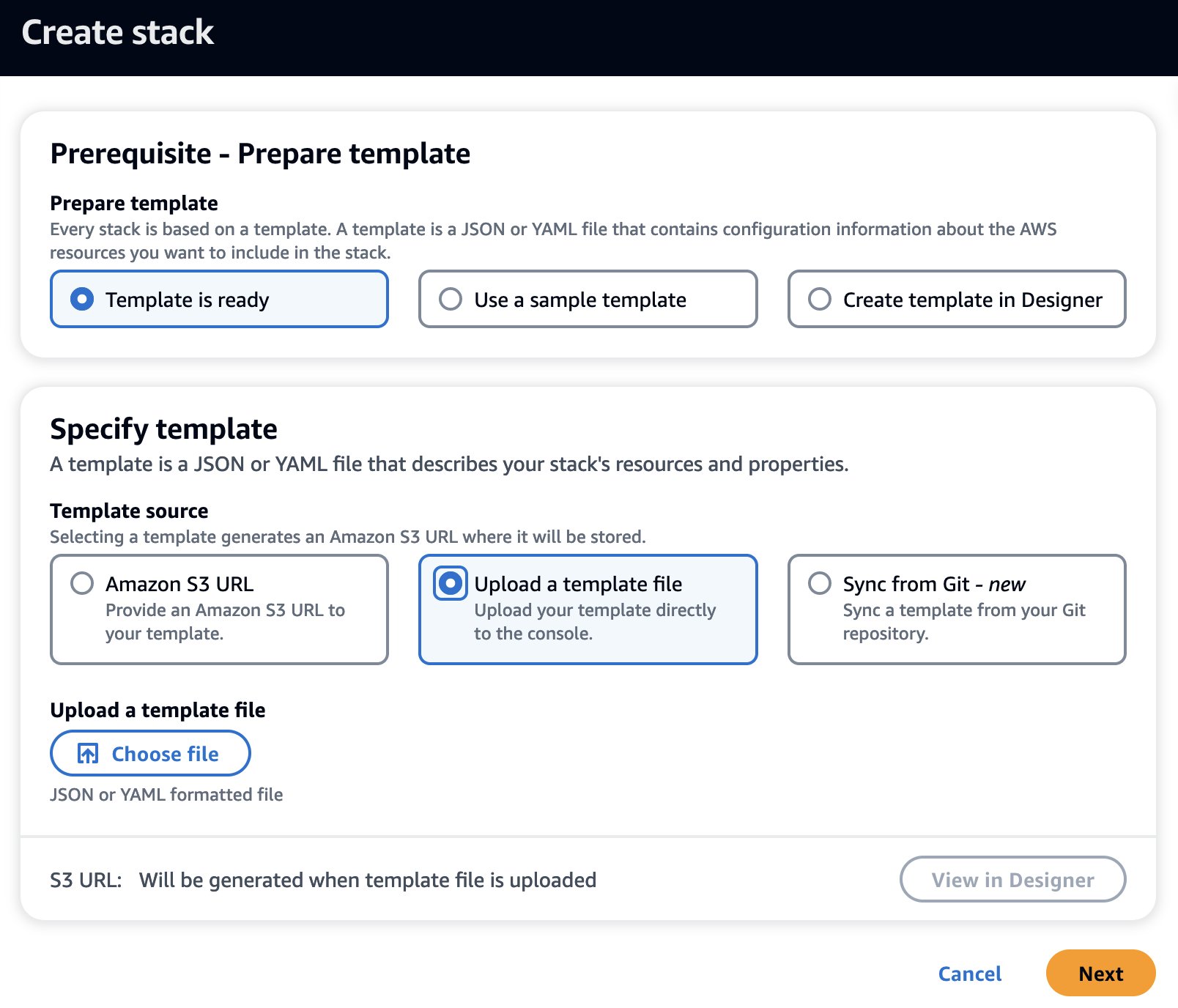

- AWS CloudFormation サービスのホームページで、 スタックを作成 新しいスタックを作成します。

- 選択 テンプレートの準備ができました for テンプレートを準備する.

- 選択 テンプレートファイルをアップロードする for テンプレートソース.

- 選択する ファイルを選ぶ、前に複製した GitHub リポジトリに移動し、.yaml ファイルを選択します。

/cfnフォルダにコピーします。 - 選択する Next.

- スタック名、名前を入力します。

- 計測パラメータ セクションで、前に書き留めたナレッジ ベース ID と S3 バケット名を入力します。

- 選択する Next.

- すべてのデフォルトのオプションをそのままにし、選択します Next、選択して 送信.

- CloudFormation テンプレートが正常に実行され、エラーがないことを確認します。

おめでとうございます。Lambda 関数、関連するロール、ポリシーが正常に作成されました。

コンテキストチャットボットアプリケーションをテストする

チャットボット アプリケーションをテストするには、次の手順を実行します。

- マシン上で新しいターミナルまたはコマンド ライン ウィンドウを開きます。

- 次のコマンドを実行して、 AWS SDK for Python(Boto3)。 Boto3 を使用すると、Python アプリケーション、ライブラリ、またはスクリプトを AWS のサービスと簡単に統合できます。

- 次のコマンドを実行して、ローカル Python 開発環境をインストールしてセットアップし、Streamlit アプリケーションを実行します。

- に移動します

/streamlit先ほど複製した GitHub リポジトリ フォルダー内のフォルダー。 - 次のコマンドを実行して、チャットボット アプリケーションをインスタンス化します。

これにより、デフォルトの Web ブラウザで Streamlit を利用した Web ベースのチャット アプリケーションが開きます。

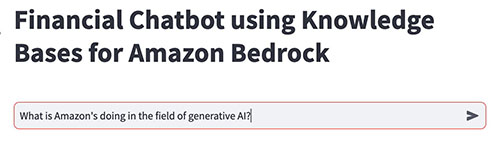

- この Streamlit チャットボット アプリケーションを使用して自然言語の質問を投稿し、Amazon Bedrock のナレッジベースを活用した会話を開始します。

プロンプトを送信すると、Streamlit アプリが Lambda 関数をトリガーし、ナレッジベースを呼び出します。 RetrieveAndGenerate 応答を検索して生成するための API。

次の表には、いくつかの質問例と関連するナレッジ ベースの回答が含まれています。プロンプトを使用して、これらの質問のいくつかを試してください。

| 質問 | 答え |

| Amazon は生成 AI の分野で何を行っていますか? | Amazon は生成 AI のための独自の大規模言語モデル (LLM) に取り組んでおり、それがあらゆる顧客エクスペリエンスを変革し、向上させると信じています。彼らは、消費者、販売者、ブランド、クリエイターのすべてのエクスペリエンスにわたって、これらのモデルに多額の投資を継続する予定です。 |

| 2022 年の AWS の前年比収益はいくらですか? | AWS の収益は、29 年に 2022 億ドルの収益ベースで前年比 62% 増加しました。 |

| アマゾンは従業員に何日間オフィスに出社するよう求めましたか? | アマゾンは企業従業員に対し、2022年XNUMX月から少なくとも週XNUMX日はオフィスに戻るよう要請した。 |

| 2022 年の AWS の収益は前年比何パーセント増加しましたか? | AWS の 29 年の収益は前年比 2022% (「YoY」) でした。 |

| Graviton2 プロセッサと比較して、Graviton3 チップはどのようなパフォーマンス向上を実現しましたか? | 2022 年に、AWS は Graviton3 プロセッサよりも 25% 優れたパフォーマンスを提供する Graviton2 チップを提供しました。 |

| この一節によると、AWS によって発売された最初の推論チップはどれですか? | AWS は 2019 年に最初の推論チップ (「Inferentia」) を発売し、Amazon などの企業の資本支出を XNUMX 億ドル以上節約しました。 |

| 文脈によると、Amazon の年間収益が 245 億ドルから 434 億ドルに増加したのは何年ですか? | Amazon の年間収益は、245 年の 2019 億ドルから 434 年には 2022 億ドルに増加しました。 |

| 改めて2019年の収益を教えてください。 | アマゾンの2019年の収益は245億ドルだった。 |

| そして、2021年は? | 2021年のアマゾンの売上高は469.8億ドルで、22年と比べて2020%増加した。 |

| そして、もう一度思い出してください。最初の推論チップが発売されたのはいつですか? | Amazon の最初の推論チップは、2019 年に発売された Inferentia でした。 |

Lambda 関数への最初の呼び出し中に、 RetrieveAndGenerate API は、 sessionIdこれは、同じセッションで会話を継続するために、RetrieveAndGenerate API への入力として後続のユーザー プロンプトとともに Streamlit アプリによって渡されます。の RetrieveAndGenerate API は短期メモリを管理し、連続する呼び出しで同じ sessionId が入力として渡される限り、チャット履歴を使用します。

おめでとうございます。Amazon Bedrock のナレッジベースを使用してチャットボット アプリケーションを作成し、テストすることができました。

クリーンアップ

S3 バケット、OpenSearch サーバーレス コレクション、ナレッジ ベースなどのリソースの削除に失敗すると、料金が発生します。これらのリソースをクリーンアップするには、CloudFormation スタックを削除し、S3 バケット (そのバケットに保存されているドキュメント フォルダーとファイルを含む) を削除し、OpenSearch サーバーレス コレクションを削除し、ナレッジ ベースを削除し、ロール、ポリシー、権限を削除します。以前に作成されました。

まとめ

この投稿では、コンテキスト チャットボットの概要を示し、それが重要である理由を説明しました。 RAG アーキテクチャのデータ取り込みとテキスト生成ワークフローに伴う複雑さについて説明しました。次に、Knowledge Bases for Amazon Bedrock が、ベクター ストアを含むフルマネージドのサーバーレス RAG システムを作成する方法を紹介しました。最後に、ソリューション アーキテクチャとサンプル コードを で提供しました。 GitHubレポ ナレッジ ベースを使用して、チャットボット アプリケーションのコンテキストに応じた応答を取得および生成します。

この投稿では、コンテキストチャットボットの価値、RAG システムの課題、および Amazon Bedrock のナレッジベースがこれらの課題にどのように対処するかを説明することで、Amazon Bedrock を使用して最小限の労力で高度な会話型 AI アプリケーションを構築できる方法を紹介することを目的としています。

詳細については、以下を参照してください Amazon Bedrock 開発者ガイド および ナレッジベースAPI.

著者について

マニッシュ・チュー は、カリフォルニア州サンフランシスコを拠点とする AWS のプリンシパル ソリューション アーキテクトです。彼は機械学習と生成 AI を専門としています。彼は、大企業から初期段階のスタートアップまで、さまざまな組織と協力して機械学習に関連する問題に取り組んでいます。彼の役割には、これらの組織が AWS 上でスケーラブルで安全かつコスト効率の高いワークロードを設計できるよう支援することが含まれます。彼は、AWS カンファレンスやその他のパートナー イベントで定期的に講演を行っています。仕事以外では、イースト ベイのトレイルでのハイキング、ロード バイク、クリケットの観戦 (およびプレー) を楽しんでいます。

マニッシュ・チュー は、カリフォルニア州サンフランシスコを拠点とする AWS のプリンシパル ソリューション アーキテクトです。彼は機械学習と生成 AI を専門としています。彼は、大企業から初期段階のスタートアップまで、さまざまな組織と協力して機械学習に関連する問題に取り組んでいます。彼の役割には、これらの組織が AWS 上でスケーラブルで安全かつコスト効率の高いワークロードを設計できるよう支援することが含まれます。彼は、AWS カンファレンスやその他のパートナー イベントで定期的に講演を行っています。仕事以外では、イースト ベイのトレイルでのハイキング、ロード バイク、クリケットの観戦 (およびプレー) を楽しんでいます。

マニカヌジャ テクノロジーリード – ジェネレーティブ AI スペシャリストであり、『Applied Machine Learning and High Performance Computing on AWS』の著者であり、女性製造教育財団理事会のメンバーでもあります。彼女は、コンピューター ビジョン、自然言語処理、生成 AI などのさまざまな分野で機械学習プロジェクトを主導しています。彼女は、AWS re:Invent、Women in Manufacturing West、YouTube ウェビナー、GHC 23 などの社内および社外のカンファレンスで講演しています。自由時間には、ビーチに沿って長距離ランニングをするのが好きです。

マニカヌジャ テクノロジーリード – ジェネレーティブ AI スペシャリストであり、『Applied Machine Learning and High Performance Computing on AWS』の著者であり、女性製造教育財団理事会のメンバーでもあります。彼女は、コンピューター ビジョン、自然言語処理、生成 AI などのさまざまな分野で機械学習プロジェクトを主導しています。彼女は、AWS re:Invent、Women in Manufacturing West、YouTube ウェビナー、GHC 23 などの社内および社外のカンファレンスで講演しています。自由時間には、ビーチに沿って長距離ランニングをするのが好きです。

パラヴィ・ナルグンド AWS のプリンシパル ソリューション アーキテクトです。クラウドテクノロジーのイネーブラーとしての役割において、彼女は顧客と協力して目標と課題を理解し、AWS 製品で目的を達成するための規範的なガイダンスを提供します。彼女はテクノロジー業界の女性に情熱を持っており、Amazon の Women in AI/ML の中心メンバーです。彼女は、AWS re:Invent、AWS Summit、ウェビナーなどの社内外のカンファレンスで講演しています。仕事以外では、ボランティア、ガーデニング、サイクリング、ハイキングを楽しんでいます。

パラヴィ・ナルグンド AWS のプリンシパル ソリューション アーキテクトです。クラウドテクノロジーのイネーブラーとしての役割において、彼女は顧客と協力して目標と課題を理解し、AWS 製品で目的を達成するための規範的なガイダンスを提供します。彼女はテクノロジー業界の女性に情熱を持っており、Amazon の Women in AI/ML の中心メンバーです。彼女は、AWS re:Invent、AWS Summit、ウェビナーなどの社内外のカンファレンスで講演しています。仕事以外では、ボランティア、ガーデニング、サイクリング、ハイキングを楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :持っている

- :は

- :どこ

- $UP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- 能力

- 私たちについて

- 加速する

- アクセス

- アクセス

- 従った

- 正確な

- 達成する

- 越えて

- Action

- 加えます

- NEW

- アドレス

- 高度な

- 利点

- 顧問

- 再び

- エージェント

- AI

- AIシステム

- AI / ML

- 目的としました

- すべて

- 許可

- ことができます

- 一人で

- 沿って

- 並んで

- また

- Amazon

- Amazon Webサービス

- an

- および

- 毎年恒例の

- 歳入

- 回答

- 応答

- 人間原理

- どれか

- API

- API

- アプリ

- 申し込み

- 適用された

- アプローチ

- 建築

- です

- AS

- At

- 増強

- 増強された

- 補強します

- オーロラ

- 著者

- 自動的に

- 利用できます

- 大通り

- 離れて

- AWS

- AWS CloudFormation

- AWS re:Invent

- バック

- ベース

- ベース

- 基本

- ベイ

- (ダグラス・ビーチ)

- になる

- き

- 開始

- 始まります

- 行動

- と考えています

- より良いです

- 10億

- ボード

- 取締役会

- 本

- ブランド

- ブラウザ

- ビルド

- ビジネス

- ビジネスアプリケーション

- by

- CA

- コール

- コール

- 缶

- 機能

- 資本

- 例

- CD

- 課題

- 変化する

- 変更

- 課金

- チャット

- チャットボット

- チャットボット

- 注文

- チップ

- チップ

- 選択

- 選択する

- クリ

- クラウド

- クラウドテクノロジー

- コード

- コレクション

- 組み合わせ

- 来ます

- comes

- コマンドと

- 企業

- 会社

- コンプリート

- 複雑さ

- コンポーネント

- 計算的

- コンピュータ

- Computer Vision

- コンピューティング

- 会議

- お問合せ

- 領事

- consumer

- コンテキスト

- 文脈上の

- コンテキスト化

- 続ける

- 会話

- 会話

- 会話型AI

- 会話

- 変換

- 基本

- 企業

- コスト効率の良い

- 可能性

- 作ります

- 作成した

- 作成します。

- 作成

- 創造

- クリエイター

- クリケット

- 現在

- 顧客

- 顧客行動

- 顧客満足体験

- 顧客サービス

- Customers

- カスタマイズ

- データ

- データポイント

- データ駆動型の

- データベース

- 日

- デフォルト

- 配信する

- 配信

- 配信する

- によっては

- 展開

- 展開

- 記載された

- 説明

- 細部

- 決定する

- 開発する

- Developer

- 開発

- ダイアグラム

- DID

- 異なります

- デジタル

- 取締役

- 異なる

- ドキュメント

- ドキュメント

- すること

- ドル

- ドメイン

- ドント

- ダウン

- ダウンロード

- 各

- 前

- 初期段階

- 東

- 教育

- 効率的な

- 努力

- 楽

- どちら

- 埋め込み

- 社員

- enable

- イネイブラー

- 可能

- 魅力的

- エンジン

- エンジニアリング

- 強化された

- 強化

- 入力します

- Enterprise

- 企業

- 環境

- エラー

- さらに

- イベント

- あらゆる

- 例

- 体験

- エクスペリエンス

- 専門知識

- 説明する

- 説明

- 説明

- 外部

- 事実

- フェイル

- 少数の

- フィールド

- File

- 最後に

- 発見

- 名

- フロー

- フォーカス

- フォロー中

- Foundation

- 4

- フランシスコ

- 無料版

- から

- 完全に

- function

- g1

- 生成する

- 生成

- 世代

- 生々しい

- 生成AI

- Gitの

- GitHubの

- 与える

- Go

- 目標

- 成長しました

- 陸上

- 成長する

- 育ちます

- ガイダンス

- 持っていました

- ハンドル

- ハンドル

- 持ってる

- he

- ヘビー

- 重いもの

- 助け

- 彼女の

- ハイ

- ハイレベル

- 彼の

- history

- ホーム

- 認定条件

- しかしながら

- HTML

- HTTP

- HTTPS

- 百

- ID

- if

- 説明します

- 説明する

- 実装

- 重要

- 改善します

- 改善

- 改善

- in

- 含ま

- 含めて

- 組み込む

- 組み込む

- 増える

- 増加した

- index

- インデックス

- 個人

- 産業

- 知らせます

- 情報

- 情報機器

- お問い合わせ

- 洞察

- install

- インスタント

- 統合する

- 統合

- 統合

- 相互作用する

- 利益

- インタフェース

- 内部

- 内部で

- に

- 紹介する

- 導入

- 投資

- 呼び出す

- 関係する

- 関与

- IT

- JPG

- キー

- 知識

- 言語

- ESL, ビジネスESL <br> 中国語/フランス語、その他

- 大

- 大企業

- 姓

- 後で

- 打ち上げ

- 層

- つながる

- リード

- 学習

- 最低

- コメントを残す

- less

- 手紙

- レベル

- ライブラリ

- 図書館

- フェイスリフト

- ような

- 好き

- 限定的

- LINE

- 連結

- LLM

- ローカル

- 長い

- 機械

- 機械学習

- メイン

- 作る

- 扱いやすいです

- マネージド

- 管理する

- 管理する

- 製造業

- 多くの

- 一致

- 五月..

- me

- 意味

- メカニズム

- メンバー

- メモリ

- 単に

- 百万

- 万ドル

- 最小限の

- 分

- 分

- モデル

- 修正する

- 他には?

- 最も

- の試合に

- 名

- ナチュラル

- 自然言語処理

- ナビゲート

- ナビゲーション

- 必要

- 必要とされる

- ニーズ

- 新作

- 次の

- いいえ

- なし

- 注意

- ノート

- 注意

- 客観

- of

- 提供

- オファリング

- オファー

- Office

- 頻繁に

- on

- ONE

- 開いた

- オープンソース

- 最適な

- オプション

- オプション

- or

- 組織

- その他

- さもないと

- 私たちの

- でる

- 出力

- 外側

- が

- オーバーヘッド

- 概要

- 自分の

- ページ

- ペイン

- パラメータ

- パートナー

- 部品

- 通過

- 通路

- 渡された

- 情熱的な

- 過去

- パターン

- 割合

- パフォーマンス

- パーミッション

- カスタマイズ

- 計画

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 再生

- ポイント

- ポイント

- ポリシー

- 人気

- 人気

- ポスト

- 電力

- パワード

- 強力な

- プ

- 現在

- PLM platform.

- プレゼント

- 前

- 校長

- 問題

- プロセス

- 処理

- プロセッサ

- 製品

- 進捗

- プロジェクト(実績作品)

- プロンプト

- 所有権

- 提供します

- 提供

- は、大阪で

- 提供

- 購入

- Python

- クエリ

- クエリー

- 質問

- 質問

- クイック

- ぼろ

- 測距

- RE

- 準備

- リアル

- 現実の世界

- への

- 記録

- 減らします

- 縮小

- 参照する

- 地域

- 定期的に

- 関連する

- 関連性

- 関連した

- 除去する

- レポート

- 倉庫

- 表す

- 要求

- の提出が必要です

- 必要

- リソース

- 反応します

- 応答

- 回答

- 検索

- 収益

- 収入

- レビュー

- ロード

- 職種

- 役割

- ラン

- runs

- ランタイム

- 同じ

- サンプル

- サン

- サンフランシスコ

- 保存されました

- ド電源のデ

- スケーリング

- スクリプト

- SDDK

- を検索

- セクション

- セクション

- 安全に

- select

- 選択

- セマンティック

- 送信

- 役立つ

- サーバレス

- サービス

- サービス

- セッション

- セッションに

- 設定

- 株主

- 株主総会

- 彼女

- 短期

- すべき

- ショーケース

- 重要

- 同様の

- 同時に

- サイズ

- より小さい

- 溶液

- ソリューション

- 一部

- 洗練された

- ソース

- ソース

- スピークス

- 専門家

- 専門にする

- 特定の

- 指定の

- split

- 分割

- スタック

- start

- スタートアップ

- 都道府県

- Status:

- 茎

- 手順

- ステップ

- 店舗

- 保存され

- 店舗

- 保存

- 簡単な

- 戦略

- 流線

- 提出する

- それに続きます

- 実質上

- 首尾よく

- そのような

- 示唆する

- サミット

- サポート

- サポート

- サポート

- 同期。

- システム

- テーブル

- テーラード

- 取る

- 取り

- タスク

- テク

- テクノロジー

- template

- ターミナル

- test

- テスト

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- より

- それ

- 情報

- ソース

- アプリ環境に合わせて

- それら

- その後

- そこ。

- したがって、

- ボーマン

- 彼ら

- この

- それらの

- 三

- 介して

- 時間

- タイタン

- 〜へ

- 最適化の適用

- トリガー

- 信頼されている

- 試します

- 2

- 下

- わかる

- 更新

- アップロード

- つかいます

- 中古

- ユーザー

- users

- 使用されます

- ユーティリティ

- v1

- 貴重な

- 値

- 価値観

- さまざまな

- ビジョン

- ボリューム

- 欲しいです

- ました

- 見ている

- 仕方..

- we

- ウェブ

- ウェブブラウザ

- Webサービス

- ウェブベースの

- ウェビナー

- 週間

- ウィークス

- ウェスト

- この試験は

- いつ

- which

- while

- なぜ

- 意志

- ウィンドウを使用して入力ファイルを追加します。

- レディース

- 技術における女性

- 仕事

- ワークフロー

- ワークフロー

- ワーキング

- 作品

- 書きます

- コードを書く

- 書かれた

- ヤムル

- 年

- 年

- You

- あなたの

- ユーチューブ

- ゼファーネット